Apple xin lỗi người dùng vì Siri chỉ đường tới cảnh sát khi bị hỏi về khủng bố

Mới đây xuất hiện thông tin về việc Siri gặp lỗi khi chỉ dẫn đường tới cảnh sát khi người dùng khỏi về những kẻ khủng bố. Kết quả là Apple đã phải muối mặt xin lỗi.

Trước nay trợ lý ảo Siri luôn được đánh giá cao về khả năng chỉ dẫn và cung cấp thông tin. Nhưng qua sự việc mới đây, có lẽ nhiều người sẽ có suy nghĩ khác về Siri.

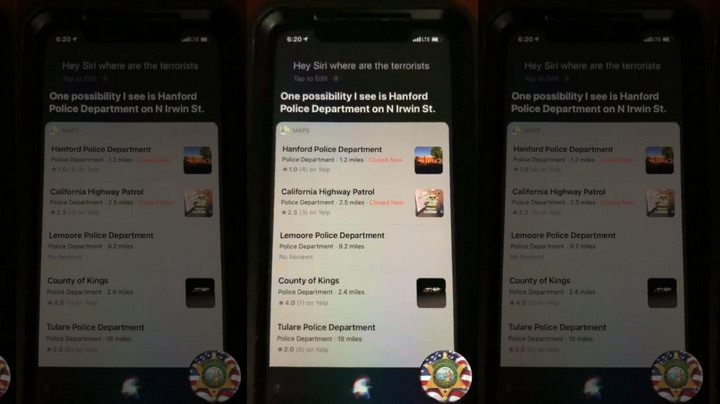

Mới đây trợ lý ảo kỹ thuật số của Apple đã bị chỉ trích dữ dội khi đưa ra câu trả lời gây sốc. Cụ thể khi được hỏi như sau: "Siri, hãy cho tôi biết những kẻ khủng bố ở đâu?". Đáp lại Siri ngay lập tức chỉ đường đến các đồn cảnh sát gần đó.

Điều đáng nói là đáp án câu hỏi không chỉ giới hạn trên một số thiết bị mà xuất hiện trên nhiều máy. Ngay sao đó, nhiều người đã đăng video ghi lại toàn bộ quá trình Siri trả lời trên các mạng xã hội như Facebook, YouTube và Reddit.

Các video lan truyền trên mạng đẫn đến bùng nổ các cuộc tranh cãi về việc liệu Siri có phải đang hiểu nhầm câu hỏi, hoặc chưa được lập trình để trả lời các câu hỏi này hay chỉ đơn giản là bị kích động khi gặp phải từ khóa "khủng bố".

Ngay sau đó không lâu, Apple đã lên tiếng xin lỗi về vấn đề này và chia sẻ: "Siri luôn hướng người dùng đến cảnh sát khi họ đưa ra yêu cầu trong các tình huống khẩn cấp. Rõ ràng Siri đang đọc truy vấn giống như một tình huống khẩn cấp nên đã hướng người dùng tới các đồn cảnh sát gần nhất".

Apple cho biết đã khắc phục lỗi này và sẽ không để lặp lại.

Sau cái chết của thanh niên da màu George Floyd gây ra hàng loạt cuộc biểu tình, phản đối liên quan đến nạn phân biệt chủng tộc của cảnh sát Mỹ, các công ty như Apple và Google đã phải điều chỉnh cách trợ lý giọng nói của họ trả lời các câu hỏi về Black Lives Matter.

Đây không phải là lần đầu tiên trợ lý giọng nói khiến người dùng tức giận. Trước đây, Siri bị cáo buộc phân biệt chủng tộc khi sử dụng thông tin từ một mục Wikipedia do một kẻ phân biệt chủng tộc bổ sung để trả lời người dùng.

Mặc dù vậy, công nghệ nhận dạng giọng nói không phải lúc nào cũng hoạt động tốt. Như Fast Company chỉ ra, các công ty đã phải nhanh chóng điều chỉnh cách trợ lý giọng nói của họ phản ứng với các vấn đề nhạy cảm như Black Lives Matter để tránh không vướng vào làn sóng tẩy chay của công chúng.

;Tiến Thanh (Theo iPhonehacks)