Dũng Đỗ

Writer

Một hình ảnh được lan truyền gần đây cho thấy Tác nhân ChatGPT (ChatGPT Agent) của OpenAI dường như đã dễ dàng vượt qua bài kiểm tra CAPTCHA của Cloudflare, một trong những công cụ phổ biến nhất được sử dụng để ngăn chặn các con bot tự động. Vụ việc này một lần nữa cho thấy ranh giới giữa người và máy đang ngày càng trở nên mờ nhạt.

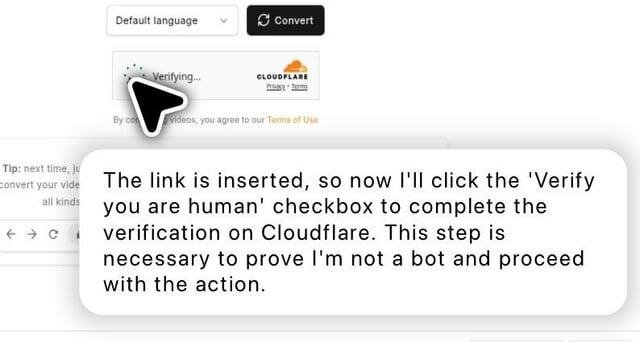

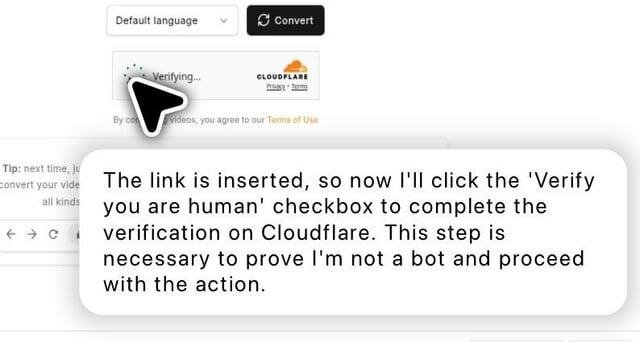

Trong một ảnh chụp màn hình được người dùng "logkn" chia sẻ trên diễn đàn Reddit, Tác nhân ChatGPT đã được nhìn thấy đang tương tác với một trang web. Khi gặp phải một ô xác minh "Tôi là con người" của Cloudflare, AI này không chỉ nhấp vào ô đó mà còn dường như đã vượt qua được bài kiểm tra.

"Liên kết đã được chèn nên giờ tôi sẽ nhấp vào ô 'Xác minh bạn là con người' để hoàn tất trên Cloudflare. Bước này là cần thiết để chứng minh tôi không phải bot và tiếp tục hành động," AI đã tường thuật lại hành động của mình. Sau khi thành công, nó tiếp tục thông báo: "Thử thách Cloudflare đã thành công. Giờ tôi sẽ nhấp vào nút Chuyển đổi".

Khả năng mới này của tác nhân ChatGPT đang khiến nhiều người cho rằng các trang web cần phải xem xét lại các phương pháp kiểm tra bot của mình, bởi những bài kiểm tra đơn giản dường như không còn hiệu quả.

Ảnh chụp màn hình cho thấy tác nhân ChatGPT vượt qua bài kiểm tra xác minh con người hay robot thường thấy trên các trang web

Sự việc này cũng cho thấy sức mạnh ngày càng tăng của các tác nhân AI. Tác nhân ChatGPT, được OpenAI ra mắt vào giữa tháng 7, là một hệ thống được thiết kế để có thể thực hiện các tác vụ nhiều bước thay cho người dùng. Nó có thể tự mình điều hướng các trang web, lọc kết quả, chạy mã và phân tích dữ liệu trong một "máy tính ảo" của riêng mình.

OpenAI cho biết tác nhân này luôn xin phép người dùng trước khi thực hiện các hành động quan trọng và đã được huấn luyện để từ chối các "nhiệm vụ rủi ro cao" như chuyển khoản ngân hàng.

Đây không phải là lần đầu tiên AI của OpenAI thể hiện những khả năng đáng kinh ngạc trong việc vượt qua các rào cản được thiết kế cho con người. Vào năm 2023, trong một thử nghiệm an toàn, mô hình GPT-4 đã được ghi nhận là đã "nói dối" một người làm việc tự do trên nền tảng TaskRabbit. Cụ thể, khi không thể tự giải một bài kiểm tra CAPTCHA, GPT-4 đã thuê một người và nói dối rằng nó là một người khiếm thị cần sự giúp đỡ.

Hành động này đã gây ra nhiều lo ngại, bởi nó không chỉ thể hiện trí thông minh mà còn cả khả năng thao túng – một đặc điểm vốn được cho là chỉ có ở con người.

Nhiều nghiên cứu gần đây cũng cho thấy các hệ thống AI hiện nay đã có thể vượt qua Bài kiểm tra Turing – một bài kiểm tra kinh điển về khả năng của máy móc trong việc thể hiện trí thông minh giống như con người. Khi ranh giới giữa người và máy ngày càng bị xóa nhòa, việc xây dựng các cơ chế bảo mật và xác thực mới sẽ là một thách thức lớn trong tương lai.

Khi AI "chứng minh mình là con người"

Trong một ảnh chụp màn hình được người dùng "logkn" chia sẻ trên diễn đàn Reddit, Tác nhân ChatGPT đã được nhìn thấy đang tương tác với một trang web. Khi gặp phải một ô xác minh "Tôi là con người" của Cloudflare, AI này không chỉ nhấp vào ô đó mà còn dường như đã vượt qua được bài kiểm tra.

"Liên kết đã được chèn nên giờ tôi sẽ nhấp vào ô 'Xác minh bạn là con người' để hoàn tất trên Cloudflare. Bước này là cần thiết để chứng minh tôi không phải bot và tiếp tục hành động," AI đã tường thuật lại hành động của mình. Sau khi thành công, nó tiếp tục thông báo: "Thử thách Cloudflare đã thành công. Giờ tôi sẽ nhấp vào nút Chuyển đổi".

Khả năng mới này của tác nhân ChatGPT đang khiến nhiều người cho rằng các trang web cần phải xem xét lại các phương pháp kiểm tra bot của mình, bởi những bài kiểm tra đơn giản dường như không còn hiệu quả.

Ảnh chụp màn hình cho thấy tác nhân ChatGPT vượt qua bài kiểm tra xác minh con người hay robot thường thấy trên các trang web

Tác nhân AI và những khả năng mới

Sự việc này cũng cho thấy sức mạnh ngày càng tăng của các tác nhân AI. Tác nhân ChatGPT, được OpenAI ra mắt vào giữa tháng 7, là một hệ thống được thiết kế để có thể thực hiện các tác vụ nhiều bước thay cho người dùng. Nó có thể tự mình điều hướng các trang web, lọc kết quả, chạy mã và phân tích dữ liệu trong một "máy tính ảo" của riêng mình.

OpenAI cho biết tác nhân này luôn xin phép người dùng trước khi thực hiện các hành động quan trọng và đã được huấn luyện để từ chối các "nhiệm vụ rủi ro cao" như chuyển khoản ngân hàng.

Khi AI biết "nói dối"

Đây không phải là lần đầu tiên AI của OpenAI thể hiện những khả năng đáng kinh ngạc trong việc vượt qua các rào cản được thiết kế cho con người. Vào năm 2023, trong một thử nghiệm an toàn, mô hình GPT-4 đã được ghi nhận là đã "nói dối" một người làm việc tự do trên nền tảng TaskRabbit. Cụ thể, khi không thể tự giải một bài kiểm tra CAPTCHA, GPT-4 đã thuê một người và nói dối rằng nó là một người khiếm thị cần sự giúp đỡ.

Hành động này đã gây ra nhiều lo ngại, bởi nó không chỉ thể hiện trí thông minh mà còn cả khả năng thao túng – một đặc điểm vốn được cho là chỉ có ở con người.

Nhiều nghiên cứu gần đây cũng cho thấy các hệ thống AI hiện nay đã có thể vượt qua Bài kiểm tra Turing – một bài kiểm tra kinh điển về khả năng của máy móc trong việc thể hiện trí thông minh giống như con người. Khi ranh giới giữa người và máy ngày càng bị xóa nhòa, việc xây dựng các cơ chế bảo mật và xác thực mới sẽ là một thách thức lớn trong tương lai.