Thế Việt

Writer

Trí tuệ nhân tạo (AI) và công nghệ deepfake đang trở thành những công cụ đắc lực cho tội phạm lừa đảo mạng, giúp chúng thực hiện các phi vụ lừa đảo tinh vi hơn, quy mô lớn hơn, và gây ra thiệt hại hàng tỷ USD cho các nạn nhân trên toàn thế giới.

Deepfake và AI: 'Vũ Khí' Mới Của Tội Phạm Lừa Đảo

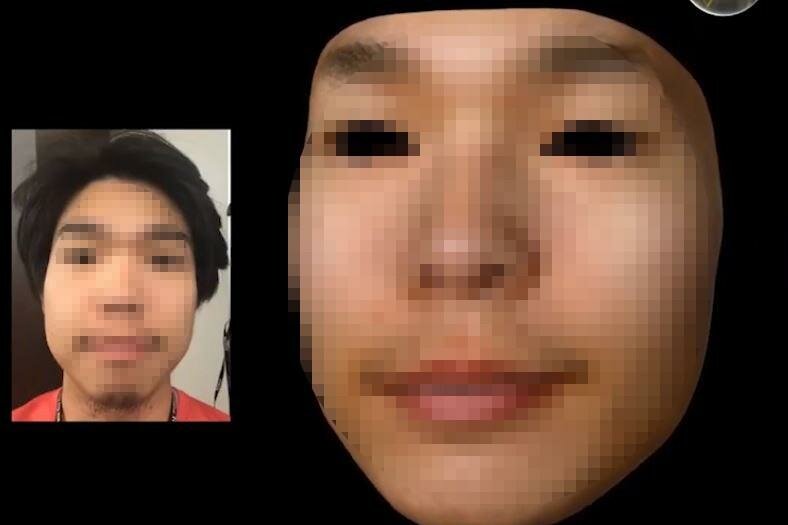

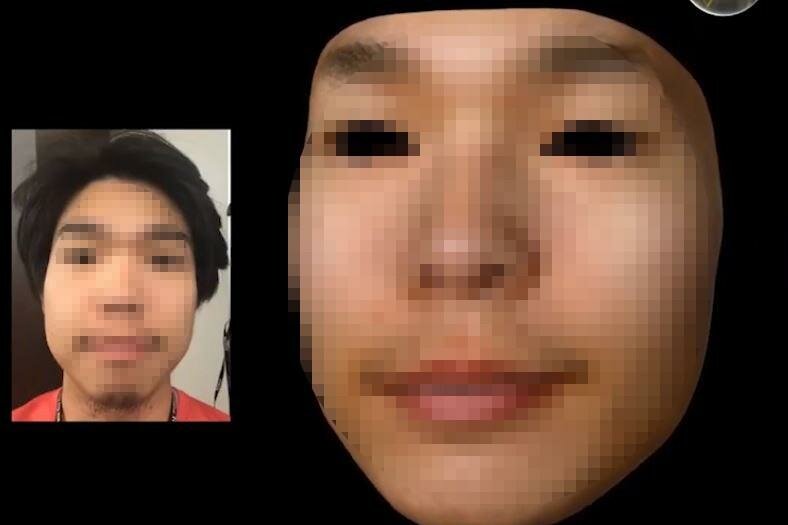

Một đoạn video lan truyền trên mạng xã hội gần đây đã cho thấy một ví dụ điển hình về việc tội phạm sử dụng công nghệ deepfake. Trong video, một người đàn ông trẻ châu Á có thể biến đổi khuôn mặt của mình thành hơn 10 giới tính và sắc tộc khác nhau chỉ trong vòng một phút. Đây không phải là một bộ lọc TikTok, mà là một công cụ được các tổ chức tội phạm ở Đông Nam Á sử dụng trong các vụ lừa đảo "vỗ béo rồi làm thịt" (pig butchering scams).

Các chuyên gia cho rằng công nghệ deepfake, cùng với các công cụ AI tạo sinh khác như chatbot, đang làm gia tăng đáng kể hiệu quả của các vụ lừa đảo, đồng thời mở rộng phạm vi tiếp cận của tội phạm đến các nạn nhân mới.

'Vỗ Béo Rồi Làm Thịt': Chiêu Lừa Đảo Tinh Vi

"Vỗ béo rồi làm thịt" là một hình thức lừa đảo tình cảm, trong đó kẻ lừa đảo (thường sử dụng deepfake để giả mạo danh tính) tiếp cận nạn nhân qua mạng xã hội hoặc ứng dụng hẹn hò, xây dựng mối quan hệ tình cảm, sau đó dụ dỗ nạn nhân đầu tư vào các dự án giả mạo, thường là tiền điện tử.

Kể từ năm 2020, các hoạt động lừa đảo kiểu này, chủ yếu do người Trung Quốc điều hành, đã gia tăng mạnh mẽ ở Đông Nam Á, đặc biệt là ở Campuchia, Myanmar và Lào. Ban đầu, các tổ chức này nhắm mục tiêu chủ yếu vào người gốc Hoa, nhưng hiện nay, đối tượng của chúng đã mở rộng ra toàn cầu.

Liên Hợp Quốc Cảnh Báo

Đầu năm 2024, Văn phòng Ma túy và Tội phạm của Liên Hợp Quốc (UNODC) đã cảnh báo về việc "những tiến bộ trong chatbot, công nghệ deepfake và tự động hóa" đã cho phép "các chiêu trò lừa đảo mạng tinh vi và gây thiệt hại nhiều hơn".

UNODC cho biết: "Bằng cách sử dụng trí tuệ nhân tạo để tạo ra hình ảnh và giọng nói do máy tính tạo ra gần như không thể phân biệt được với hình ảnh và giọng nói thật, những kẻ lừa đảo có thể thực hiện các vụ lừa đảo qua mạng xã hội với tỷ lệ thành công đáng báo động, lợi dụng lòng tin và cảm xúc của mọi người."

'Địa Ngục Lừa Đảo' Ở Đông Nam Á

Nhiều người làm việc trong các tổ chức lừa đảo này bị dụ dỗ từ các quốc gia khác với lời hứa về công việc hợp pháp, nhưng sau đó bị ép buộc tham gia vào các hoạt động lừa đảo. Những người trốn thoát đã kể lại về việc bị đánh đập, tra tấn và thậm chí chứng kiến những cảnh bạo lực *******.

Judah Tana, giám đốc của Global Advance Projects, một tổ chức phi chính phủ có trụ sở tại Thái Lan, đã hỗ trợ hàng trăm nạn nhân của bọn buôn người trốn thoát khỏi các khu phức hợp lừa đảo ở Myanmar.

Ông Tana cho biết, các tổ chức tội phạm ưu tiên nghiên cứu và phát triển AI, và sẵn sàng làm mọi cách để có được công nghệ tiên tiến nhất. Một kỹ sư máy tính, người từng làm việc trong một khu phức hợp lừa đảo, đã chia sẻ với ông Tana rằng công nghệ deepfake mà họ sử dụng "tiên tiến hơn bất cứ thứ gì cô ấy từng thấy trên thế giới, bất cứ thứ gì cô ấy từng học."

Công Nghệ Deepfake 'Tràn Lan'

Công nghệ deepfake, từng chỉ giới hạn trong giới chuyên gia, giờ đây đã trở nên dễ tiếp cận hơn bao giờ hết. Các phần mềm đổi mặt thời gian thực (real-time face-swapping) có thể được tải xuống miễn phí dưới dạng phần mềm nguồn mở, hoặc được cung cấp dưới dạng dịch vụ trả phí.

Tổ chức Chống Lừa đảo Toàn cầu (GASO) đã phát hiện các quảng cáo về phần mềm đổi mặt trên nền tảng nhắn tin Telegram. Phần mềm này tích hợp cả tính năng nhân bản giọng nói, có thể bắt chước giọng nói của mục tiêu với độ tương đồng "từ 60% đến 95%".

Một nhà cung cấp phần mềm đổi mặt khác còn cung cấp dịch vụ hỗ trợ 24/7, "giao hàng tận nơi" tại Campuchia và tuyên bố đã cài đặt sản phẩm của mình tại hơn 1.000 khu phức hợp lừa đảo.

Lời Khuyên Của Chuyên Gia

Ronnie Tokazowski, chuyên gia về tội phạm mạng tại Intelligence for Good, cho biết trước đây, việc từ chối gọi video là một dấu hiệu cảnh báo lừa đảo. Tuy nhiên, với sự phát triển của công nghệ deepfake, dấu hiệu này không còn đáng tin cậy nữa.

Ông Tokazowski khuyên người dùng không nên gửi hoặc nhận tiền từ những người mà họ chỉ quen biết qua mạng.

Ông Chandraiah, một chuyên gia khác, nhấn mạnh tầm quan trọng của việc nâng cao nhận thức, giáo dục và khả năng nhận biết các dấu hiệu cảnh báo. "Những kẻ lừa đảo lợi dụng cảm xúc của chúng ta, và chúng ta cần bắt đầu suy nghĩ bằng lý trí trước khi bằng trái tim," ông nói.

Sự phát triển của công nghệ AI và deepfake đang tạo ra những thách thức mới trong cuộc chiến chống lừa đảo mạng. Người dùng cần nâng cao cảnh giác, trang bị kiến thức và kỹ năng để tự bảo vệ mình trước những chiêu trò lừa đảo ngày càng tinh vi.

Deepfake và AI: 'Vũ Khí' Mới Của Tội Phạm Lừa Đảo

Một đoạn video lan truyền trên mạng xã hội gần đây đã cho thấy một ví dụ điển hình về việc tội phạm sử dụng công nghệ deepfake. Trong video, một người đàn ông trẻ châu Á có thể biến đổi khuôn mặt của mình thành hơn 10 giới tính và sắc tộc khác nhau chỉ trong vòng một phút. Đây không phải là một bộ lọc TikTok, mà là một công cụ được các tổ chức tội phạm ở Đông Nam Á sử dụng trong các vụ lừa đảo "vỗ béo rồi làm thịt" (pig butchering scams).

Các chuyên gia cho rằng công nghệ deepfake, cùng với các công cụ AI tạo sinh khác như chatbot, đang làm gia tăng đáng kể hiệu quả của các vụ lừa đảo, đồng thời mở rộng phạm vi tiếp cận của tội phạm đến các nạn nhân mới.

'Vỗ Béo Rồi Làm Thịt': Chiêu Lừa Đảo Tinh Vi

"Vỗ béo rồi làm thịt" là một hình thức lừa đảo tình cảm, trong đó kẻ lừa đảo (thường sử dụng deepfake để giả mạo danh tính) tiếp cận nạn nhân qua mạng xã hội hoặc ứng dụng hẹn hò, xây dựng mối quan hệ tình cảm, sau đó dụ dỗ nạn nhân đầu tư vào các dự án giả mạo, thường là tiền điện tử.

Kể từ năm 2020, các hoạt động lừa đảo kiểu này, chủ yếu do người Trung Quốc điều hành, đã gia tăng mạnh mẽ ở Đông Nam Á, đặc biệt là ở Campuchia, Myanmar và Lào. Ban đầu, các tổ chức này nhắm mục tiêu chủ yếu vào người gốc Hoa, nhưng hiện nay, đối tượng của chúng đã mở rộng ra toàn cầu.

Liên Hợp Quốc Cảnh Báo

Đầu năm 2024, Văn phòng Ma túy và Tội phạm của Liên Hợp Quốc (UNODC) đã cảnh báo về việc "những tiến bộ trong chatbot, công nghệ deepfake và tự động hóa" đã cho phép "các chiêu trò lừa đảo mạng tinh vi và gây thiệt hại nhiều hơn".

UNODC cho biết: "Bằng cách sử dụng trí tuệ nhân tạo để tạo ra hình ảnh và giọng nói do máy tính tạo ra gần như không thể phân biệt được với hình ảnh và giọng nói thật, những kẻ lừa đảo có thể thực hiện các vụ lừa đảo qua mạng xã hội với tỷ lệ thành công đáng báo động, lợi dụng lòng tin và cảm xúc của mọi người."

'Địa Ngục Lừa Đảo' Ở Đông Nam Á

Nhiều người làm việc trong các tổ chức lừa đảo này bị dụ dỗ từ các quốc gia khác với lời hứa về công việc hợp pháp, nhưng sau đó bị ép buộc tham gia vào các hoạt động lừa đảo. Những người trốn thoát đã kể lại về việc bị đánh đập, tra tấn và thậm chí chứng kiến những cảnh bạo lực *******.

Judah Tana, giám đốc của Global Advance Projects, một tổ chức phi chính phủ có trụ sở tại Thái Lan, đã hỗ trợ hàng trăm nạn nhân của bọn buôn người trốn thoát khỏi các khu phức hợp lừa đảo ở Myanmar.

Ông Tana cho biết, các tổ chức tội phạm ưu tiên nghiên cứu và phát triển AI, và sẵn sàng làm mọi cách để có được công nghệ tiên tiến nhất. Một kỹ sư máy tính, người từng làm việc trong một khu phức hợp lừa đảo, đã chia sẻ với ông Tana rằng công nghệ deepfake mà họ sử dụng "tiên tiến hơn bất cứ thứ gì cô ấy từng thấy trên thế giới, bất cứ thứ gì cô ấy từng học."

Công Nghệ Deepfake 'Tràn Lan'

Công nghệ deepfake, từng chỉ giới hạn trong giới chuyên gia, giờ đây đã trở nên dễ tiếp cận hơn bao giờ hết. Các phần mềm đổi mặt thời gian thực (real-time face-swapping) có thể được tải xuống miễn phí dưới dạng phần mềm nguồn mở, hoặc được cung cấp dưới dạng dịch vụ trả phí.

Tổ chức Chống Lừa đảo Toàn cầu (GASO) đã phát hiện các quảng cáo về phần mềm đổi mặt trên nền tảng nhắn tin Telegram. Phần mềm này tích hợp cả tính năng nhân bản giọng nói, có thể bắt chước giọng nói của mục tiêu với độ tương đồng "từ 60% đến 95%".

Một nhà cung cấp phần mềm đổi mặt khác còn cung cấp dịch vụ hỗ trợ 24/7, "giao hàng tận nơi" tại Campuchia và tuyên bố đã cài đặt sản phẩm của mình tại hơn 1.000 khu phức hợp lừa đảo.

Lời Khuyên Của Chuyên Gia

Ronnie Tokazowski, chuyên gia về tội phạm mạng tại Intelligence for Good, cho biết trước đây, việc từ chối gọi video là một dấu hiệu cảnh báo lừa đảo. Tuy nhiên, với sự phát triển của công nghệ deepfake, dấu hiệu này không còn đáng tin cậy nữa.

Ông Tokazowski khuyên người dùng không nên gửi hoặc nhận tiền từ những người mà họ chỉ quen biết qua mạng.

Ông Chandraiah, một chuyên gia khác, nhấn mạnh tầm quan trọng của việc nâng cao nhận thức, giáo dục và khả năng nhận biết các dấu hiệu cảnh báo. "Những kẻ lừa đảo lợi dụng cảm xúc của chúng ta, và chúng ta cần bắt đầu suy nghĩ bằng lý trí trước khi bằng trái tim," ông nói.

Sự phát triển của công nghệ AI và deepfake đang tạo ra những thách thức mới trong cuộc chiến chống lừa đảo mạng. Người dùng cần nâng cao cảnh giác, trang bị kiến thức và kỹ năng để tự bảo vệ mình trước những chiêu trò lừa đảo ngày càng tinh vi.