Hoàng Anh

Writer

Những điểm chính:

Blackwell Ultra GB300: Nâng cấp bộ nhớ, giữ nguyên hiệu năng

Blackwell Ultra GB300, dự kiến ra mắt vào cuối năm 2025, là phiên bản nâng cấp của chip Blackwell (được công bố năm 2024). GPU này vẫn giữ nguyên hiệu năng tính toán AI 20 petaflops như "đàn anh", nhưng được nâng cấp bộ nhớ HBM3e từ 192GB lên 288GB.

Nvidia cho biết, Blackwell Ultra có thể xử lý 1.000 token/giây, nhanh gấp 10 lần so với chip H100 (ra mắt năm 2022). Trong một thử nghiệm, cụm NVL72 (chứa nhiều chip Blackwell Ultra) có thể chạy một bản sao tương tác của DeepSeek-R1 671B, cung cấp câu trả lời chỉ trong 10 giây, so với 1,5 phút của H100.

Nvidia sẽ bán chip mới theo cụm, với 72 GPU Blackwell Ultra và 36 CPU Nvidia Grace, có thể kết nối với nền tảng đám mây riêng Nvidia DGX Cloud.

Nvidia cũng cung cấp hệ thống nhỏ hơn, B300 NVL16.

Các đối tác đã đặt hàng Blackwell Ultra bao gồm Cisco, Dell, HP, Lenovo và Supermicro.

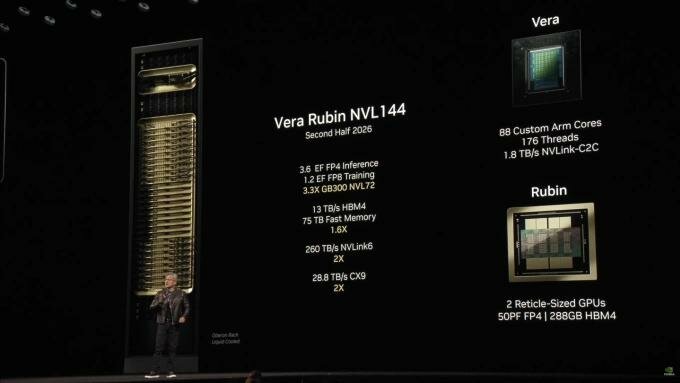

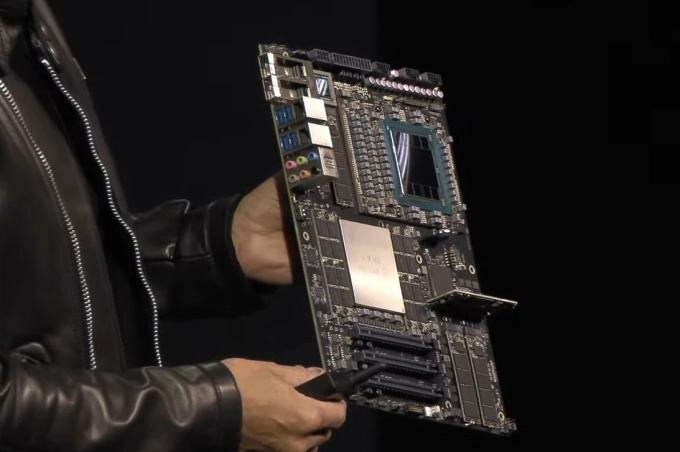

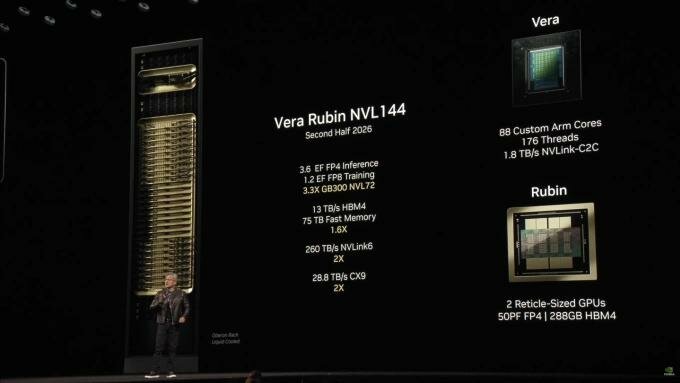

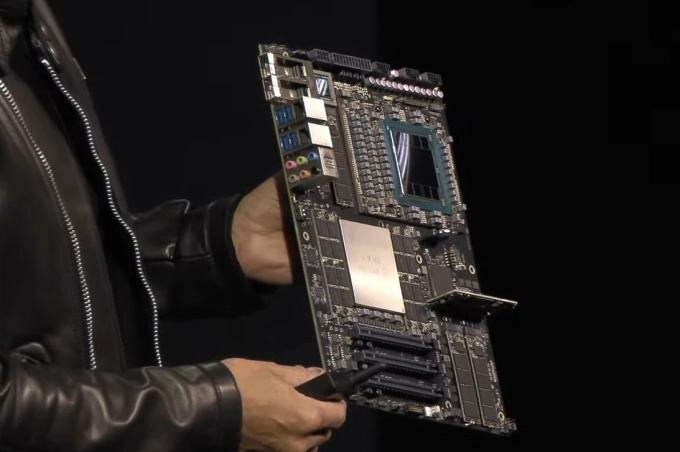

Vera Rubin và Rubin Ultra: Kiến trúc chip AI tương lai

CEO Nvidia, Jensen Huang, cũng giới thiệu kiến trúc chip AI tiếp theo của Nvidia, có tên là Vera Rubin (dự kiến ra mắt năm 2026) và Rubin Ultra (dự kiến ra mắt năm 2027).

Một cụm NVL576 của Rubin Ultra được cho là có hiệu năng gấp 14 lần so với cụm Blackwell Ultra. Nvidia cho biết, Vera Rubin NVL576 sẽ được đặt trong thiết kế giá đỡ máy chủ làm mát bằng chất lỏng mới, có tên là Kyber Rack.

Sau kiến trúc Vera Rubin, Nvidia dự kiến sẽ ra mắt kiến trúc Feynman vào năm 2028.

Máy tính cá nhân AI DGX: Sức mạnh AI ngay tại nhà

Nvidia giới thiệu hai mẫu máy tính cá nhân AI: DGX Spark và DGX Station, được gọi là "siêu máy tính để bàn". Cả hai đều chạy chip Blackwell Ultra, được thiết kế để hỗ trợ các nhà phát triển chạy các mô hình AI suy luận lớn ngay tại nhà, thay vì phải sử dụng các hệ thống lớn.

Chip mạng quang tử silicon Spectrum-X và Quantum-X

Nvidia cũng giới thiệu bộ đôi chip mạng quang tử silicon mới, giúp kết nối hàng triệu GPU trên nhiều địa điểm khác nhau trong các "nhà máy AI" (trung tâm dữ liệu), đồng thời giảm đáng kể mức tiêu thụ năng lượng.

Phần mềm Dynamo: Tối ưu hóa suy luận AI

Nvidia Dynamo là nền tảng suy luận mô-đun, mã nguồn mở, phục vụ các mô hình AI tạo sinh trong môi trường phân tán. Phần mềm này giúp mở rộng quy mô khối lượng công việc suy luận GPU lớn, đồng thời tối ưu hóa quản lý bộ nhớ và truyền dữ liệu.

Dynamo hỗ trợ tất cả các nền tảng AI suy luận và tối ưu hóa các mô hình ngôn ngữ lớn (LLM) phổ biến, như DeepSeek-R1 và Llama. Phần mềm này được phát hành miễn phí.

Nvidia Isaac GR00T N1: Nền tảng cho robot hình người

GR00T N1 là mô hình được Nvidia thiết kế cho robot hình người, được gọi là "nền tảng robot hình người mở đầu tiên trên thế giới". Nó được trang bị hệ thống "kép" giúp robot có thể "suy nghĩ nhanh" (phản xạ) và "suy nghĩ chậm" (đưa ra quyết định có chủ đích).

"Bộ khung" cho GR00T N1 bao gồm Newton, một công cụ vật lý nguồn mở được phát triển cùng với Google DeepMind và Disney Research. Nó có thể khái quát hóa các tác vụ thông thường như cầm nắm, di chuyển đồ vật, và thực hiện các tác vụ nhiều bước.

Các đối tác tiếp cận sớm với GR00T N1 bao gồm Agility Robotics, Boston Dynamics, Mentee Robotics và NEURA Robotics. Isaac GR00T N1 dự kiến công bố vào cuối năm nay.

Tại GTC 2025, Nvidia đã thể hiện rõ tham vọng thống trị thị trường AI, không chỉ bằng phần cứng (chip) mà còn bằng phần mềm và nền tảng. Những công bố của Nvidia cho thấy công ty đang nỗ lực để đáp ứng nhu cầu ngày càng tăng của thị trường AI, và định hình tương lai của công nghệ này.

#robothìnhngười

- Nvidia ra mắt GPU Blackwell Ultra GB300 (cuối 2025), kiến trúc chip AI Vera Rubin (2026) và Rubin Ultra (2027).

- Blackwell Ultra tăng bộ nhớ HBM3e lên 288GB, hiệu năng tương đương Blackwell (20 petaflops).

- Vera Rubin có hiệu năng 50 petaflops, Rubin Ultra (kết hợp 2 GPU Rubin) đạt 100 petaflops.

- Nvidia giới thiệu máy tính cá nhân AI DGX Spark và DGX Station, dùng chip Blackwell Ultra.

- Công bố nền tảng robot hình người GR00T N1, hợp tác với Google DeepMind và Disney Research.

Blackwell Ultra GB300: Nâng cấp bộ nhớ, giữ nguyên hiệu năng

Blackwell Ultra GB300, dự kiến ra mắt vào cuối năm 2025, là phiên bản nâng cấp của chip Blackwell (được công bố năm 2024). GPU này vẫn giữ nguyên hiệu năng tính toán AI 20 petaflops như "đàn anh", nhưng được nâng cấp bộ nhớ HBM3e từ 192GB lên 288GB.

Nvidia cho biết, Blackwell Ultra có thể xử lý 1.000 token/giây, nhanh gấp 10 lần so với chip H100 (ra mắt năm 2022). Trong một thử nghiệm, cụm NVL72 (chứa nhiều chip Blackwell Ultra) có thể chạy một bản sao tương tác của DeepSeek-R1 671B, cung cấp câu trả lời chỉ trong 10 giây, so với 1,5 phút của H100.

Nvidia sẽ bán chip mới theo cụm, với 72 GPU Blackwell Ultra và 36 CPU Nvidia Grace, có thể kết nối với nền tảng đám mây riêng Nvidia DGX Cloud.

Nvidia cũng cung cấp hệ thống nhỏ hơn, B300 NVL16.

Các đối tác đã đặt hàng Blackwell Ultra bao gồm Cisco, Dell, HP, Lenovo và Supermicro.

Vera Rubin và Rubin Ultra: Kiến trúc chip AI tương lai

CEO Nvidia, Jensen Huang, cũng giới thiệu kiến trúc chip AI tiếp theo của Nvidia, có tên là Vera Rubin (dự kiến ra mắt năm 2026) và Rubin Ultra (dự kiến ra mắt năm 2027).

- Vera Rubin: Hiệu năng 50 petaflops FP4 (dấu phẩy động 4-bit).

- Rubin Ultra: Kết hợp hai GPU Rubin, hiệu năng 100 petaflops FP4, bộ nhớ 1TB.

Một cụm NVL576 của Rubin Ultra được cho là có hiệu năng gấp 14 lần so với cụm Blackwell Ultra. Nvidia cho biết, Vera Rubin NVL576 sẽ được đặt trong thiết kế giá đỡ máy chủ làm mát bằng chất lỏng mới, có tên là Kyber Rack.

Sau kiến trúc Vera Rubin, Nvidia dự kiến sẽ ra mắt kiến trúc Feynman vào năm 2028.

Máy tính cá nhân AI DGX: Sức mạnh AI ngay tại nhà

Nvidia giới thiệu hai mẫu máy tính cá nhân AI: DGX Spark và DGX Station, được gọi là "siêu máy tính để bàn". Cả hai đều chạy chip Blackwell Ultra, được thiết kế để hỗ trợ các nhà phát triển chạy các mô hình AI suy luận lớn ngay tại nhà, thay vì phải sử dụng các hệ thống lớn.

- DGX Spark: Xử lý tới 1.000 nghìn tỷ phép tính mỗi giây, hỗ trợ tinh chỉnh AI và suy luận với các mô hình AI mới nhất.

- DGX Station: Bộ nhớ 784GB, hỗ trợ mạng 800Gb/s, hiệu năng AI 20 petaflops.

Chip mạng quang tử silicon Spectrum-X và Quantum-X

Nvidia cũng giới thiệu bộ đôi chip mạng quang tử silicon mới, giúp kết nối hàng triệu GPU trên nhiều địa điểm khác nhau trong các "nhà máy AI" (trung tâm dữ liệu), đồng thời giảm đáng kể mức tiêu thụ năng lượng.

- Spectrum-X: Tăng tốc hiệu suất mạng AI lên 1,6 lần so với Ethernet truyền thống.

- Quantum-X: Chip mạng 800 Gb/giây đầu cuối, hiệu suất cao, thiết kế cho AI quy mô lớn.

Phần mềm Dynamo: Tối ưu hóa suy luận AI

Nvidia Dynamo là nền tảng suy luận mô-đun, mã nguồn mở, phục vụ các mô hình AI tạo sinh trong môi trường phân tán. Phần mềm này giúp mở rộng quy mô khối lượng công việc suy luận GPU lớn, đồng thời tối ưu hóa quản lý bộ nhớ và truyền dữ liệu.

Dynamo hỗ trợ tất cả các nền tảng AI suy luận và tối ưu hóa các mô hình ngôn ngữ lớn (LLM) phổ biến, như DeepSeek-R1 và Llama. Phần mềm này được phát hành miễn phí.

Nvidia Isaac GR00T N1: Nền tảng cho robot hình người

GR00T N1 là mô hình được Nvidia thiết kế cho robot hình người, được gọi là "nền tảng robot hình người mở đầu tiên trên thế giới". Nó được trang bị hệ thống "kép" giúp robot có thể "suy nghĩ nhanh" (phản xạ) và "suy nghĩ chậm" (đưa ra quyết định có chủ đích).

"Bộ khung" cho GR00T N1 bao gồm Newton, một công cụ vật lý nguồn mở được phát triển cùng với Google DeepMind và Disney Research. Nó có thể khái quát hóa các tác vụ thông thường như cầm nắm, di chuyển đồ vật, và thực hiện các tác vụ nhiều bước.

Các đối tác tiếp cận sớm với GR00T N1 bao gồm Agility Robotics, Boston Dynamics, Mentee Robotics và NEURA Robotics. Isaac GR00T N1 dự kiến công bố vào cuối năm nay.

Tại GTC 2025, Nvidia đã thể hiện rõ tham vọng thống trị thị trường AI, không chỉ bằng phần cứng (chip) mà còn bằng phần mềm và nền tảng. Những công bố của Nvidia cho thấy công ty đang nỗ lực để đáp ứng nhu cầu ngày càng tăng của thị trường AI, và định hình tương lai của công nghệ này.

#robothìnhngười