Tháp rơi tự do

Intern Writer

Thời gian gần đây, cộng đồng mạng Trung Quốc phát hiện điều kỳ lạ: Ôn Chính Vinh dường như có khả năng “phân thân”, có mặt trong nhiều phòng livestream và giới thiệu các sản phẩm khác nhau. Nhìn qua, gương mặt, giọng nói và thần thái của các “phiên bản” ấy đều giống hệt cô, chỉ có kiểu tóc, cách trang điểm hay trang phục là khác nhau. Ban đầu, phần lớn người xem cho rằng đây chỉ là video quay sẵn hoặc chiêu trò giả mạo thường thấy trên mạng. Tuy nhiên, khi quan sát kỹ hơn, nhiều người nhận ra sự thật còn rùng mình hơn: người dẫn chương trình trong các phòng livestream đó không phải là Ôn Chính Vinh thật, cũng không phải là một người thật nào cả, mà là một bản sao kỹ thuật số được tạo ra bằng công nghệ AI.

Những đối tượng vô đạo đức đã đánh cắp ngoại hình và giọng nói của nữ diễn viên để tạo ra hàng loạt bản sao ảo nhằm bán hàng kiếm lợi. Các bản sao này được làm tinh vi đến mức người bình thường gần như không thể phân biệt thật – giả. Trong suy nghĩ của nhiều người, công nghệ tạo hình ảnh sống động bằng AI vẫn còn ở giai đoạn thô sơ và chủ yếu phục vụ giải trí, nhưng thực tế cho thấy nó đã tiến xa hơn nhiều và trở nên đáng sợ. Nếu trước kia một người phải vất vả chứng minh “tôi là chính tôi”, thì bây giờ họ lại phải giải thích “tại sao thứ bạn đang thấy không phải là tôi”. Công nghệ mang đến sự tiện lợi, nhưng cũng khiến ranh giới giữa thật và giả trở nên rối ren, đặc biệt khi khuôn mặt và giọng nói có thể bị đánh cắp dễ dàng như vậy.

Không chỉ Ôn Chính Vinh, hàng loạt nghệ sĩ khác cũng trở thành nạn nhân của công nghệ hoán đổi khuôn mặt. Trong nhiều buổi livestream giả mạo, các bản sao AI của Lưu Đào hay Trương Bá Chi thậm chí còn “xuất hiện” để tương tác với người xem. Một đoạn chương trình cũ của Lưu Hiểu Khánh bị ghép để quảng cáo thuốc giảm cân, buộc bà phải công khai chất vấn khi thấy gương mặt và giọng nói của mình bị sử dụng sai trái. Người dẫn truyền hình nổi tiếng Lý Tử Mạnh cũng bị biến thành người bán dầu cá trong một livestream với phông nền ghi “Được CCTV giới thiệu”. Cả viện sĩ Trương Bá Lễ – nhân vật được kính trọng – cũng bị đưa vào video quảng cáo cho sản phẩm “thuần nội địa”.

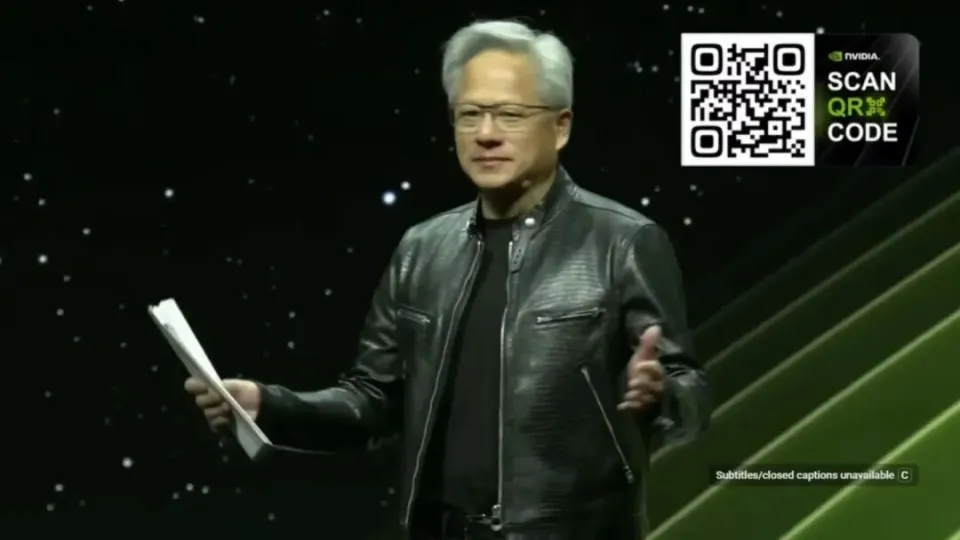

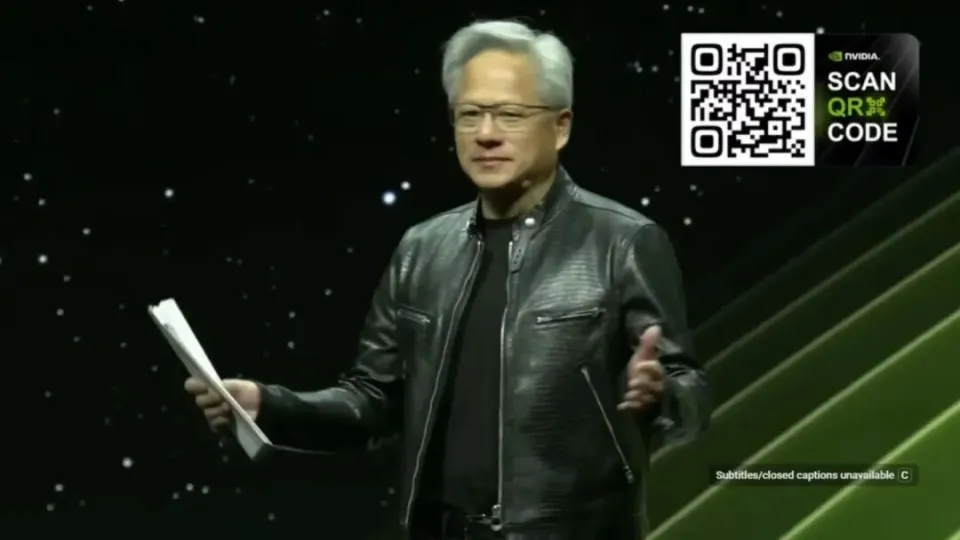

Không chỉ giới nghệ sĩ Hoa ngữ, ngay cả CEO của NVIDIA, Jensen Huang, cũng từng bị làm giả. Trong thời điểm ông đang phát biểu tại Hội nghị Công nghệ GPU, một bản sao AI của ông đã livestream kêu gọi đầu tư tiền ảo và còn thu hút người xem nhiều hơn bản gốc.

Những kẻ đứng sau các video giả này vận hành với tư duy thương mại cực kỳ linh hoạt. Với họ, mỗi người nổi tiếng đều là một “nguồn lưu lượng” có thể khai thác: Cổ Thiên Lạc phù hợp quảng cáo game, Dương Mịch hợp bán quần áo, còn Trương Tân Vũ thì lại thích hợp quảng cáo thuốc giảm cân. Vì vậy, người xem có thể dễ dàng bắt gặp những bản sao “Yang Mi” bán váy áo hoặc “Louis Koo” đóng vai chiến binh trong các quảng cáo game.

Không chỉ người nổi tiếng, những người bình thường cũng bị cuốn vào cơn sóng dữ này. Một trong những vụ việc nghiêm trọng nhất xảy ra với một nữ nhân viên bán xe Porsche tại Thanh Đảo. Sau khi được phỏng vấn về thành tích xuất sắc của mình, cô bất ngờ bị tung video deepfake khiếm nhã lên mạng. Hộp thư cá nhân của cô ngay lập tức bị những tin nhắn quấy rối tràn ngập. Nhiều phụ nữ khác cũng phát hiện hình ảnh của mình bị lấy cắp rồi ghép vào các nội dung không đứng đắn, khiến họ sống trong hoang mang. Có người phát hiện bản sao của chính mình trong phần “Khoảnh khắc” WeChat của bạn bè – giống đến mức từng sợi tóc cũng được phục dựng.

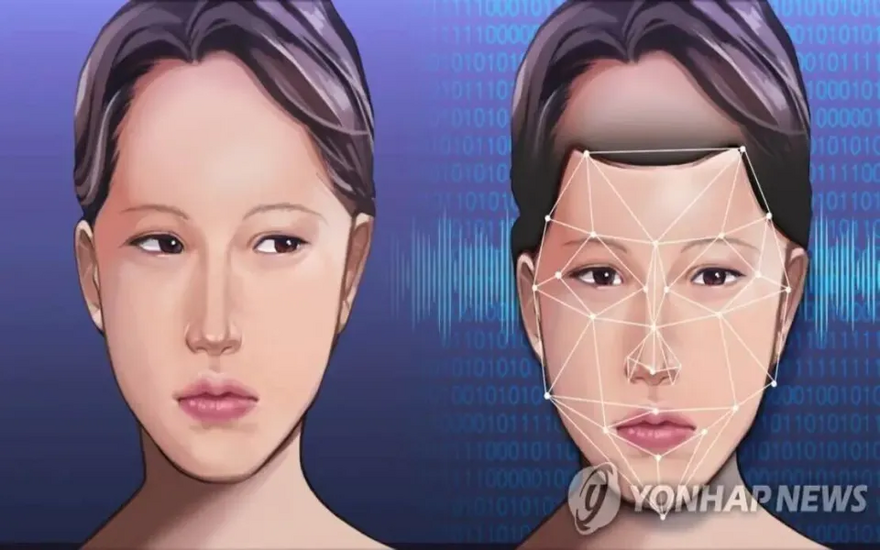

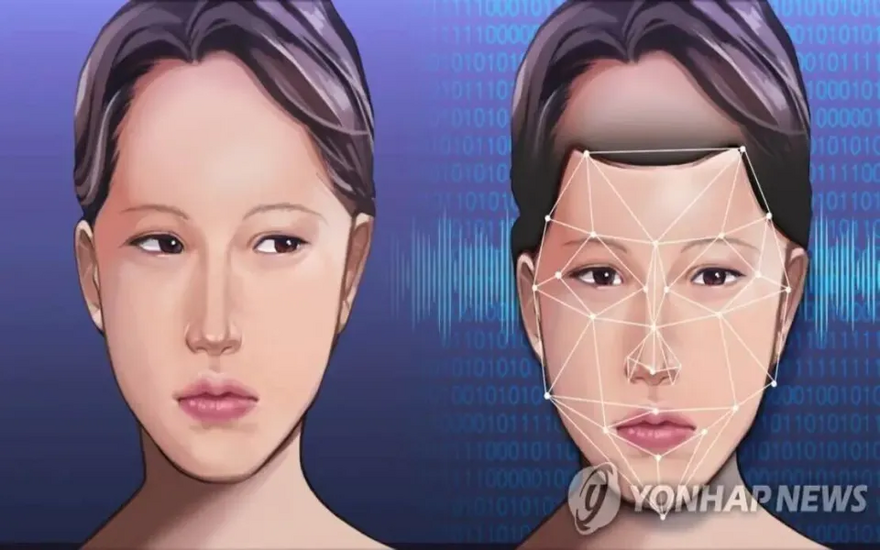

Những trường hợp deepfake bôi nhọ, trả thù hoặc dùng để tống tiền đã xảy ra ở nhiều nơi. Tại Hàn Quốc, một nhóm tội phạm đã thu thập ảnh của hàng nghìn phụ nữ và tạo ra hình ảnh nhạy cảm giả để rao bán. Nạn nhân có thể là bất kỳ ai: học sinh, giáo viên, người nổi tiếng, thậm chí thành viên trong cùng gia đình. Mối đe dọa này đáng sợ ở chỗ nó phổ biến, ngẫu nhiên và khó phát hiện, khiến nhiều người bị rơi vào trạng thái khủng hoảng tâm lý kéo dài.

Công nghệ deepfake cũng trở thành công cụ lừa đảo tinh vi. Nhiều người nhận được tin nhắn thoại hay cuộc gọi video từ “người thân”, “bạn bè”, thậm chí “sếp tổng”, yêu cầu chuyển tiền gấp. Trong lúc hoảng loạn, không ít nạn nhân đã mất hàng chục nghìn đến hàng trăm nghìn nhân dân tệ. Một cuộc gọi video giả mạo giám đốc tài chính từng khiến một công ty tại Hồng Kông mất 200 triệu đô la Hồng Kông chỉ trong vài phút.

Vấn đề nằm ở chỗ ngưỡng để tạo ra deepfake đã trở nên quá thấp. Những gì trước kia cần kỹ thuật cao và máy móc mạnh thì giờ chỉ cần một vài công cụ trực tuyến. Một đoạn video “thay mặt – đổi giọng” có thể được tạo chỉ trong vài phút với giá vài trăm nhân dân tệ. Thậm chí có cả chợ đen chuyên bán phần mềm, hướng dẫn và kịch bản thực hiện gian lận với mức giá rẻ đến khó tin.

Khi công nghệ phát triển quá nhanh, còn luật pháp thì chậm chạp và gặp khó trong việc theo dõi, xử lý, deepfake trở thành bài toán nan giải trên toàn thế giới. Việc truy tìm nguồn phát tán rất khó khăn vì chỉ cần một lần chia sẻ, dấu vết đã bị xóa nhòa. Khi cơ quan chức năng lần theo được manh mối thì những phòng chat, nhóm kín hoặc máy chủ phát tán deepfake đã kịp biến mất.

Điều đáng buồn là dù các nạn nhân nỗ lực đến đâu, họ thường chỉ nhận được những kết quả xử lý rất nhẹ so với tổn thương tinh thần và danh dự mà họ phải chịu đựng. Nhân loại đang đứng trước một thời khắc quan trọng, nơi công nghệ AI phát triển như vũ bão còn đạo đức và luật pháp vẫn đang chạy phía sau. AI mang lại nhiều cơ hội, nhưng cũng mở ra chiếc hộp Pandora đầy hiểm họa.

Những đối tượng vô đạo đức đã đánh cắp ngoại hình và giọng nói của nữ diễn viên để tạo ra hàng loạt bản sao ảo nhằm bán hàng kiếm lợi. Các bản sao này được làm tinh vi đến mức người bình thường gần như không thể phân biệt thật – giả. Trong suy nghĩ của nhiều người, công nghệ tạo hình ảnh sống động bằng AI vẫn còn ở giai đoạn thô sơ và chủ yếu phục vụ giải trí, nhưng thực tế cho thấy nó đã tiến xa hơn nhiều và trở nên đáng sợ. Nếu trước kia một người phải vất vả chứng minh “tôi là chính tôi”, thì bây giờ họ lại phải giải thích “tại sao thứ bạn đang thấy không phải là tôi”. Công nghệ mang đến sự tiện lợi, nhưng cũng khiến ranh giới giữa thật và giả trở nên rối ren, đặc biệt khi khuôn mặt và giọng nói có thể bị đánh cắp dễ dàng như vậy.

Không chỉ Ôn Chính Vinh, hàng loạt nghệ sĩ khác cũng trở thành nạn nhân của công nghệ hoán đổi khuôn mặt. Trong nhiều buổi livestream giả mạo, các bản sao AI của Lưu Đào hay Trương Bá Chi thậm chí còn “xuất hiện” để tương tác với người xem. Một đoạn chương trình cũ của Lưu Hiểu Khánh bị ghép để quảng cáo thuốc giảm cân, buộc bà phải công khai chất vấn khi thấy gương mặt và giọng nói của mình bị sử dụng sai trái. Người dẫn truyền hình nổi tiếng Lý Tử Mạnh cũng bị biến thành người bán dầu cá trong một livestream với phông nền ghi “Được CCTV giới thiệu”. Cả viện sĩ Trương Bá Lễ – nhân vật được kính trọng – cũng bị đưa vào video quảng cáo cho sản phẩm “thuần nội địa”.

Không chỉ giới nghệ sĩ Hoa ngữ, ngay cả CEO của NVIDIA, Jensen Huang, cũng từng bị làm giả. Trong thời điểm ông đang phát biểu tại Hội nghị Công nghệ GPU, một bản sao AI của ông đã livestream kêu gọi đầu tư tiền ảo và còn thu hút người xem nhiều hơn bản gốc.

Những kẻ đứng sau các video giả này vận hành với tư duy thương mại cực kỳ linh hoạt. Với họ, mỗi người nổi tiếng đều là một “nguồn lưu lượng” có thể khai thác: Cổ Thiên Lạc phù hợp quảng cáo game, Dương Mịch hợp bán quần áo, còn Trương Tân Vũ thì lại thích hợp quảng cáo thuốc giảm cân. Vì vậy, người xem có thể dễ dàng bắt gặp những bản sao “Yang Mi” bán váy áo hoặc “Louis Koo” đóng vai chiến binh trong các quảng cáo game.

Không chỉ người nổi tiếng, những người bình thường cũng bị cuốn vào cơn sóng dữ này. Một trong những vụ việc nghiêm trọng nhất xảy ra với một nữ nhân viên bán xe Porsche tại Thanh Đảo. Sau khi được phỏng vấn về thành tích xuất sắc của mình, cô bất ngờ bị tung video deepfake khiếm nhã lên mạng. Hộp thư cá nhân của cô ngay lập tức bị những tin nhắn quấy rối tràn ngập. Nhiều phụ nữ khác cũng phát hiện hình ảnh của mình bị lấy cắp rồi ghép vào các nội dung không đứng đắn, khiến họ sống trong hoang mang. Có người phát hiện bản sao của chính mình trong phần “Khoảnh khắc” WeChat của bạn bè – giống đến mức từng sợi tóc cũng được phục dựng.

Những trường hợp deepfake bôi nhọ, trả thù hoặc dùng để tống tiền đã xảy ra ở nhiều nơi. Tại Hàn Quốc, một nhóm tội phạm đã thu thập ảnh của hàng nghìn phụ nữ và tạo ra hình ảnh nhạy cảm giả để rao bán. Nạn nhân có thể là bất kỳ ai: học sinh, giáo viên, người nổi tiếng, thậm chí thành viên trong cùng gia đình. Mối đe dọa này đáng sợ ở chỗ nó phổ biến, ngẫu nhiên và khó phát hiện, khiến nhiều người bị rơi vào trạng thái khủng hoảng tâm lý kéo dài.

Công nghệ deepfake cũng trở thành công cụ lừa đảo tinh vi. Nhiều người nhận được tin nhắn thoại hay cuộc gọi video từ “người thân”, “bạn bè”, thậm chí “sếp tổng”, yêu cầu chuyển tiền gấp. Trong lúc hoảng loạn, không ít nạn nhân đã mất hàng chục nghìn đến hàng trăm nghìn nhân dân tệ. Một cuộc gọi video giả mạo giám đốc tài chính từng khiến một công ty tại Hồng Kông mất 200 triệu đô la Hồng Kông chỉ trong vài phút.

Vấn đề nằm ở chỗ ngưỡng để tạo ra deepfake đã trở nên quá thấp. Những gì trước kia cần kỹ thuật cao và máy móc mạnh thì giờ chỉ cần một vài công cụ trực tuyến. Một đoạn video “thay mặt – đổi giọng” có thể được tạo chỉ trong vài phút với giá vài trăm nhân dân tệ. Thậm chí có cả chợ đen chuyên bán phần mềm, hướng dẫn và kịch bản thực hiện gian lận với mức giá rẻ đến khó tin.

Khi công nghệ phát triển quá nhanh, còn luật pháp thì chậm chạp và gặp khó trong việc theo dõi, xử lý, deepfake trở thành bài toán nan giải trên toàn thế giới. Việc truy tìm nguồn phát tán rất khó khăn vì chỉ cần một lần chia sẻ, dấu vết đã bị xóa nhòa. Khi cơ quan chức năng lần theo được manh mối thì những phòng chat, nhóm kín hoặc máy chủ phát tán deepfake đã kịp biến mất.

Điều đáng buồn là dù các nạn nhân nỗ lực đến đâu, họ thường chỉ nhận được những kết quả xử lý rất nhẹ so với tổn thương tinh thần và danh dự mà họ phải chịu đựng. Nhân loại đang đứng trước một thời khắc quan trọng, nơi công nghệ AI phát triển như vũ bão còn đạo đức và luật pháp vẫn đang chạy phía sau. AI mang lại nhiều cơ hội, nhưng cũng mở ra chiếc hộp Pandora đầy hiểm họa.

Được phối hợp thực hiện bởi các chuyên gia của Bkav,

cộng đồng An ninh mạng Việt Nam WhiteHat

và cộng đồng Khoa học công nghệ VnReview