myle.vnreview

Writer

Thế giới điện tử hiện nay rất thú vị, chủ yếu là do hàng loạt đợt tăng giá và thay đổi liên tục trong ngành. Hầu hết các điều chỉnh giá này đều do tình trạng thiếu chip liên tục gây ra bởi AI, dẫn đến giá RAM tăng cao, từ đó làm tăng giá máy tính. Giá của máy chơi game, TV thông minh và các thiết bị tiện ích khác cũng đang tăng lên. Tuy nhiên, có thể có một vị cứu tinh đang đến, khi Google đã công bố chi tiết về một hệ thống nén mới được thiết kế để giúp AI quản lý RAM hiệu quả hơn, từ đó giúp các trung tâm dữ liệu khổng lồ mới mọc lên cần ít RAM hơn.

Matthew Prince, CEO và đồng sáng lập của Cloudflare, cho biết thuật toán này là "DeepSeek của Google", chắc chắn là ám chỉ đến việc AI DeepSeek trở nên phổ biến nhờ cải thiện đáng kể cách huấn luyện và sử dụng tài nguyên của các mô hình ngôn ngữ lớn. Việc nhận được nhiều lời khen ngợi như vậy dành cho TurboQuant – tên gọi của thuật toán hiệu quả mới của Google – thật thú vị. Nhưng vẫn còn hai câu hỏi chưa được giải đáp.

Tại sao người tiêu dùng lại quan tâm đến sự tiến bộ này, và chính xác thì điều này sẽ ảnh hưởng đến giá RAM như thế nào trong dài hạn? Trước hết, nó có thể làm giảm nhu cầu về RAM trong các trung tâm dữ liệu, điều này có thể giúp cải thiện nguồn cung cho người tiêu dùng.

Phân tích chi tiết

Bạn có lẽ đã nhận thấy chúng tôi nói "có thể" ở trên, và có một lý do rất quan trọng cho điều đó. Thứ nhất, TurboQuant vẫn chưa thực sự được đưa vào sử dụng. Về cơ bản, đây chỉ là nghiên cứu mà Google đã chia sẻ thông tin. Mặc dù công ty cho biết nó có thể cải thiện hiệu suất sử dụng RAM của AI, nhưng có lẽ nó sẽ không tạo ra sự khác biệt trong một thời gian ngắn. Và ngay cả khi nó được triển khai trong các trung tâm dữ liệu, nó cũng có thể không làm giảm lượng RAM cần thiết.

Đó là bởi vì giá trị hiện tại của bộ nhớ đệm khóa giá trị (key-value cache) – được sử dụng để lưu trữ ngữ cảnh bộ nhớ để AI không phải tính toán lại những thứ tương tự nhiều lần – là một nút thắt cổ chai lớn đối với AI. Với hiệu suất được tăng cường, bạn có thể lưu trữ nhiều hơn trong bộ nhớ key-value cache mà không cần ghi đè. Tuy nhiên, nếu bạn tiếp tục bổ sung thêm RAM cho hệ thống, thì việc huấn luyện các mô hình mới hơn, mạnh mẽ hơn sẽ trở nên khả thi.

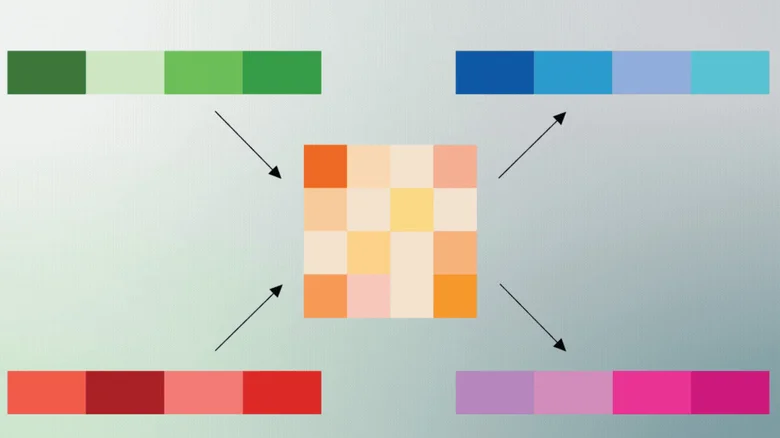

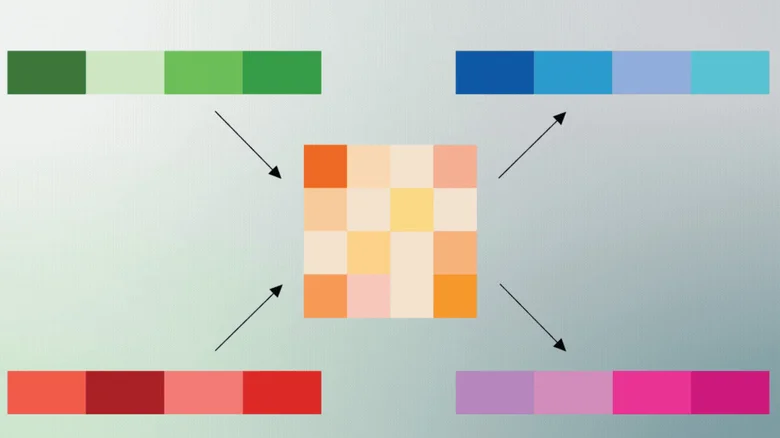

Cách dễ hiểu nhất là hãy tưởng tượng rằng các mô hình AI lưu trữ tất cả ngữ cảnh cần thiết để thực hiện các cuộc hội thoại với người dùng giống như hình ảnh trong một thư mục. Những hình ảnh này sau đó được lưu trữ trong bộ nhớ key-value cache. Tuy nhiên, khi càng nhiều hình ảnh lấp đầy không gian đó, việc AI phân tích thông tin một cách hiệu quả càng trở nên khó khăn hơn. Một cách để giảm thiểu điều này là tiếp tục bổ sung thêm không gian cho bộ nhớ cache — đó là lúc việc mở rộng RAM phát huy tác dụng. Về cơ bản, TurboQuant hoạt động bằng cách lấy những hình ảnh này và nén chúng thành kích thước nhỏ hơn, đồng thời phân loại chúng dễ theo dõi hơn, để nó có thể lưu trữ và xử lý nhiều hơn. Rõ ràng là còn nhiều yếu tố khác nữa, nhưng ý tưởng cơ bản sẽ tương tự dựa trên cách Google giải thích.

Sự thật phũ phàng

Cuối cùng, điều này có nghĩa là nhu cầu về RAM trong các trung tâm dữ liệu gây ra hiện tượng tăng giá có thể giảm nhẹ, dẫn đến giá thành thấp hơn. Tuy nhiên, không có gì đảm bảo điều này sẽ xảy ra, đặc biệt là khi rất nhiều công ty đang thúc đẩy việc tạo ra các mô hình mới hơn, mạnh mẽ hơn, và với tất cả các tính năng AI mới được phát hành trên nhiều nền tảng khác nhau.

Google, OpenAI và nhiều công ty khác liên tục phát triển các công cụ AI của họ và cho ra mắt các mô hình mới và được cải tiến. Do đó, kích thước của bộ nhớ key-value cache cần thiết để duy trì hoạt động trơn tru cho hàng trăm nghìn người có thể sử dụng AI dù chỉ một lần mỗi ngày sẽ tiếp tục tăng lên.

Tuy nhiên, việc thuật toán mới của Google mang lại một chút giảm nhẹ khó khăn là điều đáng mừng. Hy vọng rằng, khi các công ty AI tiếp tục đổi mới, chúng ta sẽ thấy những thay đổi và cập nhật khác giúp RAM trở nên ít quan trọng hơn đối với AI. Tuy nhiên, hiện tại, khó có thể coi đây là một giải pháp lâu dài cho vấn đề, đặc biệt là khi cung và cầu đã mất cân bằng nghiêm trọng đến mức chúng ta đang chứng kiến tình trạng thiếu hụt trên diện rộng.

Nguồn: BGR

Matthew Prince, CEO và đồng sáng lập của Cloudflare, cho biết thuật toán này là "DeepSeek của Google", chắc chắn là ám chỉ đến việc AI DeepSeek trở nên phổ biến nhờ cải thiện đáng kể cách huấn luyện và sử dụng tài nguyên của các mô hình ngôn ngữ lớn. Việc nhận được nhiều lời khen ngợi như vậy dành cho TurboQuant – tên gọi của thuật toán hiệu quả mới của Google – thật thú vị. Nhưng vẫn còn hai câu hỏi chưa được giải đáp.

Tại sao người tiêu dùng lại quan tâm đến sự tiến bộ này, và chính xác thì điều này sẽ ảnh hưởng đến giá RAM như thế nào trong dài hạn? Trước hết, nó có thể làm giảm nhu cầu về RAM trong các trung tâm dữ liệu, điều này có thể giúp cải thiện nguồn cung cho người tiêu dùng.

Phân tích chi tiết

Bạn có lẽ đã nhận thấy chúng tôi nói "có thể" ở trên, và có một lý do rất quan trọng cho điều đó. Thứ nhất, TurboQuant vẫn chưa thực sự được đưa vào sử dụng. Về cơ bản, đây chỉ là nghiên cứu mà Google đã chia sẻ thông tin. Mặc dù công ty cho biết nó có thể cải thiện hiệu suất sử dụng RAM của AI, nhưng có lẽ nó sẽ không tạo ra sự khác biệt trong một thời gian ngắn. Và ngay cả khi nó được triển khai trong các trung tâm dữ liệu, nó cũng có thể không làm giảm lượng RAM cần thiết.

Đó là bởi vì giá trị hiện tại của bộ nhớ đệm khóa giá trị (key-value cache) – được sử dụng để lưu trữ ngữ cảnh bộ nhớ để AI không phải tính toán lại những thứ tương tự nhiều lần – là một nút thắt cổ chai lớn đối với AI. Với hiệu suất được tăng cường, bạn có thể lưu trữ nhiều hơn trong bộ nhớ key-value cache mà không cần ghi đè. Tuy nhiên, nếu bạn tiếp tục bổ sung thêm RAM cho hệ thống, thì việc huấn luyện các mô hình mới hơn, mạnh mẽ hơn sẽ trở nên khả thi.

Cách dễ hiểu nhất là hãy tưởng tượng rằng các mô hình AI lưu trữ tất cả ngữ cảnh cần thiết để thực hiện các cuộc hội thoại với người dùng giống như hình ảnh trong một thư mục. Những hình ảnh này sau đó được lưu trữ trong bộ nhớ key-value cache. Tuy nhiên, khi càng nhiều hình ảnh lấp đầy không gian đó, việc AI phân tích thông tin một cách hiệu quả càng trở nên khó khăn hơn. Một cách để giảm thiểu điều này là tiếp tục bổ sung thêm không gian cho bộ nhớ cache — đó là lúc việc mở rộng RAM phát huy tác dụng. Về cơ bản, TurboQuant hoạt động bằng cách lấy những hình ảnh này và nén chúng thành kích thước nhỏ hơn, đồng thời phân loại chúng dễ theo dõi hơn, để nó có thể lưu trữ và xử lý nhiều hơn. Rõ ràng là còn nhiều yếu tố khác nữa, nhưng ý tưởng cơ bản sẽ tương tự dựa trên cách Google giải thích.

Sự thật phũ phàng

Cuối cùng, điều này có nghĩa là nhu cầu về RAM trong các trung tâm dữ liệu gây ra hiện tượng tăng giá có thể giảm nhẹ, dẫn đến giá thành thấp hơn. Tuy nhiên, không có gì đảm bảo điều này sẽ xảy ra, đặc biệt là khi rất nhiều công ty đang thúc đẩy việc tạo ra các mô hình mới hơn, mạnh mẽ hơn, và với tất cả các tính năng AI mới được phát hành trên nhiều nền tảng khác nhau.

Google, OpenAI và nhiều công ty khác liên tục phát triển các công cụ AI của họ và cho ra mắt các mô hình mới và được cải tiến. Do đó, kích thước của bộ nhớ key-value cache cần thiết để duy trì hoạt động trơn tru cho hàng trăm nghìn người có thể sử dụng AI dù chỉ một lần mỗi ngày sẽ tiếp tục tăng lên.

Tuy nhiên, việc thuật toán mới của Google mang lại một chút giảm nhẹ khó khăn là điều đáng mừng. Hy vọng rằng, khi các công ty AI tiếp tục đổi mới, chúng ta sẽ thấy những thay đổi và cập nhật khác giúp RAM trở nên ít quan trọng hơn đối với AI. Tuy nhiên, hiện tại, khó có thể coi đây là một giải pháp lâu dài cho vấn đề, đặc biệt là khi cung và cầu đã mất cân bằng nghiêm trọng đến mức chúng ta đang chứng kiến tình trạng thiếu hụt trên diện rộng.

Nguồn: BGR