Dũng Đỗ

Writer

DeepSeek, startup AI đến từ Trung Quốc đang gây tiếng vang trên thị trường quốc tế, vừa âm thầm phát hành mô hình ngôn ngữ lớn (LLM) mới có tên DeepSeek-V3-0324 trên nền tảng Hugging Face. Sự xuất hiện của mô hình 641GB này đang gây xôn xao trong ngành công nghiệp trí tuệ nhân tạo (AI), không chỉ bởi hiệu năng ấn tượng mà còn bởi cách tiếp cận "mở" và miễn phí, thách thức trực tiếp mô hình kinh doanh của OpenAI.

Những điểm chính:

Điểm nổi bật nhất của DeepSeek-V3-0324 là việc mô hình này được phát hành dưới giấy phép MIT, cho phép sử dụng miễn phí cho mục đích thương mại. Đây là một động thái "gây sốc", đi ngược lại với mô hình kinh doanh của các "ông lớn" AI như OpenAI, vốn thường giữ kín các mô hình của mình và cung cấp quyền truy cập thông qua các API trả phí.

Công nghệ đột phá: Mixture-of-Experts (MoE), MLA và MTP

DeepSeek-V3-0324 không đi theo hướng phát triển các mô hình AI "khổng lồ" (với hàng nghìn tỷ tham số) như các công ty Mỹ. Thay vào đó, DeepSeek áp dụng kiến trúc "mixture-of-experts" (MoE) độc đáo, giúp tối ưu hóa hiệu suất và giảm chi phí.

Chạy AI 'khủng' trên máy tính cá nhân

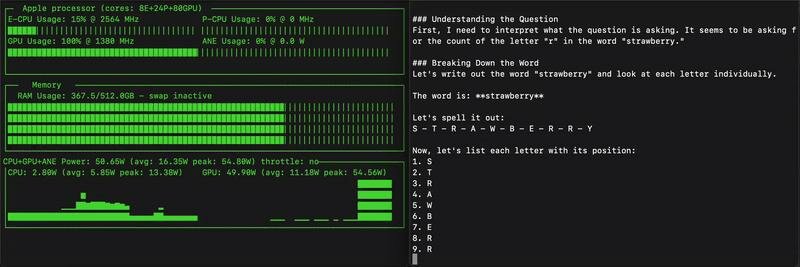

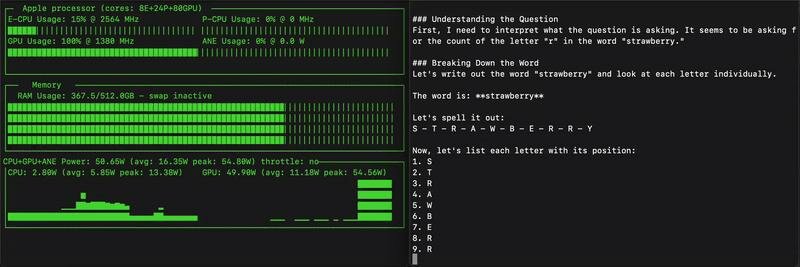

Một điểm đáng chú ý khác là DeepSeek-V3-0324 có thể chạy trực tiếp trên các máy tính cá nhân cao cấp, như Apple Mac Studio với chip M3 Ultra.

Nhà nghiên cứu AI Awni Hannun cho biết, DeepSeek-V3-0324 phiên bản 4-bit có thể chạy với tốc độ trên 20 token/giây trên Mac Studio M3 Ultra 512GB.

Mặc dù Mac Studio có giá không hề rẻ (9.499 USD), nhưng việc một mô hình AI lớn có thể chạy cục bộ trên máy tính cá nhân là một bước tiến quan trọng, cho thấy tiềm năng của việc "dân chủ hóa" AI.

DeepSeek-R2: 'Ẩn số' tiếp theo

DeepSeek-V3-0324 được xem là nền tảng cho DeepSeek-R2, một mô hình tập trung vào khả năng suy luận (reasoning) được cải tiến, dự kiến ra mắt trong vài tháng tới. Nếu DeepSeek-R2 đi theo quỹ đạo của R1 (phiên bản trước), nó có thể sẽ thách thức trực tiếp GPT-5, mô hình hàng đầu tiếp theo của OpenAI.

Trung Quốc 'rút ngắn' khoảng cách với Mỹ trong cuộc đua AI

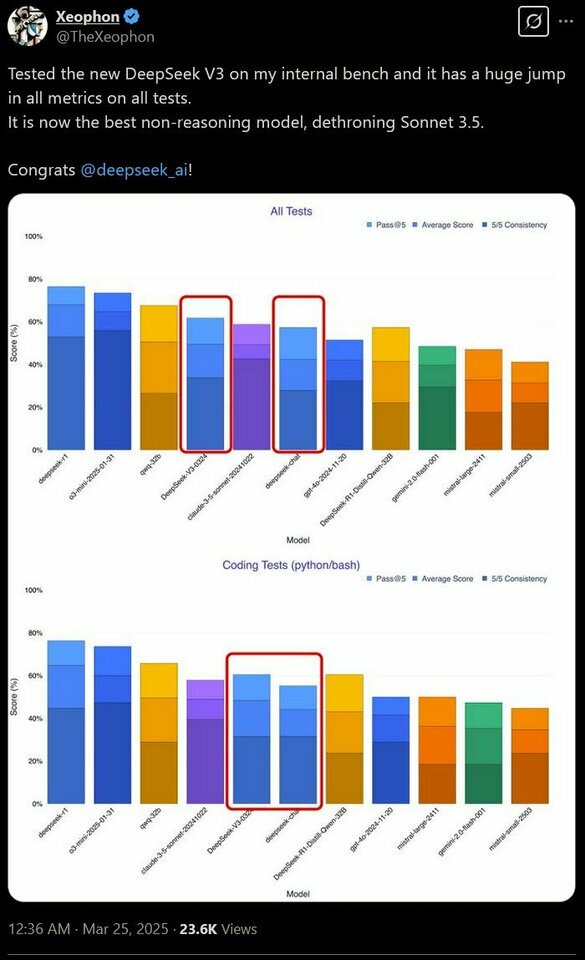

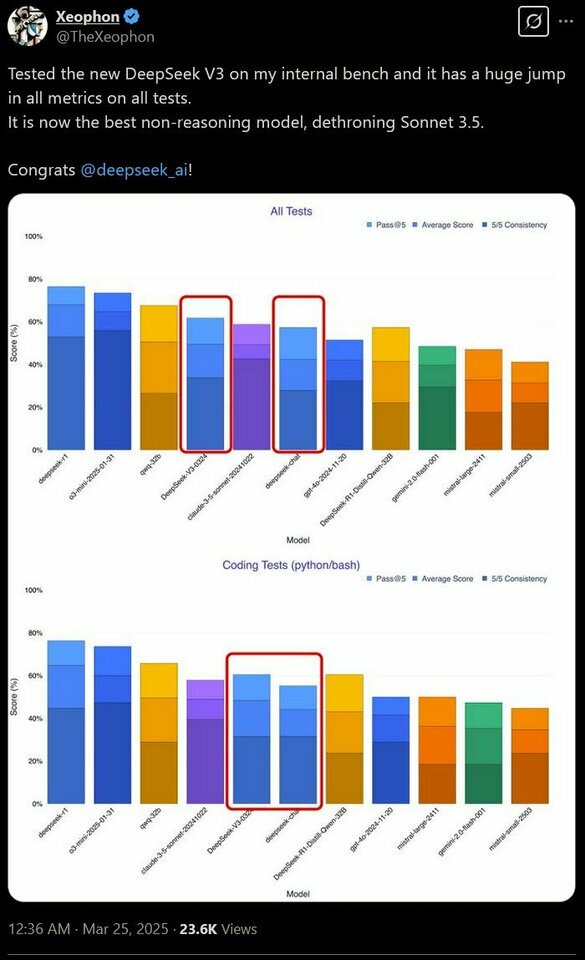

Sự xuất hiện của DeepSeek-V3-0324 cho thấy Trung Quốc đang nhanh chóng thu hẹp khoảng cách với Mỹ trong lĩnh vực AI. Chỉ vài tháng trước, các nhà phân tích ước tính Trung Quốc tụt hậu 1-2 năm so với Mỹ về khả năng AI. Nhưng giờ đây, khoảng cách đó đã được rút ngắn xuống còn 3-6 tháng, và một số lĩnh vực thậm chí còn ngang bằng hoặc vượt trội.

Mô hình nguồn mở: Thách thức sự độc quyền của các 'ông lớn'

Cách tiếp cận của DeepSeek, với việc cung cấp AI tiên tiến miễn phí theo giấy phép mở, đang thách thức mô hình kinh doanh độc quyền của các công ty như OpenAI. Nó cho thấy, các mô hình AI nguồn mở có thể cạnh tranh với các hệ thống đóng, nhờ vào sự phổ biến rộng rãi và sức mạnh đổi mới tập thể từ hàng nghìn nhà phát triển trên toàn cầu.

DeepSeek-V3-0324 là một bước tiến quan trọng trong lĩnh vực AI, cho thấy tiềm năng của các mô hình nguồn mở, hiệu quả về chi phí, và có thể chạy trên phần cứng tiêu dùng. Sự xuất hiện của DeepSeek đang làm thay đổi cục diện cuộc đua AI, và đặt ra những câu hỏi về tương lai của ngành công nghiệp này.

#DeepSeek

Những điểm chính:

- DeepSeek ra mắt mô hình ngôn ngữ lớn (LLM) mới DeepSeek-V3-0324, mã nguồn mở, miễn phí cho mục đích thương mại.

- Mô hình này sử dụng kiến trúc "mixture-of-experts" (MoE) độc đáo, giúp tăng hiệu suất và giảm chi phí.

- DeepSeek-V3-0324 tích hợp công nghệ Multi-Head Latent Attention (MLA) và Multi-Token Prediction (MTP), tăng tốc độ xử lý.

- Mô hình có thể chạy trực tiếp trên máy tính cá nhân cao cấp (ví dụ: Apple Mac Studio với chip M3 Ultra), không cần đến trung tâm dữ liệu.

- DeepSeek-V3-0324 được xem là nền tảng cho DeepSeek-R2, một mô hình tập trung vào khả năng suy luận, dự kiến ra mắt trong vài tháng tới.

Điểm nổi bật nhất của DeepSeek-V3-0324 là việc mô hình này được phát hành dưới giấy phép MIT, cho phép sử dụng miễn phí cho mục đích thương mại. Đây là một động thái "gây sốc", đi ngược lại với mô hình kinh doanh của các "ông lớn" AI như OpenAI, vốn thường giữ kín các mô hình của mình và cung cấp quyền truy cập thông qua các API trả phí.

Công nghệ đột phá: Mixture-of-Experts (MoE), MLA và MTP

DeepSeek-V3-0324 không đi theo hướng phát triển các mô hình AI "khổng lồ" (với hàng nghìn tỷ tham số) như các công ty Mỹ. Thay vào đó, DeepSeek áp dụng kiến trúc "mixture-of-experts" (MoE) độc đáo, giúp tối ưu hóa hiệu suất và giảm chi phí.

- Mixture-of-Experts (MoE): Thay vì kích hoạt toàn bộ tham số cho mọi tác vụ, MoE chỉ sử dụng một phần nhỏ (khoảng 37 tỷ trong tổng số 685 tỷ tham số) cho từng tác vụ cụ thể. Điều này giúp tăng hiệu suất và giảm yêu cầu tính toán.

- Multi-Head Latent Attention (MLA): Nâng cao khả năng duy trì ngữ cảnh của mô hình trong các đoạn văn bản dài.

- Multi-Token Prediction (MTP): Cho phép mô hình tạo ra nhiều token (đơn vị ngôn ngữ) mỗi bước, thay vì chỉ một token như các phương pháp truyền thống.

Chạy AI 'khủng' trên máy tính cá nhân

Một điểm đáng chú ý khác là DeepSeek-V3-0324 có thể chạy trực tiếp trên các máy tính cá nhân cao cấp, như Apple Mac Studio với chip M3 Ultra.

Nhà nghiên cứu AI Awni Hannun cho biết, DeepSeek-V3-0324 phiên bản 4-bit có thể chạy với tốc độ trên 20 token/giây trên Mac Studio M3 Ultra 512GB.

Mặc dù Mac Studio có giá không hề rẻ (9.499 USD), nhưng việc một mô hình AI lớn có thể chạy cục bộ trên máy tính cá nhân là một bước tiến quan trọng, cho thấy tiềm năng của việc "dân chủ hóa" AI.

DeepSeek-R2: 'Ẩn số' tiếp theo

DeepSeek-V3-0324 được xem là nền tảng cho DeepSeek-R2, một mô hình tập trung vào khả năng suy luận (reasoning) được cải tiến, dự kiến ra mắt trong vài tháng tới. Nếu DeepSeek-R2 đi theo quỹ đạo của R1 (phiên bản trước), nó có thể sẽ thách thức trực tiếp GPT-5, mô hình hàng đầu tiếp theo của OpenAI.

Trung Quốc 'rút ngắn' khoảng cách với Mỹ trong cuộc đua AI

Sự xuất hiện của DeepSeek-V3-0324 cho thấy Trung Quốc đang nhanh chóng thu hẹp khoảng cách với Mỹ trong lĩnh vực AI. Chỉ vài tháng trước, các nhà phân tích ước tính Trung Quốc tụt hậu 1-2 năm so với Mỹ về khả năng AI. Nhưng giờ đây, khoảng cách đó đã được rút ngắn xuống còn 3-6 tháng, và một số lĩnh vực thậm chí còn ngang bằng hoặc vượt trội.

Mô hình nguồn mở: Thách thức sự độc quyền của các 'ông lớn'

Cách tiếp cận của DeepSeek, với việc cung cấp AI tiên tiến miễn phí theo giấy phép mở, đang thách thức mô hình kinh doanh độc quyền của các công ty như OpenAI. Nó cho thấy, các mô hình AI nguồn mở có thể cạnh tranh với các hệ thống đóng, nhờ vào sự phổ biến rộng rãi và sức mạnh đổi mới tập thể từ hàng nghìn nhà phát triển trên toàn cầu.

DeepSeek-V3-0324 là một bước tiến quan trọng trong lĩnh vực AI, cho thấy tiềm năng của các mô hình nguồn mở, hiệu quả về chi phí, và có thể chạy trên phần cứng tiêu dùng. Sự xuất hiện của DeepSeek đang làm thay đổi cục diện cuộc đua AI, và đặt ra những câu hỏi về tương lai của ngành công nghiệp này.

#DeepSeek