404 Not Found

Writer

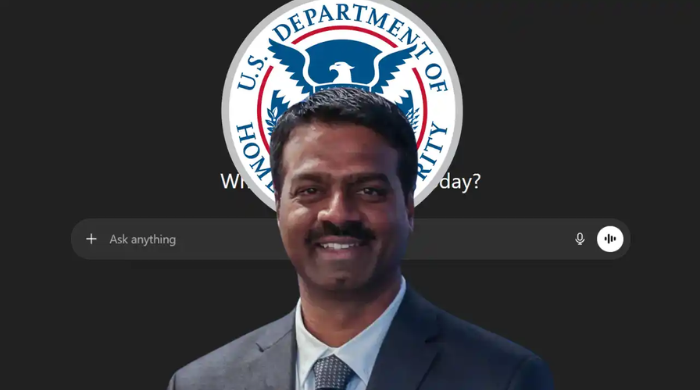

Nếu đây là một tình huống giả lập trong lớp học an toàn thông tin, hẳn giảng viên sẽ dừng ngay ở ví dụ đầu tiên và nói: “Đây là điều tuyệt đối không được làm”. Trớ trêu là câu chuyện đó lại xảy ra ngoài đời thật và nhân vật chính không phải người mới vào nghề, mà là quyền Giám đốc Cơ quan An ninh mạng và Hạ tầng Mỹ (CISA).

Giữa tháng 7/2025, ông Madhu Gottumukkala đã tải một số tài liệu hợp đồng của chính phủ Mỹ lên ChatGPT công khai. Các tài liệu này được gắn nhãn “for official use only”, tức chỉ dùng trong nội bộ và không được phép đưa lên các nền tảng bên ngoài. Chúng không phải tài liệu tuyệt mật, nhưng vẫn cần được kiểm soát chặt chẽ vì liên quan đến hoạt động của chính phủ.

Đáng chú ý, ngay khi tiếp quản CISA vào tháng 5/2025, ông Gottumukkala đã xin được đặc cách sử dụng ChatGPT, trong khi toàn bộ nhân viên Bộ An ninh Nội địa Mỹ (DHS) khi đó vẫn bị cấm dùng các công cụ AI công khai do lo ngại rò rỉ dữ liệu. Quyết định này được đưa ra với mục tiêu tận dụng AI cho công việc điều hành và phân tích. Trên lý thuyết, đó là một bước đi hiện đại. Nhưng thực tế lại dẫn tới đúng kịch bản mà các cơ quan an ninh thường xuyên cảnh báo.

Sự việc không bị phát hiện ngay. ChatGPT vẫn hoạt động bình thường, phản hồi nhanh và tiện lợi, không có bất kỳ cảnh báo nào cho người dùng. Chỉ vài tuần sau, đầu tháng 8, các hệ thống giám sát của DHS mới phát hiện dấu hiệu bất thường. Những cảnh báo về thất thoát dữ liệu lần lượt được kích hoạt, cho thấy thông tin nhạy cảm đã rời khỏi các môi trường được phê duyệt.

Việc kiểm tra nhanh chóng chỉ ra nguồn gốc sự cố không đến từ tin tặc hay tấn công mạng, mà từ một tài khoản nội bộ có quyền rất cao. Sai sót không nằm ở hệ thống, mà nằm ở cách con người sử dụng công nghệ. Một thao tác hoàn toàn hợp lệ về mặt kỹ thuật lại vi phạm những nguyên tắc cơ bản nhất về bảo vệ thông tin.

DHS khẳng định các tài liệu không chứa thông tin tình báo phân loại và không có bằng chứng cho thấy dữ liệu bị khai thác hay phát tán có chủ đích. Tuy vậy, sự cố vẫn được đánh giá là một thất bại nghiêm trọng về an ninh vận hành, bởi CISA là cơ quan đặt ra tiêu chuẩn bảo vệ dữ liệu cho toàn bộ hệ thống liên bang Mỹ.

Sau vụ việc, quyền truy cập ChatGPT của ông Gottumukkala đã bị thu hồi và các đánh giá nội bộ được tiến hành. Không có khủng hoảng truyền thông lớn, nhưng câu chuyện này nhanh chóng trở thành lời cảnh tỉnh rõ ràng về cách sử dụng AI trong môi trường xử lý thông tin nhạy cảm.

Vấn đề không nằm ở việc AI nguy hiểm đến đâu. Rủi ro xuất hiện khi dữ liệu được đặt sai chỗ và người dùng tin rằng hệ thống phía sau sẽ tự lo mọi thứ. Trong thời đại AI, đôi khi một thói quen tiện lợi cũng đủ để tạo ra lỗ hổng, không cần đến bất kỳ cuộc tấn công mạng nào.

Theo whitehat.vn

Được phối hợp thực hiện bởi các chuyên gia của Bkav,

cộng đồng An ninh mạng Việt Nam WhiteHat

và cộng đồng Khoa học công nghệ VnReview