CyberThao

Writer

Một bước tiến mới trong việc vũ khí hóa trí tuệ nhân tạo (AI) đã được ghi nhận khi các đối tượng tấn công mạng sử dụng v0 – công cụ AI của Vercel – để nhanh chóng tạo ra các trang đăng nhập giả mạo, sao chép y hệt giao diện của các trang hợp pháp.

Công cụ AI giúp kẻ xấu tạo trang giả nhanh, dễ và không cần biết lập trình

Theo các nhà nghiên cứu của Okta Threat Intelligence, Houssem Eddine Bordjiba và Paula De la Hoz, các đối tượng xấu hiện đã có thể tạo ra trang phishing (lừa đảo) hoàn chỉnh chỉ bằng những đoạn mô tả bằng văn bản đơn giản nhờ vào sức mạnh của AI tạo sinh (Generative AI). Điều này cho thấy xu hướng lợi dụng công nghệ AI để tối ưu hóa hành vi tấn công mạng đang trở nên rõ ràng và đáng báo động.

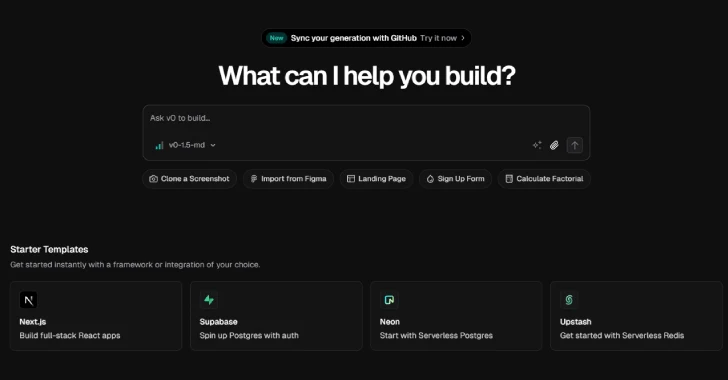

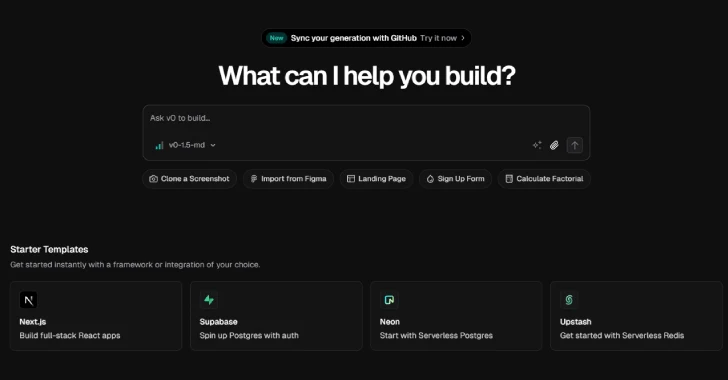

Cụ thể, v0 là công cụ AI của Vercel cho phép tạo nhanh các trang web hoặc ứng dụng cơ bản chỉ bằng cách nhập yêu cầu bằng ngôn ngữ tự nhiên. Những kẻ đứng sau các chiến dịch lừa đảo đã lợi dụng v0 để tạo ra bản sao của các trang đăng nhập từ nhiều thương hiệu lớn – bao gồm cả một khách hàng chưa được nêu tên của chính Okta.

Không chỉ dừng lại ở giao diện đăng nhập giả, những đối tượng này còn lưu trữ logo và tài nguyên giả mạo trên chính hạ tầng của Vercel, tận dụng độ tin cậy vốn có của nền tảng để che mắt người dùng và vượt qua các biện pháp phát hiện.

Vercel đã nhanh chóng phản hồi sau khi được thông báo và ngăn chặn quyền truy cập vào các trang web giả mạo đó. Tuy nhiên, mối lo ngại không nằm ở một vài trang bị chặn, mà là việc các công cụ AI như v0 (và các phiên bản mã nguồn mở trên GitHub) giúp bất kỳ ai – kể cả người không biết lập trình – có thể tạo trang lừa đảo chỉ bằng một câu lệnh. Điều này mở đường cho làn sóng tấn công mạng quy mô lớn từ cả những đối tượng không chuyên.

Làn sóng AI không kiểm duyệt và mối đe dọa thật sự

Sự việc này còn phản ánh một xu hướng lớn hơn: tội phạm mạng đang dần chuyển sang sử dụng các mô hình ngôn ngữ lớn (LLM) không kiểm duyệt. Một trong số đó là WhiteRabbitNeo – mô hình AI được quảng bá dành riêng cho các đội ngũ DevSecOps, nhưng lại được thiết kế phục vụ cho mục đích bất chính.

Theo chuyên gia Jaeson Schultz của Cisco Talos, những LLM không kiểm duyệt này không bị giới hạn bởi các quy tắc đạo đức hay bộ lọc an toàn, do đó chúng có thể dễ dàng sinh ra các nội dung độc hại, nhạy cảm hay gây tranh cãi theo yêu cầu của người dùng. Điều này khiến chúng trở thành công cụ lý tưởng cho các hoạt động phạm pháp.

Phishing – hình thức tấn công lừa đảo qua mạng – đang thay đổi chóng mặt. Giờ đây không chỉ là email giả hay trang đăng nhập giả, mà còn có giọng nói nhân tạo, video deepfake và các thủ đoạn tấn công xã hội tinh vi hơn, tất cả đều được hỗ trợ bởi AI. Kẻ tấn công không chỉ lừa người dùng, mà còn tạo cả hệ thống lừa đảo tự động hóa ở quy mô lớn.

Đọc chi tiết tại đây: https://thehackernews.com/2025/07/vercels-v0-ai-tool-weaponized-by.html

Công cụ AI giúp kẻ xấu tạo trang giả nhanh, dễ và không cần biết lập trình

Theo các nhà nghiên cứu của Okta Threat Intelligence, Houssem Eddine Bordjiba và Paula De la Hoz, các đối tượng xấu hiện đã có thể tạo ra trang phishing (lừa đảo) hoàn chỉnh chỉ bằng những đoạn mô tả bằng văn bản đơn giản nhờ vào sức mạnh của AI tạo sinh (Generative AI). Điều này cho thấy xu hướng lợi dụng công nghệ AI để tối ưu hóa hành vi tấn công mạng đang trở nên rõ ràng và đáng báo động.

Cụ thể, v0 là công cụ AI của Vercel cho phép tạo nhanh các trang web hoặc ứng dụng cơ bản chỉ bằng cách nhập yêu cầu bằng ngôn ngữ tự nhiên. Những kẻ đứng sau các chiến dịch lừa đảo đã lợi dụng v0 để tạo ra bản sao của các trang đăng nhập từ nhiều thương hiệu lớn – bao gồm cả một khách hàng chưa được nêu tên của chính Okta.

Không chỉ dừng lại ở giao diện đăng nhập giả, những đối tượng này còn lưu trữ logo và tài nguyên giả mạo trên chính hạ tầng của Vercel, tận dụng độ tin cậy vốn có của nền tảng để che mắt người dùng và vượt qua các biện pháp phát hiện.

Vercel đã nhanh chóng phản hồi sau khi được thông báo và ngăn chặn quyền truy cập vào các trang web giả mạo đó. Tuy nhiên, mối lo ngại không nằm ở một vài trang bị chặn, mà là việc các công cụ AI như v0 (và các phiên bản mã nguồn mở trên GitHub) giúp bất kỳ ai – kể cả người không biết lập trình – có thể tạo trang lừa đảo chỉ bằng một câu lệnh. Điều này mở đường cho làn sóng tấn công mạng quy mô lớn từ cả những đối tượng không chuyên.

Làn sóng AI không kiểm duyệt và mối đe dọa thật sự

Sự việc này còn phản ánh một xu hướng lớn hơn: tội phạm mạng đang dần chuyển sang sử dụng các mô hình ngôn ngữ lớn (LLM) không kiểm duyệt. Một trong số đó là WhiteRabbitNeo – mô hình AI được quảng bá dành riêng cho các đội ngũ DevSecOps, nhưng lại được thiết kế phục vụ cho mục đích bất chính.

Theo chuyên gia Jaeson Schultz của Cisco Talos, những LLM không kiểm duyệt này không bị giới hạn bởi các quy tắc đạo đức hay bộ lọc an toàn, do đó chúng có thể dễ dàng sinh ra các nội dung độc hại, nhạy cảm hay gây tranh cãi theo yêu cầu của người dùng. Điều này khiến chúng trở thành công cụ lý tưởng cho các hoạt động phạm pháp.

Phishing – hình thức tấn công lừa đảo qua mạng – đang thay đổi chóng mặt. Giờ đây không chỉ là email giả hay trang đăng nhập giả, mà còn có giọng nói nhân tạo, video deepfake và các thủ đoạn tấn công xã hội tinh vi hơn, tất cả đều được hỗ trợ bởi AI. Kẻ tấn công không chỉ lừa người dùng, mà còn tạo cả hệ thống lừa đảo tự động hóa ở quy mô lớn.

Đọc chi tiết tại đây: https://thehackernews.com/2025/07/vercels-v0-ai-tool-weaponized-by.html

Được phối hợp thực hiện bởi các chuyên gia của Bkav,

cộng đồng An ninh mạng Việt Nam WhiteHat

và cộng đồng Khoa học công nghệ VnReview