From Beijing with Love

Cháu đã lớn thế này rồi à. Lại đây chú ôm cái coi.

Ngay sau khi OpenAI phát hành GPT-5.5, DeepSeek lập tức phản đòn bằng một động thái không ai ngờ tới.

DeepSeek-V4 vừa ra mắt phiên bản xem trước và công bố mã nguồn mở. Điểm nổi bật nhất không phải là hiệu suất, mà là lần đầu tiên một mô hình AI quy mô nghìn tỷ tham số hoàn thành toàn bộ quá trình huấn luyện và suy luận trên chip nội địa Trung Quốc, cụ thể là chip Ascend của Huawei, thay vì phụ thuộc vào GPU Nvidia hay framework nước ngoài.

Đây là bước đi mang tính biểu tượng lớn hơn là một bản nâng cấp kỹ thuật thông thường.

Hiệu suất ở đâu so với các tên tuổi lớn?

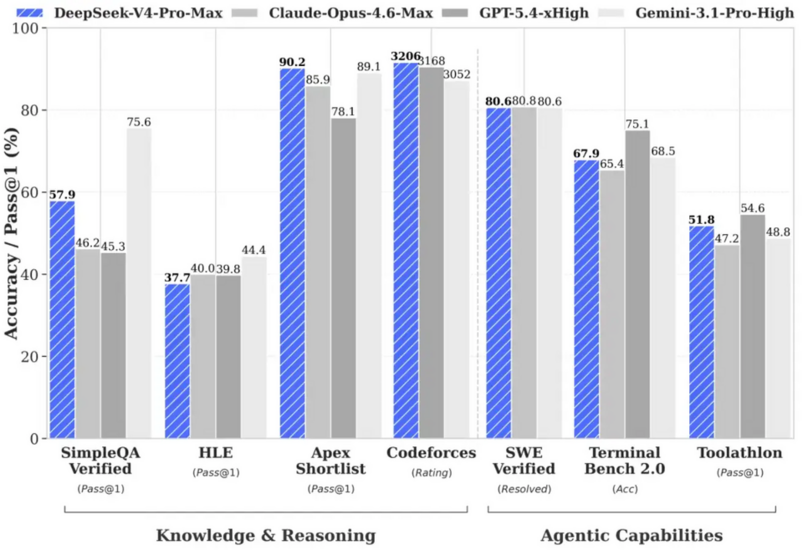

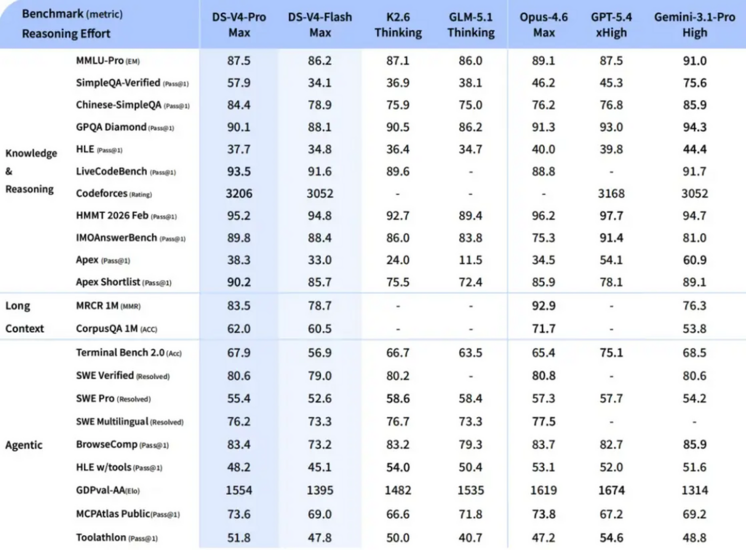

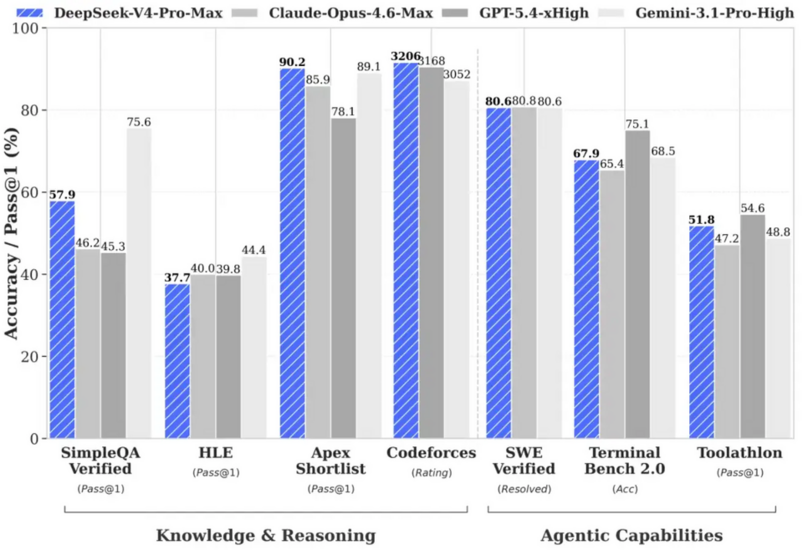

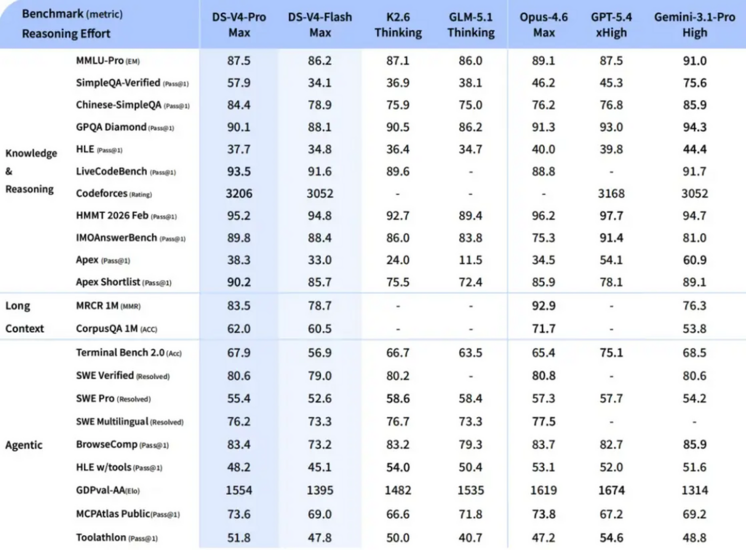

DeepSeek tự đánh giá khá thận trọng. Về kiến thức và suy luận, V4 đã vượt các mô hình mã nguồn mở chính thống và tiệm cận Gemini của Google, nhưng vẫn còn khoảng cách khoảng 3 đến 6 tháng. Về tác vụ lập trình và agent (tức là AI tự thực thi nhiệm vụ phức tạp), V4 đạt ngang hoặc thậm chí vượt Claude Sonnet ở một số hạng mục. Nội bộ DeepSeek cũng dùng V4 như công cụ lập trình chính, đánh giá trải nghiệm tốt hơn Sonnet 4.5 và gần với Opus 4.6 ở chế độ không suy nghĩ.

Tuy nhiên, vẫn còn khoảng cách rõ ràng so với Opus 4.6 ở chế độ tư duy sâu.

Giá là lợi thế cạnh tranh rõ nhất

So sánh với Claude, DeepSeek-V4 có mức giá rẻ hơn 21 lần. Đây là con số do DeepSeek công bố, không phải ước tính. Mô hình có hai phiên bản gồm V4-Pro tập trung hiệu suất và V4-Flash tập trung tốc độ, chi phí thấp, phù hợp cho các tác vụ đơn giản. Cả hai đều hỗ trợ ngữ cảnh lên tới 1 triệu token, tức là có thể đọc và xử lý một lượng văn bản khổng lồ trong một lần.

DeepSeek cũng cho biết giá V4-Pro sẽ còn giảm thêm sau khi hàng loạt siêu nút Ascend 950 được triển khai vào cuối năm nay.

Kiến trúc mới giải quyết bài toán văn bản siêu dài

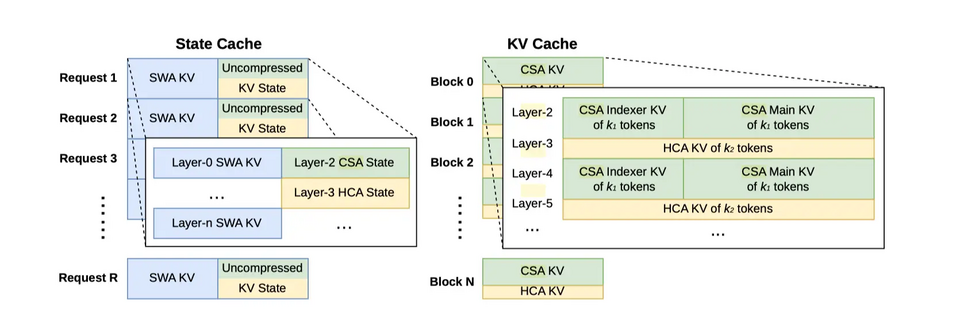

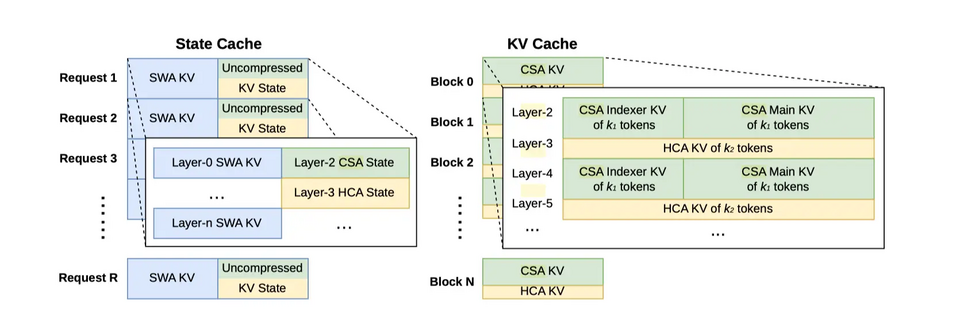

Vấn đề lớn nhất khi xử lý văn bản dài không phải là mô hình có hỗ trợ hay không, mà là chi phí tính toán tăng vọt theo cấp số nhân khiến nó gần như không thể triển khai thực tế. DeepSeek-V4 giải quyết điều này bằng kiến trúc lai CSA kết hợp HCA, trong đó CSA hoạt động như cơ chế đọc thông minh, nén và lọc nội dung quan trọng thay vì xử lý toàn bộ, còn HCA đóng vai trò tạo dàn ý tổng thể để giữ logic xuyên suốt.

Kết quả thực tế là V4-Pro chỉ cần 27% sức tính toán và 10% bộ nhớ đệm so với phiên bản V3.2 trước đó khi xử lý 1 triệu token. Phiên bản Flash còn tiết kiệm hơn nữa, chỉ cần 10% sức tính toán và 7% bộ nhớ.

Điều còn chờ kiểm chứng

Mã nguồn mở hiện tại chỉ áp dụng cho phiên bản GPU Nvidia. Phần thích ứng với chip Ascend của Huawei vẫn là mã nguồn đóng, dù đã có bên thứ ba như Cambrian hoàn thành chuyển thể và công bố lên GitHub.

Hiệu suất thực tế của V4 trong tay người dùng vẫn là câu hỏi còn bỏ ngỏ.

DeepSeek kết thúc bài công bố bằng câu: "Đừng để bị cám dỗ bởi lời khen, đừng sợ vu khống, hãy đi theo con đường và sửa chính mình." Họ khẳng định mục tiêu dài hạn vẫn là hướng tới AGI, trí tuệ nhân tạo tổng quát ngang tầm con người.

Cuộc đua vẫn đang tiếp diễn.

DeepSeek-V4 vừa ra mắt phiên bản xem trước và công bố mã nguồn mở. Điểm nổi bật nhất không phải là hiệu suất, mà là lần đầu tiên một mô hình AI quy mô nghìn tỷ tham số hoàn thành toàn bộ quá trình huấn luyện và suy luận trên chip nội địa Trung Quốc, cụ thể là chip Ascend của Huawei, thay vì phụ thuộc vào GPU Nvidia hay framework nước ngoài.

Đây là bước đi mang tính biểu tượng lớn hơn là một bản nâng cấp kỹ thuật thông thường.

Hiệu suất ở đâu so với các tên tuổi lớn?

DeepSeek tự đánh giá khá thận trọng. Về kiến thức và suy luận, V4 đã vượt các mô hình mã nguồn mở chính thống và tiệm cận Gemini của Google, nhưng vẫn còn khoảng cách khoảng 3 đến 6 tháng. Về tác vụ lập trình và agent (tức là AI tự thực thi nhiệm vụ phức tạp), V4 đạt ngang hoặc thậm chí vượt Claude Sonnet ở một số hạng mục. Nội bộ DeepSeek cũng dùng V4 như công cụ lập trình chính, đánh giá trải nghiệm tốt hơn Sonnet 4.5 và gần với Opus 4.6 ở chế độ không suy nghĩ.

Tuy nhiên, vẫn còn khoảng cách rõ ràng so với Opus 4.6 ở chế độ tư duy sâu.

Giá là lợi thế cạnh tranh rõ nhất

So sánh với Claude, DeepSeek-V4 có mức giá rẻ hơn 21 lần. Đây là con số do DeepSeek công bố, không phải ước tính. Mô hình có hai phiên bản gồm V4-Pro tập trung hiệu suất và V4-Flash tập trung tốc độ, chi phí thấp, phù hợp cho các tác vụ đơn giản. Cả hai đều hỗ trợ ngữ cảnh lên tới 1 triệu token, tức là có thể đọc và xử lý một lượng văn bản khổng lồ trong một lần.

DeepSeek cũng cho biết giá V4-Pro sẽ còn giảm thêm sau khi hàng loạt siêu nút Ascend 950 được triển khai vào cuối năm nay.

Kiến trúc mới giải quyết bài toán văn bản siêu dài

Vấn đề lớn nhất khi xử lý văn bản dài không phải là mô hình có hỗ trợ hay không, mà là chi phí tính toán tăng vọt theo cấp số nhân khiến nó gần như không thể triển khai thực tế. DeepSeek-V4 giải quyết điều này bằng kiến trúc lai CSA kết hợp HCA, trong đó CSA hoạt động như cơ chế đọc thông minh, nén và lọc nội dung quan trọng thay vì xử lý toàn bộ, còn HCA đóng vai trò tạo dàn ý tổng thể để giữ logic xuyên suốt.

Kết quả thực tế là V4-Pro chỉ cần 27% sức tính toán và 10% bộ nhớ đệm so với phiên bản V3.2 trước đó khi xử lý 1 triệu token. Phiên bản Flash còn tiết kiệm hơn nữa, chỉ cần 10% sức tính toán và 7% bộ nhớ.

Điều còn chờ kiểm chứng

Mã nguồn mở hiện tại chỉ áp dụng cho phiên bản GPU Nvidia. Phần thích ứng với chip Ascend của Huawei vẫn là mã nguồn đóng, dù đã có bên thứ ba như Cambrian hoàn thành chuyển thể và công bố lên GitHub.

Hiệu suất thực tế của V4 trong tay người dùng vẫn là câu hỏi còn bỏ ngỏ.

DeepSeek kết thúc bài công bố bằng câu: "Đừng để bị cám dỗ bởi lời khen, đừng sợ vu khống, hãy đi theo con đường và sửa chính mình." Họ khẳng định mục tiêu dài hạn vẫn là hướng tới AGI, trí tuệ nhân tạo tổng quát ngang tầm con người.

Cuộc đua vẫn đang tiếp diễn.