Tháp rơi tự do

Intern Writer

Trong vài năm qua, Nvidia đã dẫn đầu thị trường năng lực tính toán trí tuệ nhân tạo (AI).Nhờ hiệu năng mạnh mẽ và những ưu điểm của hệ sinh thái CUDA, hầu hết các mô hình quy mô lớn đều chạy trên chip của NVIDIA. Điều này đã giúp GPU của NVIDIA chiếm hơn 90% thị phần chip AI và có tỷ suất lợi nhuận gộp cao tới 75%, trở thành người chiến thắng lớn nhất trên thị trường AI.

Tuy nhiên, bức tranh tổng thể này đang bị lung lay bởi hai lực lượng cùng lúc: thứ nhất, sự chuyển dịch trọng tâm của ngành công nghiệp AI từ "huấn luyện" sang "suy luận" đã thay đổi tiêu chuẩn đo lường giá trị của sức mạnh tính toán; thứ hai, việc giảm chi phí suy luận xuống mức cực thấp bởi các mô hình quy mô lớn trong nước như DeepSeek V4 đã trực tiếp thách thức sức mạnh định giá của Nvidia.

Theo mô hình trả tiền theo giờ truyền thống, NVIDIA H100 có giá khoảng 2,95 đô la mỗi giờ, H200 khoảng 3,50 đô la mỗi giờ, và Blackwell B200 mới nhất có giá từ 4,90 đến 6,50 đô la mỗi giờ. Tuy nhiên, nếu ký hợp đồng dài hạn 1-2 năm đảm bảo mua ít nhất 10.000 GPU, giá sẽ giảm đáng kể, tương đương khoảng 1,50 đô la mỗi giờ cho H100, 2,20 đô la mỗi giờ cho H200, và hơn 3,50 đô la mỗi giờ cho B200.

Theo dữ liệu của Omdia, suy luận hiện chiếm từ 90% đến 95% khối lượng công việc AI của doanh nghiệp, và các doanh nghiệp ngày càng quan tâm đến hiệu quả thực tế của việc xử lý văn bản hoặc tạo nội dung, điều này cũng đã thúc đẩy giá cả của token. Điều này cũng có nghĩa là trong tương lai, yếu tố quyết định sẽ không còn là ai có sức mạnh tính toán đỉnh cao nhất của chip, mà là ai có chi phí xử lý token thấp nhất.

"Chi phí trên mỗi triệu token" đã trở thành một chỉ số cốt lõi để đo lường hiệu quả suy luận — tức là chi phí sức mạnh tính toán tiêu thụ để xử lý 1 triệu token (tương đương với khoảng 750.000 từ tiếng Anh hoặc 400.000 ký tự tiếng Trung). Đây là phương pháp tính phí trực quan nhất đối với người dùng và cũng là tiêu chuẩn để các nhà cung cấp dịch vụ đám mây đánh giá khả năng cạnh tranh phần cứng của họ.

Trong bối cảnh đó, các ông lớn như Google, Amazon, Meta và OpenAI đang đầu tư mạnh vào việc phát triển chip ASIC AI riêng của họ để suy luận, với hy vọng giảm chi phí trên mỗi token và thoát khỏi sự phụ thuộc vào GPU của Nvidia.

Theo một báo cáo gần đây của Goldman Sachs, TPU của Google/Broadcom đang nhanh chóng thu hẹp khoảng cách với GPU của Nvidia về chi phí suy luận. Việc nâng cấp từ TPU v6 lên v7 đã giảm chi phí suy luận trên mỗi token khoảng 70%, đưa nó ngang bằng với Nvidia GB200 NVL72, và thậm chí còn nhỉnh hơn trong một số trường hợp. Google đã sử dụng TPU để huấn luyện các mô hình của riêng mình, chẳng hạn như Gemini, và triển khai chúng cho các công ty lớn bên ngoài như Anthropic và Meta. Các nhà phân tích dự đoán rằng nếu Google mở cửa thị trường TPU cho bên thứ ba, họ có thể chiếm được 20% thị phần chip AI trong dài hạn.

Trong khi đó, Cerebras, một công ty khởi nghiệp có trụ sở tại Mỹ chuyên về chip AI, đã nộp đơn xin IPO vào ngày 17 tháng 4, với mục tiêu huy động 3 tỷ đô la và đạt mức định giá 35 tỷ đô la. Nền tảng cốt lõi của họ là thỏa thuận hợp tác với OpenAI trị giá hơn 20 tỷ đô la, nhằm giúp OpenAI " thoát khỏi sự phụ thuộc vào Nvidia" ."Xây dựng một chip suy luận AI tùy chỉnh theo chiến lược."

Nvidia cũng nhận thấy xu hướng nhu cầu về sức mạnh tính toán AI đang chuyển từ "huấn luyện" sang "suy luận" và lợi thế của chip ASIC AI về chi phí trên mỗi token. Do đó, vào năm 2025, hãng đã mua lại kiến trúc Groq LPU, vốn có ưu điểm trong các kịch bản suy luận nhẹ, với giá 20 tỷ đô la.

Theo các chuyên gia của Nebius, về tốc độ, Groq có thể xử lý 800 token mỗi giây, gần gấp đôi so với chip Nvidia (450 token mỗi giây). Về chi phí, chip Groq chỉ có giá từ 5 đến 10 cent cho mỗi triệu token, trong khi dòng B của Nvidia có giá khoảng 25 cent.

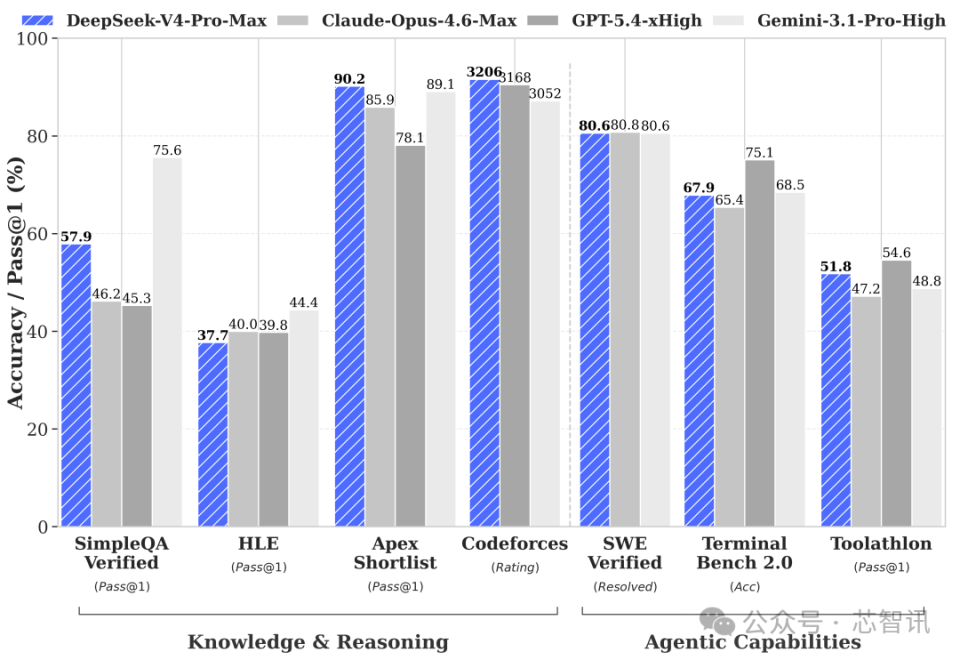

Theo các báo cáo, DeepSeek-V4-Pro và DeepSeek-V4-Flash sử dụng kiến trúc MoE, với tổng số tham số lần lượt đạt 1,6T (49 tỷ token được kích hoạt) và 284B (13 tỷ token được kích hoạt), và cả hai đều hỗ trợ ngữ cảnh lên đến 1 triệu token. DeepSeek-V4-Pro tập trung vào việc tối đa hóa hiệu suất, vượt trội hơn các mô hình mã nguồn mở được đánh giá công khai hiện nay trong các nhiệm vụ đầy thách thức như toán học, STEM và lập trình cạnh tranh. Hiệu suất tổng thể của nó gần bằng hoặc thậm chí tương đương với các mô hình mã nguồn đóng hàng đầu như GPT-5.4 và Claude Opus 4.6-Max. Mặt khác, DeepSeek-V4-Flash giảm đáng kể số lượng tham số và kích hoạt để đổi lấy độ trễ thấp hơn và chi phí thấp hơn.

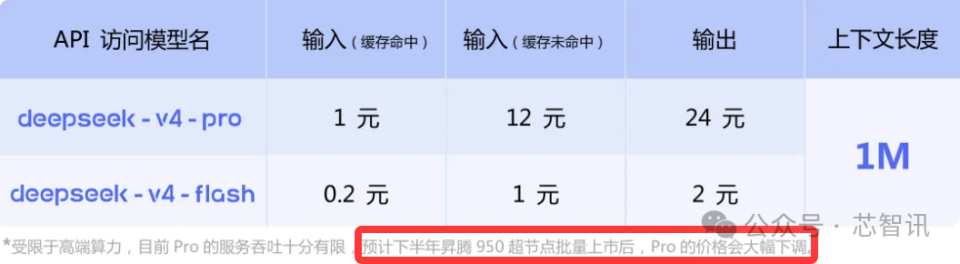

Theo DeepSeekBảng giá API được công bố cho thấy giá đầu vào của V4-Flash là 1 nhân dân tệ/triệu token, và giá đầu ra là 2 nhân dân tệ/triệu token; giá đầu vào của V4-Pro là 12 nhân dân tệ/triệu token, và giá đầu ra là 24 nhân dân tệ/triệu token.

Để so sánh, API GPT-5.5 mà OpenAI ra mắt trước đây có giá lên tới 30 đô la (khoảng 205 nhân dân tệ) cho mỗi triệu token. Điều này có nghĩa là API DeepSeek-V4 chỉ có giá bằng khoảng 1/100 so với GPT-5.5.

Yếu tố then chốt giúp giảm chi phí đáng kể cho các API thuộc dòng DeepSeek-V4 nằm ở chỗ phiên bản V4 đã thay đổi đáng kể thiết kế kiến trúc của mình theo hướng tối ưu hóa suy luận.Ví dụ, xử lý ngữ cảnh siêu dài 1 triệu bit, tối ưu hóa bộ nhớ đệm KV và hỗ trợ độ chính xác FP4—tất cả các nâng cấp công nghệ này đều hướng đến một mục tiêu: giảm chi phí suy luận trên mỗi token.

Hơn nữa, DeepSeek cũng chỉ ra trên trang giá cả của mình rằng thông lượng dịch vụ DeepSeek-V4 Pro hiện đang bị hạn chế và dự kiến Huawei Ascend 950 sẽ có mặt trên thị trường vào nửa cuối năm nay.Sau khi các siêu nút được sản xuất hàng loạt và có sẵn, giá của phiên bản Pro sẽ giảm đáng kể. Điều này cũng dường như cho thấy rằng các dịch vụ API dòng DeepSeek-V4 hiện tại cũng dựa trên chip AI Huawei Ascend.

Theo báo cáo kỹ thuật chính thức của DeepSeek, xét về hiệu năng suy luận, công nghệ song song hóa chuyên gia chi tiết tiên tiến của họ...Kiến trúc này đã được kiểm chứng đầy đủ trên chip Huawei Ascend. Trong các tác vụ suy luận thông thường, nó đạt được hiệu suất cải thiện từ 1,50 đến 1,73 lần so với các giải pháp cơ bản không hội tụ truyền thống; trong các kịch bản nhạy cảm về độ trễ, nó có thể đạt được tốc độ tăng lên đến 1,96 lần.

Cho đến nay, bao gồm cả Huawei Ascend và Cambricon...Tám nhà sản xuất chip AI lớn trong nước, bao gồm Hygon, Moore Threads, Muxi, Kunlun Chip, Pingtouge Zhenwu và Tianshu Zhixin, đã xác nhận rằng họ đã hoàn tất việc kiểm tra tính tương thích và điều chỉnh kỹ thuật cho DeepSeek V4.

Điều đáng chú ý là chỉ một tuần trước khi ra mắt dòng sản phẩm DeepSeek-V4, CEO của Nvidia, Jensen Huang, đã tuyên bố trong một cuộc phỏng vấn podcast rằng nếu DeepSeek được phát hành đầu tiên trên nền tảng của Huawei, điều đó sẽ là thảm họa đối với Hoa Kỳ. Ông Huang cũng chỉ ra rằng việc hạn chế xuất khẩu chip AI sang Trung Quốc sẽ làm chậm sự phát triển AI của Trung Quốc trong ngắn hạn, nhưng về lâu dài, điều đó chỉ buộc Trung Quốc phải hình thành hệ sinh thái riêng của mình. Rõ ràng, dự đoán của ông Huang đang trở thành hiện thực.

Tuy nhiên, bức tranh tổng thể này đang bị lung lay bởi hai lực lượng cùng lúc: thứ nhất, sự chuyển dịch trọng tâm của ngành công nghiệp AI từ "huấn luyện" sang "suy luận" đã thay đổi tiêu chuẩn đo lường giá trị của sức mạnh tính toán; thứ hai, việc giảm chi phí suy luận xuống mức cực thấp bởi các mô hình quy mô lớn trong nước như DeepSeek V4 đã trực tiếp thách thức sức mạnh định giá của Nvidia.

Từ tính phí theo giờ đến tính phí dựa trên token AI ASIC, ưu điểm trở nên rõ ràng

Mới đây, một chuyên gia từ nhà cung cấp cơ sở hạ tầng đám mây Nebius đã chỉ ra trong một cuộc phỏng vấn với AlphaSense rằng với sự trỗi dậy của các tác nhân AI, nhu cầu về sức mạnh tính toán AI đang nhanh chóng chuyển từ "huấn luyện" sang "suy luận", và mô hình định giá của ngành công nghiệp cơ sở hạ tầng AI đang trải qua một sự chuyển đổi sâu sắc. Theo truyền thống, giá sức mạnh tính toán phụ thuộc vào kiểu GPU, thời gian sử dụng và liệu chúng có được đặt trước hay không, nhưng hệ thống này đang nhanh chóng được thay thế bằng " chi phí trên mỗi triệu token" trực quan hơn."đã thay thế"Theo mô hình trả tiền theo giờ truyền thống, NVIDIA H100 có giá khoảng 2,95 đô la mỗi giờ, H200 khoảng 3,50 đô la mỗi giờ, và Blackwell B200 mới nhất có giá từ 4,90 đến 6,50 đô la mỗi giờ. Tuy nhiên, nếu ký hợp đồng dài hạn 1-2 năm đảm bảo mua ít nhất 10.000 GPU, giá sẽ giảm đáng kể, tương đương khoảng 1,50 đô la mỗi giờ cho H100, 2,20 đô la mỗi giờ cho H200, và hơn 3,50 đô la mỗi giờ cho B200.

Theo dữ liệu của Omdia, suy luận hiện chiếm từ 90% đến 95% khối lượng công việc AI của doanh nghiệp, và các doanh nghiệp ngày càng quan tâm đến hiệu quả thực tế của việc xử lý văn bản hoặc tạo nội dung, điều này cũng đã thúc đẩy giá cả của token. Điều này cũng có nghĩa là trong tương lai, yếu tố quyết định sẽ không còn là ai có sức mạnh tính toán đỉnh cao nhất của chip, mà là ai có chi phí xử lý token thấp nhất.

"Chi phí trên mỗi triệu token" đã trở thành một chỉ số cốt lõi để đo lường hiệu quả suy luận — tức là chi phí sức mạnh tính toán tiêu thụ để xử lý 1 triệu token (tương đương với khoảng 750.000 từ tiếng Anh hoặc 400.000 ký tự tiếng Trung). Đây là phương pháp tính phí trực quan nhất đối với người dùng và cũng là tiêu chuẩn để các nhà cung cấp dịch vụ đám mây đánh giá khả năng cạnh tranh phần cứng của họ.

Trong bối cảnh đó, các ông lớn như Google, Amazon, Meta và OpenAI đang đầu tư mạnh vào việc phát triển chip ASIC AI riêng của họ để suy luận, với hy vọng giảm chi phí trên mỗi token và thoát khỏi sự phụ thuộc vào GPU của Nvidia.

Theo một báo cáo gần đây của Goldman Sachs, TPU của Google/Broadcom đang nhanh chóng thu hẹp khoảng cách với GPU của Nvidia về chi phí suy luận. Việc nâng cấp từ TPU v6 lên v7 đã giảm chi phí suy luận trên mỗi token khoảng 70%, đưa nó ngang bằng với Nvidia GB200 NVL72, và thậm chí còn nhỉnh hơn trong một số trường hợp. Google đã sử dụng TPU để huấn luyện các mô hình của riêng mình, chẳng hạn như Gemini, và triển khai chúng cho các công ty lớn bên ngoài như Anthropic và Meta. Các nhà phân tích dự đoán rằng nếu Google mở cửa thị trường TPU cho bên thứ ba, họ có thể chiếm được 20% thị phần chip AI trong dài hạn.

Trong khi đó, Cerebras, một công ty khởi nghiệp có trụ sở tại Mỹ chuyên về chip AI, đã nộp đơn xin IPO vào ngày 17 tháng 4, với mục tiêu huy động 3 tỷ đô la và đạt mức định giá 35 tỷ đô la. Nền tảng cốt lõi của họ là thỏa thuận hợp tác với OpenAI trị giá hơn 20 tỷ đô la, nhằm giúp OpenAI " thoát khỏi sự phụ thuộc vào Nvidia" ."Xây dựng một chip suy luận AI tùy chỉnh theo chiến lược."

Nvidia cũng nhận thấy xu hướng nhu cầu về sức mạnh tính toán AI đang chuyển từ "huấn luyện" sang "suy luận" và lợi thế của chip ASIC AI về chi phí trên mỗi token. Do đó, vào năm 2025, hãng đã mua lại kiến trúc Groq LPU, vốn có ưu điểm trong các kịch bản suy luận nhẹ, với giá 20 tỷ đô la.

Theo các chuyên gia của Nebius, về tốc độ, Groq có thể xử lý 800 token mỗi giây, gần gấp đôi so với chip Nvidia (450 token mỗi giây). Về chi phí, chip Groq chỉ có giá từ 5 đến 10 cent cho mỗi triệu token, trong khi dòng B của Nvidia có giá khoảng 25 cent.

Không còn phụ thuộc vào GPU của Nvidia, chi phí suy luận giảm xuống còn 1/100

Ngày 24 tháng 4, một công ty công nghệ trí tuệ nhân tạo (AI) của Trung Quốc đã chính thức ra mắt dòng sản phẩm DeepSeek V4 và đồng thời công khai mã nguồn của chúng. Hiệu năng của các mẫu DeepSeek V4 series tương đương với các mẫu hàng đầu quốc tế đang trong giai đoạn mã nguồn đóng. Hơn nữa, các mẫu DeepSeek V4 series được tối ưu hóa sâu rộng cho các chip AI trong nước như Huawei Ascend, và các dịch vụ API được cung cấp cũng chủ yếu dựa trên các chip AI trong nước như Huawei Ascend, không còn phụ thuộc vào GPU của NVIDIA, và tiết kiệm chi phí hơn.Theo các báo cáo, DeepSeek-V4-Pro và DeepSeek-V4-Flash sử dụng kiến trúc MoE, với tổng số tham số lần lượt đạt 1,6T (49 tỷ token được kích hoạt) và 284B (13 tỷ token được kích hoạt), và cả hai đều hỗ trợ ngữ cảnh lên đến 1 triệu token. DeepSeek-V4-Pro tập trung vào việc tối đa hóa hiệu suất, vượt trội hơn các mô hình mã nguồn mở được đánh giá công khai hiện nay trong các nhiệm vụ đầy thách thức như toán học, STEM và lập trình cạnh tranh. Hiệu suất tổng thể của nó gần bằng hoặc thậm chí tương đương với các mô hình mã nguồn đóng hàng đầu như GPT-5.4 và Claude Opus 4.6-Max. Mặt khác, DeepSeek-V4-Flash giảm đáng kể số lượng tham số và kích hoạt để đổi lấy độ trễ thấp hơn và chi phí thấp hơn.

Theo DeepSeekBảng giá API được công bố cho thấy giá đầu vào của V4-Flash là 1 nhân dân tệ/triệu token, và giá đầu ra là 2 nhân dân tệ/triệu token; giá đầu vào của V4-Pro là 12 nhân dân tệ/triệu token, và giá đầu ra là 24 nhân dân tệ/triệu token.

Để so sánh, API GPT-5.5 mà OpenAI ra mắt trước đây có giá lên tới 30 đô la (khoảng 205 nhân dân tệ) cho mỗi triệu token. Điều này có nghĩa là API DeepSeek-V4 chỉ có giá bằng khoảng 1/100 so với GPT-5.5.

Yếu tố then chốt giúp giảm chi phí đáng kể cho các API thuộc dòng DeepSeek-V4 nằm ở chỗ phiên bản V4 đã thay đổi đáng kể thiết kế kiến trúc của mình theo hướng tối ưu hóa suy luận.Ví dụ, xử lý ngữ cảnh siêu dài 1 triệu bit, tối ưu hóa bộ nhớ đệm KV và hỗ trợ độ chính xác FP4—tất cả các nâng cấp công nghệ này đều hướng đến một mục tiêu: giảm chi phí suy luận trên mỗi token.

Hơn nữa, DeepSeek cũng chỉ ra trên trang giá cả của mình rằng thông lượng dịch vụ DeepSeek-V4 Pro hiện đang bị hạn chế và dự kiến Huawei Ascend 950 sẽ có mặt trên thị trường vào nửa cuối năm nay.Sau khi các siêu nút được sản xuất hàng loạt và có sẵn, giá của phiên bản Pro sẽ giảm đáng kể. Điều này cũng dường như cho thấy rằng các dịch vụ API dòng DeepSeek-V4 hiện tại cũng dựa trên chip AI Huawei Ascend.

Theo báo cáo kỹ thuật chính thức của DeepSeek, xét về hiệu năng suy luận, công nghệ song song hóa chuyên gia chi tiết tiên tiến của họ...Kiến trúc này đã được kiểm chứng đầy đủ trên chip Huawei Ascend. Trong các tác vụ suy luận thông thường, nó đạt được hiệu suất cải thiện từ 1,50 đến 1,73 lần so với các giải pháp cơ bản không hội tụ truyền thống; trong các kịch bản nhạy cảm về độ trễ, nó có thể đạt được tốc độ tăng lên đến 1,96 lần.

Cho đến nay, bao gồm cả Huawei Ascend và Cambricon...Tám nhà sản xuất chip AI lớn trong nước, bao gồm Hygon, Moore Threads, Muxi, Kunlun Chip, Pingtouge Zhenwu và Tianshu Zhixin, đã xác nhận rằng họ đã hoàn tất việc kiểm tra tính tương thích và điều chỉnh kỹ thuật cho DeepSeek V4.

Điều đáng chú ý là chỉ một tuần trước khi ra mắt dòng sản phẩm DeepSeek-V4, CEO của Nvidia, Jensen Huang, đã tuyên bố trong một cuộc phỏng vấn podcast rằng nếu DeepSeek được phát hành đầu tiên trên nền tảng của Huawei, điều đó sẽ là thảm họa đối với Hoa Kỳ. Ông Huang cũng chỉ ra rằng việc hạn chế xuất khẩu chip AI sang Trung Quốc sẽ làm chậm sự phát triển AI của Trung Quốc trong ngắn hạn, nhưng về lâu dài, điều đó chỉ buộc Trung Quốc phải hình thành hệ sinh thái riêng của mình. Rõ ràng, dự đoán của ông Huang đang trở thành hiện thực.