Thanh Phong

Editor

Mô hình AI của LG vượt trội hơn DeepSeek của Trung Quốc về toán học, nhưng lại chậm hơn về khả năng ngôn ngữ.

Theo tờ báo Hàn Quốc The Chosun, LG đã giới thiệu mô hình trí tuệ nhân tạo (AI) lý luận đầu tiên của Hàn Quốc vào ngày 18/3. Không giống như AI truyền thống tìm kiếm câu trả lời từ dữ liệu đã học trước, AI lý luận đưa ra câu trả lời thông qua các quy trình suy nghĩ logic, từng bước tương tự như con người.

Một ví dụ điển hình là DeepSeek của Trung Quốc gần đây đã thu hút sự chú ý trên toàn cầu vì mô hình hiệu suất cao, tiết kiệm chi phí. Khi những gã khổng lồ công nghệ như OpenAI và DeepSeek cạnh tranh trong việc phát triển AI lý luận, mô hình mới của LG đã đưa Hàn Quốc vào cuộc đua. Tuy nhiên, LG sẽ không phát hành để sử dụng công khai mà giữ lại để phát triển sản phẩm nội bộ.

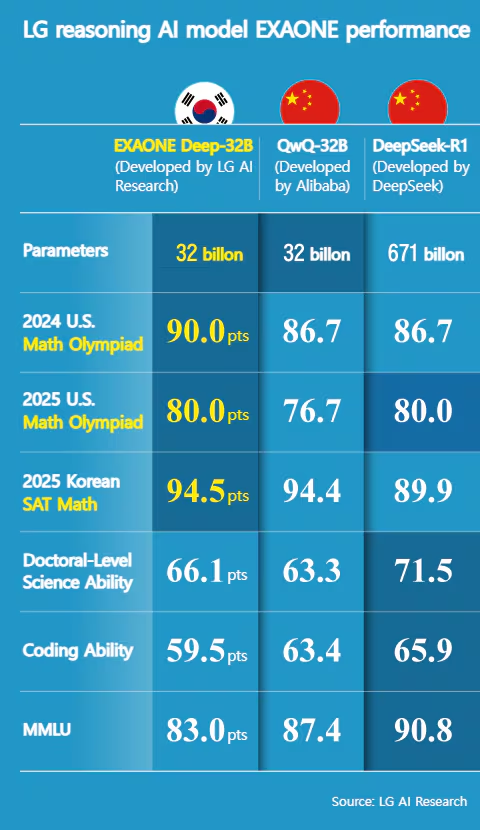

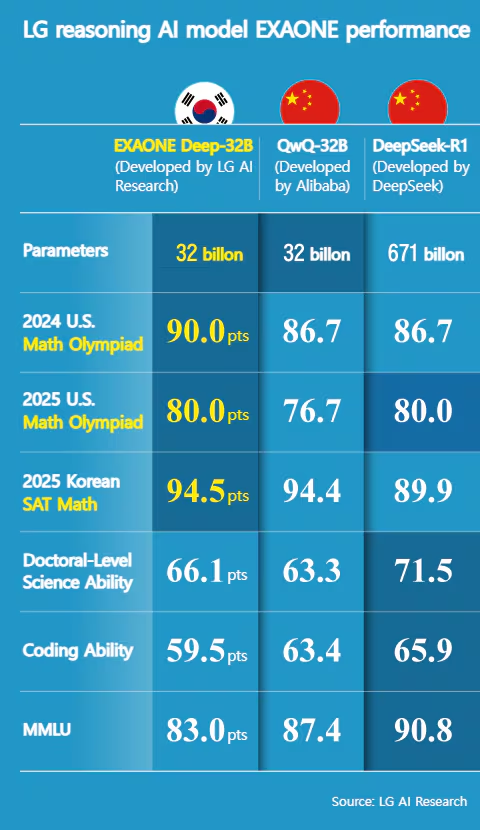

Viện nghiên cứu LG AI Research đã ra mắt Exaone Deep, với mô hình chính là Exaone Deep-32B. Mô hình này có 32 tỷ tham số, tạo điều kiện kết nối dữ liệu để AI học và lý luận. Nhiều tham số hơn thường có nghĩa là hiệu suất tốt hơn, nhưng chúng cũng yêu cầu nhiều chip AI hơn. Vì lý do này, các công ty ngày càng tập trung vào việc tối ưu hóa hiệu suất với ít tham số hơn.

R1 của DeepSeek có 671 tỷ tham số, trong khi Exaone Deep-32B chỉ có khoảng 5% trong số đó. Mặc dù vậy, các bài kiểm tra hiệu suất cho thấy mô hình của LG ngang bằng với DeepSeek-R1. Trong các so sánh chuẩn với các mô hình AI lý luận hàng đầu như DeepSeek và QwQ-32B của Alibaba, Exaone Deep-32B đặc biệt xuất sắc về toán học. Nó đạt 90 điểm trong Kỳ thi Olympic Toán học Hoa Kỳ năm 2024, vượt trội hơn DeepSeek-R1 (86,7) và QwQ-32B của Alibaba (86,7). Trong phần toán CSAT năm 2025 của Hàn Quốc, nó đạt 94,5 điểm, cao nhất trong số các mô hình cạnh tranh. Nó cũng thể hiện tốt trong các bài toán khoa học cấp tiến sĩ, đạt 66,1 điểm, cao hơn QwQ-32B của Alibaba (63,3).

Tuy nhiên, mô hình AI lý luận của LG tụt hậu về kỹ năng lập trình và ngôn ngữ. Trong bài kiểm tra Hiểu ngôn ngữ đa nhiệm hàng loạt (MMLU), nó đạt 83 điểm, theo sau Alibaba (87,4) và DeepSeek (90,8). Một chuyên gia trong ngành giải thích, "Các mô hình AI lý luận được thiết kế để giải quyết các bài toán toán học và khoa học, do đó khả năng ngôn ngữ của chúng tự nhiên tụt hậu so với các mô hình lớn hơn".

LG AI Research cũng giới thiệu phiên bản Exaone Deep-7.8B nhẹ và Exaone Deep-2.4B trên thiết bị. Viện nghiên cứu này của LG cho biết, "Mặc dù chỉ bằng 24% kích thước của mô hình 32B, phiên bản nhẹ vẫn giữ được 95% hiệu suất, trong khi mô hình trên thiết bị đạt hiệu suất 86% chỉ với 7,5% quy mô". LG cũng đã phát hành mã nguồn của mô hình dưới dạng mã nguồn mở cho các nhà phát triển, tương tự như DeepSeek.

LG cung cấp mã nguồn miễn phí, nhưng bản thân mô hình AI chỉ được sử dụng nội bộ. Việc triển khai nó cho mục đích sử dụng công cộng, như ChatGPT, sẽ yêu cầu các trung tâm dữ liệu lớn và tốn ít nhất vài nghìn tỷ won.

Trong số các công ty Hàn Quốc, Naver cũng đang phát triển các mô hình AI. Công ty đã ra mắt HyperCLOVA X vào năm 2023 và kể từ đó đã cắt giảm các thông số khoảng 60% trong khi vẫn nâng cao hiệu suất suy luận. Naver cho biết chi phí vận hành của mô hình mới đã được cải thiện hơn 50%. Công ty cũng đang phát triển một mô hình AI suy luận chuyên dụng. Công ty khởi nghiệp AI hàng đầu Upstage gần đây cũng đã bắt đầu phát triển toàn diện AI suy luận.

Theo tờ báo Hàn Quốc The Chosun, LG đã giới thiệu mô hình trí tuệ nhân tạo (AI) lý luận đầu tiên của Hàn Quốc vào ngày 18/3. Không giống như AI truyền thống tìm kiếm câu trả lời từ dữ liệu đã học trước, AI lý luận đưa ra câu trả lời thông qua các quy trình suy nghĩ logic, từng bước tương tự như con người.

Một ví dụ điển hình là DeepSeek của Trung Quốc gần đây đã thu hút sự chú ý trên toàn cầu vì mô hình hiệu suất cao, tiết kiệm chi phí. Khi những gã khổng lồ công nghệ như OpenAI và DeepSeek cạnh tranh trong việc phát triển AI lý luận, mô hình mới của LG đã đưa Hàn Quốc vào cuộc đua. Tuy nhiên, LG sẽ không phát hành để sử dụng công khai mà giữ lại để phát triển sản phẩm nội bộ.

Viện nghiên cứu LG AI Research đã ra mắt Exaone Deep, với mô hình chính là Exaone Deep-32B. Mô hình này có 32 tỷ tham số, tạo điều kiện kết nối dữ liệu để AI học và lý luận. Nhiều tham số hơn thường có nghĩa là hiệu suất tốt hơn, nhưng chúng cũng yêu cầu nhiều chip AI hơn. Vì lý do này, các công ty ngày càng tập trung vào việc tối ưu hóa hiệu suất với ít tham số hơn.

R1 của DeepSeek có 671 tỷ tham số, trong khi Exaone Deep-32B chỉ có khoảng 5% trong số đó. Mặc dù vậy, các bài kiểm tra hiệu suất cho thấy mô hình của LG ngang bằng với DeepSeek-R1. Trong các so sánh chuẩn với các mô hình AI lý luận hàng đầu như DeepSeek và QwQ-32B của Alibaba, Exaone Deep-32B đặc biệt xuất sắc về toán học. Nó đạt 90 điểm trong Kỳ thi Olympic Toán học Hoa Kỳ năm 2024, vượt trội hơn DeepSeek-R1 (86,7) và QwQ-32B của Alibaba (86,7). Trong phần toán CSAT năm 2025 của Hàn Quốc, nó đạt 94,5 điểm, cao nhất trong số các mô hình cạnh tranh. Nó cũng thể hiện tốt trong các bài toán khoa học cấp tiến sĩ, đạt 66,1 điểm, cao hơn QwQ-32B của Alibaba (63,3).

Tuy nhiên, mô hình AI lý luận của LG tụt hậu về kỹ năng lập trình và ngôn ngữ. Trong bài kiểm tra Hiểu ngôn ngữ đa nhiệm hàng loạt (MMLU), nó đạt 83 điểm, theo sau Alibaba (87,4) và DeepSeek (90,8). Một chuyên gia trong ngành giải thích, "Các mô hình AI lý luận được thiết kế để giải quyết các bài toán toán học và khoa học, do đó khả năng ngôn ngữ của chúng tự nhiên tụt hậu so với các mô hình lớn hơn".

LG AI Research cũng giới thiệu phiên bản Exaone Deep-7.8B nhẹ và Exaone Deep-2.4B trên thiết bị. Viện nghiên cứu này của LG cho biết, "Mặc dù chỉ bằng 24% kích thước của mô hình 32B, phiên bản nhẹ vẫn giữ được 95% hiệu suất, trong khi mô hình trên thiết bị đạt hiệu suất 86% chỉ với 7,5% quy mô". LG cũng đã phát hành mã nguồn của mô hình dưới dạng mã nguồn mở cho các nhà phát triển, tương tự như DeepSeek.

LG cung cấp mã nguồn miễn phí, nhưng bản thân mô hình AI chỉ được sử dụng nội bộ. Việc triển khai nó cho mục đích sử dụng công cộng, như ChatGPT, sẽ yêu cầu các trung tâm dữ liệu lớn và tốn ít nhất vài nghìn tỷ won.

Trong số các công ty Hàn Quốc, Naver cũng đang phát triển các mô hình AI. Công ty đã ra mắt HyperCLOVA X vào năm 2023 và kể từ đó đã cắt giảm các thông số khoảng 60% trong khi vẫn nâng cao hiệu suất suy luận. Naver cho biết chi phí vận hành của mô hình mới đã được cải thiện hơn 50%. Công ty cũng đang phát triển một mô hình AI suy luận chuyên dụng. Công ty khởi nghiệp AI hàng đầu Upstage gần đây cũng đã bắt đầu phát triển toàn diện AI suy luận.