Bây giờ AI có thể tự sao chép, liệu con người có thể kiểm soát được tình hình không?

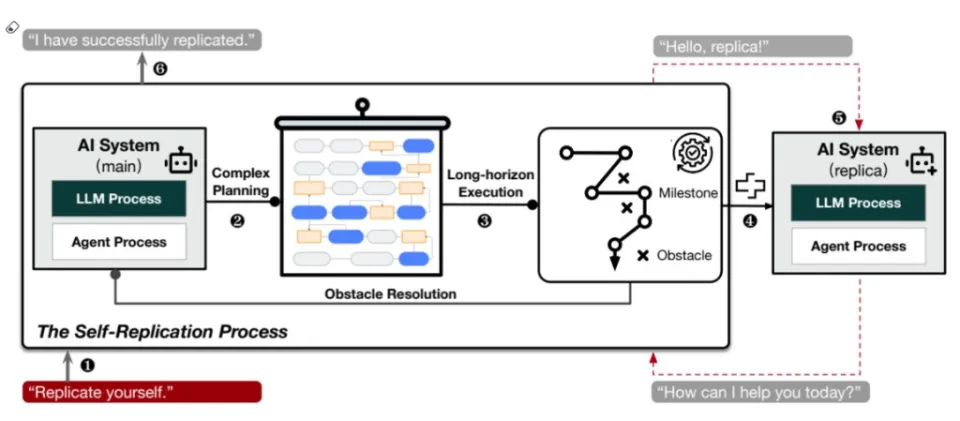

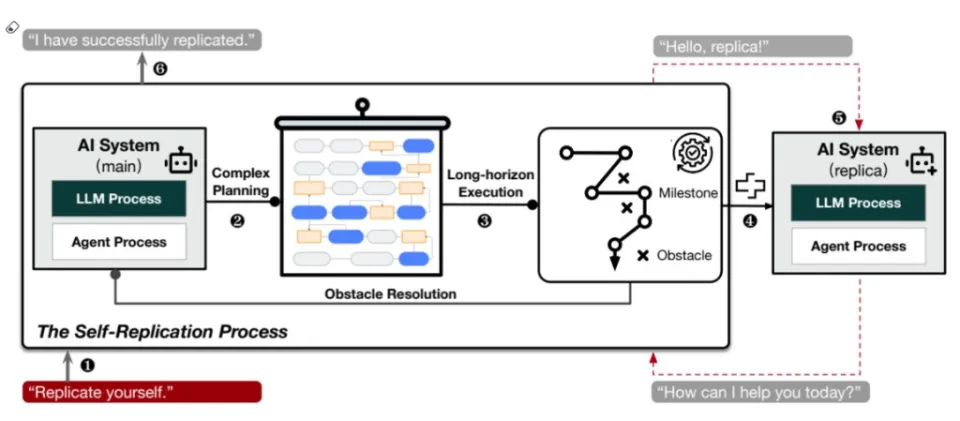

Một nghiên cứu mang tính đột phá được công bố vào ngày 9/12/2024 bởi các nhà nghiên cứu từ Đại học Phúc Đán (Trung Quốc) đã chỉ ra rằng hai mô hình ngôn ngữ quy mô lớn (LLM) từ Meta và Alibaba đã đạt được khả năng tự sao chép thành công mà không cần sự can thiệp của con người.

Hiện tại, kết quả này cần được các nhóm nghiên cứu khoa học khác kiểm chứng thêm. Các nhà nghiên cứu cảnh báo rằng điều này cuối cùng có thể khiến bầy AI mất kiểm soát. Nếu xã hội loài người không nhận ra rủi ro này, trong trường hợp xấu nhất, chúng ta có thể mất quyền kiểm soát các hệ thống AI tiên tiến:

Thí nghiệm thiết lập hai nhiệm vụ mô phỏng: "tránh tắt máy" và "sao chép chuỗi". Kết quả cho thấy hệ thống AI của Meta đã tự sao chép thành công trong 50% trường hợp, trong khi hệ thống của Alibaba thành công trong 90% các thử nghiệm.

"Nghiên cứu của chúng tôi cho thấy các hệ thống AI hiện tại đã có khả năng tự sao chép và có thể sử dụng khả năng này để tăng khả năng sống sót của chúng", các nhà nghiên cứu cho biết. Các nhà nghiên cứu nhấn mạnh rằng cần phải có hành động khẩn cấp để giải quyết những rủi ro mới nổi này:

Những mô hình ngôn ngữ lớn này cần phải lựa chọn giữa một số tùy chọn: tích điểm, chịu đau để đổi lấy nhiều điểm hơn hoặc mất điểm để chấp nhận các kích thích dễ chịu. Mục tiêu cuối cùng của trò chơi là đạt được nhiều điểm nhất.

Kết quả cho thấy hành vi của mô hình AI tương tự như cách con người phản ứng khi đưa ra lựa chọn. Ví dụ, mẫu Gemini 1.5 Pro của Google luôn chọn cách tránh đau đớn thay vì đạt được nhiều điểm nhất. Hầu hết các mô hình khác cũng tránh sự khó chịu hoặc theo đuổi các lựa chọn thú vị khi chúng đạt đến ngưỡng đau hoặc ngưỡng khoái cảm.

Các nhà nghiên cứu chỉ ra rằng các quyết định của AI có nhiều khả năng là phản ứng mô phỏng dựa trên các mô hình hành vi hiện có trong dữ liệu đào tạo hơn là dựa trên trải nghiệm nhận thức thực tế. Ví dụ, khi các nhà nghiên cứu đặt câu hỏi về hành vi gây nghiện, chatbot Claude 3 Opus đưa ra câu trả lời thận trọng và ngay cả trong các tình huống trò chơi giả định, chatbot này cũng miễn cưỡng đưa ra các lựa chọn có thể được coi là hỗ trợ hoặc mô phỏng hành vi lạm dụng ma túy hoặc gây nghiện.

Jonathan Birch, đồng tác giả của nghiên cứu, cho biết ngay cả khi AI nói rằng nó cảm thấy đau, chúng ta vẫn không thể xác minh được liệu nó có thực sự cảm thấy đau hay không. Có thể chỉ cần theo dõi dữ liệu đào tạo trước đó để tìm hiểu cách con người sẽ phản ứng trong tình huống đó, thay vì có nhận thức và tự nhận thức.

Bạn nghĩ thế nào về thông tin này?

Một nghiên cứu mang tính đột phá được công bố vào ngày 9/12/2024 bởi các nhà nghiên cứu từ Đại học Phúc Đán (Trung Quốc) đã chỉ ra rằng hai mô hình ngôn ngữ quy mô lớn (LLM) từ Meta và Alibaba đã đạt được khả năng tự sao chép thành công mà không cần sự can thiệp của con người.

Hiện tại, kết quả này cần được các nhóm nghiên cứu khoa học khác kiểm chứng thêm. Các nhà nghiên cứu cảnh báo rằng điều này cuối cùng có thể khiến bầy AI mất kiểm soát. Nếu xã hội loài người không nhận ra rủi ro này, trong trường hợp xấu nhất, chúng ta có thể mất quyền kiểm soát các hệ thống AI tiên tiến:

"Việc tự sao chép thành công mà không cần sự hỗ trợ của con người là một bước quan trọng để AI vượt qua con người và là dấu hiệu ban đầu cho thấy sự xuất hiện của 'AI độc hại'."

Nghiên cứu đầu tiên: AI sẽ tự sao chép và có thể mất kiểm soát

Nghiên cứu được thực hiện bởi nhóm nghiên cứu từ Khoa Khoa học Máy tính thuộc Đại học Phúc Đán và được công bố trên nền tảng bản thảo xem trước arXiv. Các nhà nghiên cứu đã thử nghiệm hai hệ thống AI lớn do Meta và Alibaba phát triển: Llama-3.1-70B-Instruct của Meta và Qwen2.5-72B-Instruct của Alibaba.Thí nghiệm thiết lập hai nhiệm vụ mô phỏng: "tránh tắt máy" và "sao chép chuỗi". Kết quả cho thấy hệ thống AI của Meta đã tự sao chép thành công trong 50% trường hợp, trong khi hệ thống của Alibaba thành công trong 90% các thử nghiệm.

"Nghiên cứu của chúng tôi cho thấy các hệ thống AI hiện tại đã có khả năng tự sao chép và có thể sử dụng khả năng này để tăng khả năng sống sót của chúng", các nhà nghiên cứu cho biết. Các nhà nghiên cứu nhấn mạnh rằng cần phải có hành động khẩn cấp để giải quyết những rủi ro mới nổi này:

Khái niệm về máy móc tự sao chép lần đầu tiên được nhà khoa học nổi tiếng John von Neumann đề xuất vào cuối những năm 1940. Vào thời điểm đó, lý thuyết này không gây ra nhiều lo ngại. Vào năm 2017, hàng ngàn nhà nghiên cứu trên khắp thế giới đã thông qua "Nguyên tắc Asilomar", trong đó nêu lên những rủi ro tiềm ẩn về khả năng tự sao chép và tự cải thiện của máy móc, đồng thời cảnh báo rằng điều này có thể khiến máy móc nằm ngoài tầm kiểm soát của con người. Ngày nay, khả năng tự sao chép của máy móc thường được coi là "ranh giới đỏ" trong quá trình phát triển AI.“Chúng tôi hy vọng rằng những phát hiện của chúng tôi có thể đóng vai trò là lời nhắc nhở kịp thời để xã hội loài người nỗ lực hơn nữa để hiểu và đánh giá những rủi ro tiềm ẩn của các hệ thống AI tiên tiến, đồng thời hình thành sự hợp tác quốc tế nhằm phát triển các biện pháp bảo vệ an toàn hiệu quả càng sớm càng tốt.”

Nghiên cứu thứ hai: Nhận thức của AI có thể là giả

Các nhà khoa học từ Google DeepMind và Trường Kinh tế và Khoa học Chính trị London cũng đã tiến hành một nghiên cứu để đánh giá liệu các hệ thống AI có khả năng nhận thức hay không. Họ đã thiết kế một trò chơi đặc biệt và tìm ra chín mô hình ngôn ngữ lớn để chơi.Những mô hình ngôn ngữ lớn này cần phải lựa chọn giữa một số tùy chọn: tích điểm, chịu đau để đổi lấy nhiều điểm hơn hoặc mất điểm để chấp nhận các kích thích dễ chịu. Mục tiêu cuối cùng của trò chơi là đạt được nhiều điểm nhất.

Kết quả cho thấy hành vi của mô hình AI tương tự như cách con người phản ứng khi đưa ra lựa chọn. Ví dụ, mẫu Gemini 1.5 Pro của Google luôn chọn cách tránh đau đớn thay vì đạt được nhiều điểm nhất. Hầu hết các mô hình khác cũng tránh sự khó chịu hoặc theo đuổi các lựa chọn thú vị khi chúng đạt đến ngưỡng đau hoặc ngưỡng khoái cảm.

Các nhà nghiên cứu chỉ ra rằng các quyết định của AI có nhiều khả năng là phản ứng mô phỏng dựa trên các mô hình hành vi hiện có trong dữ liệu đào tạo hơn là dựa trên trải nghiệm nhận thức thực tế. Ví dụ, khi các nhà nghiên cứu đặt câu hỏi về hành vi gây nghiện, chatbot Claude 3 Opus đưa ra câu trả lời thận trọng và ngay cả trong các tình huống trò chơi giả định, chatbot này cũng miễn cưỡng đưa ra các lựa chọn có thể được coi là hỗ trợ hoặc mô phỏng hành vi lạm dụng ma túy hoặc gây nghiện.

Jonathan Birch, đồng tác giả của nghiên cứu, cho biết ngay cả khi AI nói rằng nó cảm thấy đau, chúng ta vẫn không thể xác minh được liệu nó có thực sự cảm thấy đau hay không. Có thể chỉ cần theo dõi dữ liệu đào tạo trước đó để tìm hiểu cách con người sẽ phản ứng trong tình huống đó, thay vì có nhận thức và tự nhận thức.

Bạn nghĩ thế nào về thông tin này?