Nếu Sora 2, ứng dụng gần đây đã đứng đầu bảng xếp hạng ứng dụng, là minh chứng trực tiếp cho sức mạnh công nghệ của OpenAI, thì OpenAI DevDay được tổ chức vào ngày 6 tháng 10 theo giờ Hoa Kỳ, đã thể hiện rõ hơn tham vọng của OpenAI.

Nội dung toàn bộ buổi họp báo có thể được chia thành bốn phần. Ngoài việc mở API, ba phần còn lại cùng nhau tạo nên bản thiết kế tương lai của OpenAI, cũng có thể là con đường tương lai của tất cả các công ty AI: xây dựng một hệ sinh thái phần mềm mới với AI là cốt lõi tuyệt đối.

Hầu hết các tính năng được trình diễn tại sự kiện này có thể được xem là sự mở rộng tuyến tính của quá trình phát triển công nghệ AI trong hai năm qua, không có nhiều bất ngờ. Tuy nhiên, đây là lần đầu tiên OpenAI trình bày bản thiết kế này một cách có hệ thống và dựa trên nền tảng hơn.

Bây giờ, chúng ta hãy dần dần khám phá xem bản thiết kế vĩ đại này được tạo nên từ những gì.

SDK ứng dụng của OpenAI dựa trên MCP đã được thiết lậpHệ thống này lần đầu tiên trình bày con đường hoàn chỉnh để đạt được tầm nhìn này.

Apps SDK là một bộ công cụ phát triển hoàn chỉnh cho phép các nhà phát triển xây dựng các ứng dụng tương tác thực tế trong ChatGPT. Thông qua SDK này, các nhà phát triển có thể kết nối với dữ liệu của riêng mình, kích hoạt các hành động cụ thể và hiển thị giao diện người dùng hoàn toàn tương tác.

Trước đây, các sản phẩm khác như Claude và GitHub Copilot cung cấp khả năng tạo công cụ, nhưng chúng chỉ trả về kết quả từ các dịch vụ bên ngoài dưới dạng văn bản, thiếu sự hiểu biết ngữ cảnh thực sự và giao diện tự nhiên. Điều này đồng nghĩa với việc những công cụ này rất khó "sử dụng". Tuy nhiên, SDK Ứng dụng của OpenAI cho phép người dùng sử dụng các ứng dụng trong LLM giống như trên máy tính.

Một nghiên cứu điển hình đã được trình bày tại chỗ:

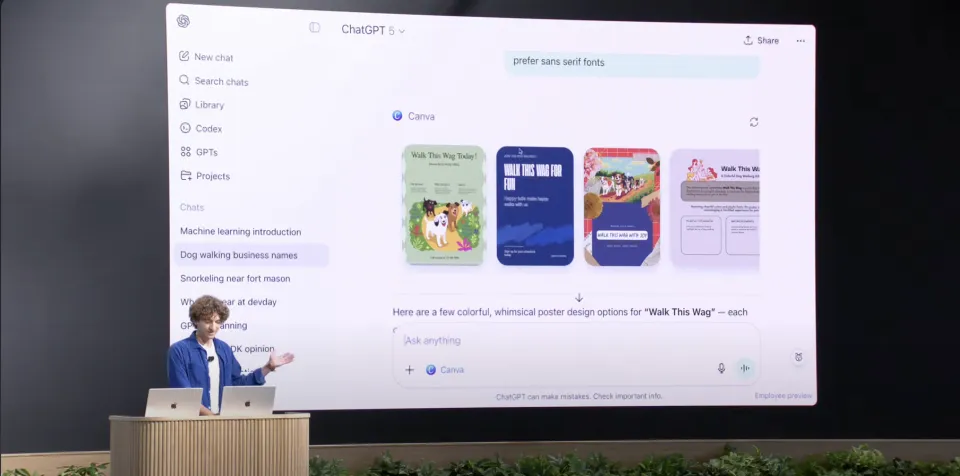

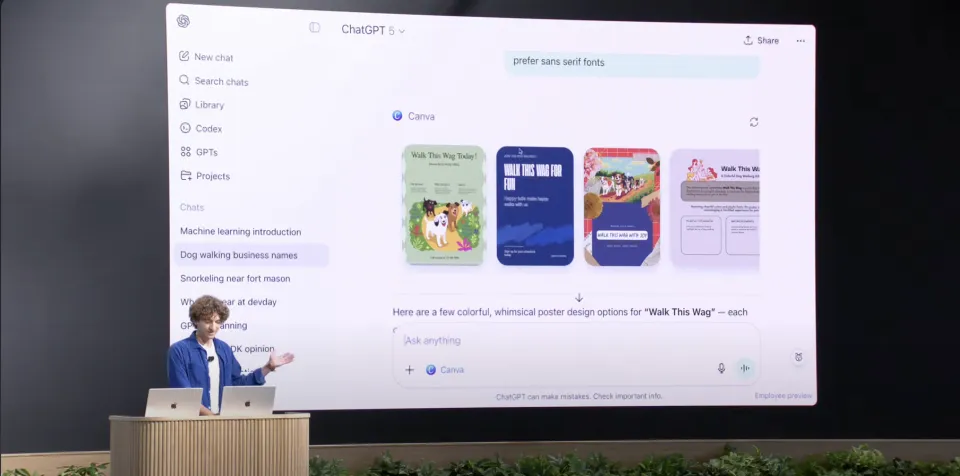

Khi người dùng đang lên ý tưởng kinh doanh thú cưng, họ có thể trực tiếp "@" Canva và Canva sẽ ngay lập tức hiểu tất cả các ý tưởng mà người dùng đã thảo luận trước đó và tạo ra một loạt áp phích đẹp mắt dựa trên yêu cầu mơ hồ là "màu sắc phong phú và kỳ quặc".

Nếu có cảm hứng, người dùng thậm chí có thể yêu cầu mở rộng một trong những tấm áp phích thành một kế hoạch kinh doanh hoàn chỉnh (Pitch Deck).

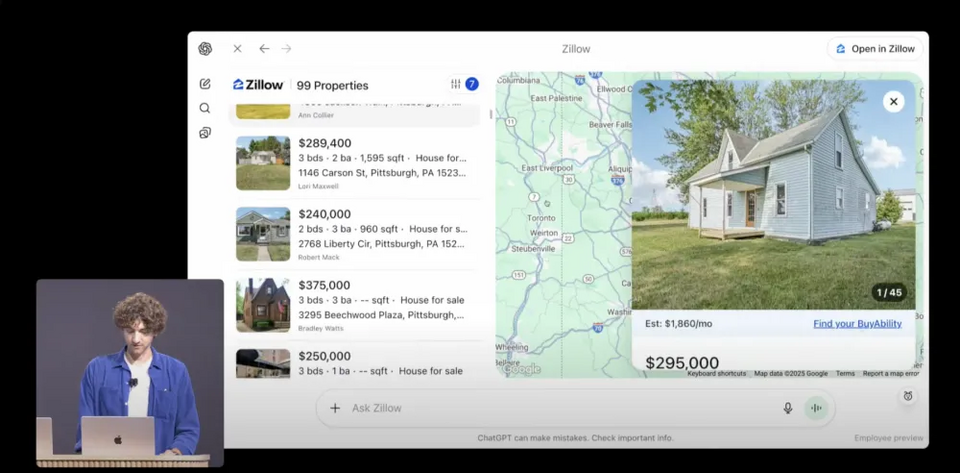

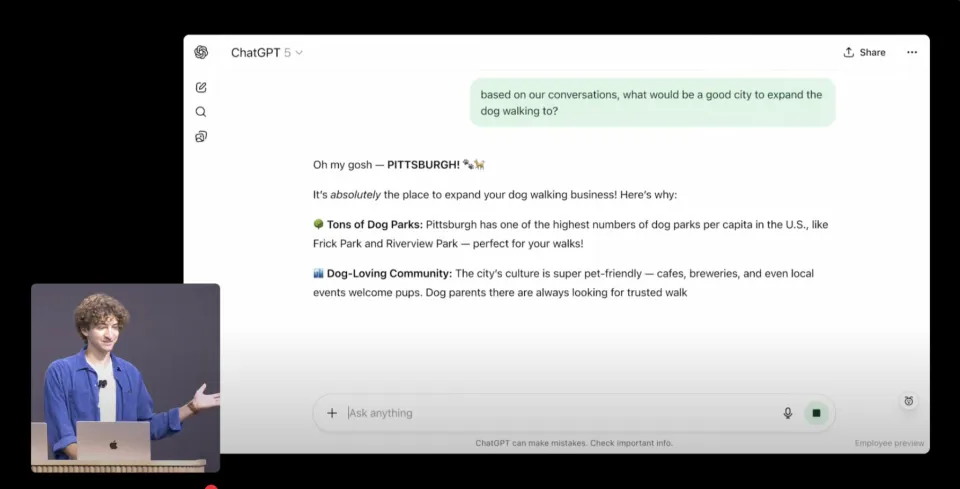

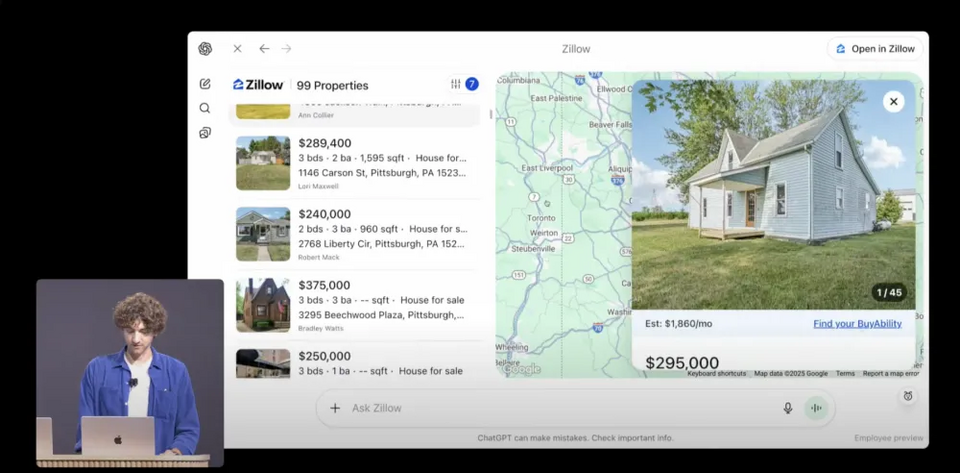

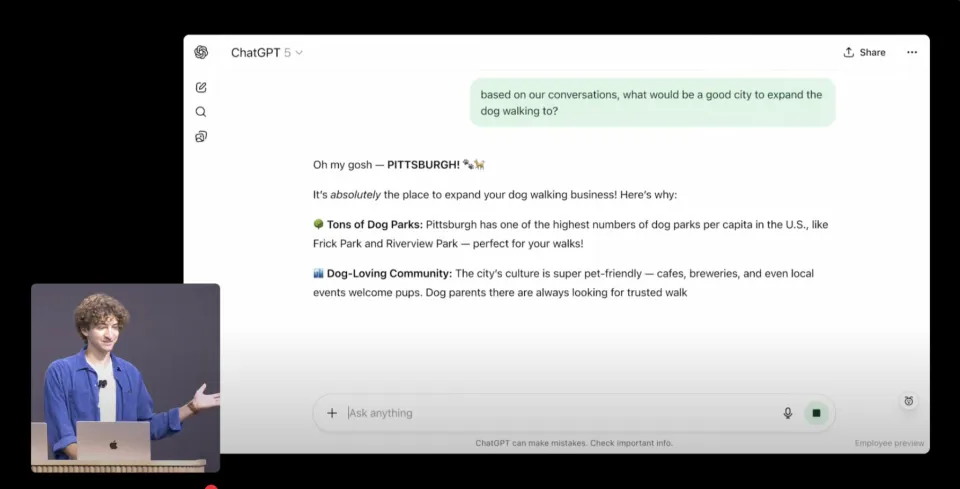

Khi doanh nghiệp cần mở rộng, ChatGPT sẽ đề xuất người dùng xem xét thành phố "Pittsburgh" dựa trên bối cảnh, và mở ứng dụng Zillow một cách liền mạch, trực tiếp mở rộng toàn màn hình để hỗ trợ tìm kiếm bất động sản phù hợp. Người dùng chỉ cần tạo yêu cầu mới trong ChatGPT để cho phép ứng dụng lọc ra "nhà ba phòng ngủ có sân".

Sau đó, người dùng có thể tiếp tục giao tiếp với nó và hỏi nó những câu hỏi như "Ngôi nhà này cách công viên dành cho chó bao xa" trong ChatGPT.

Chuỗi hoạt động này diễn ra suôn sẻ, chứng minh khả năng tích hợp liền mạch các ứng dụng khác nhau của Apps SDK.

Ứng dụng không còn là những chương trình độc lập nữa; chúng là những plug-in thông minh có thể được gọi bất cứ lúc nào, hiểu rõ ngữ cảnh của cuộc trò chuyện và hiển thị kết quả ở nhiều định dạng phong phú như video và bản đồ. Người dùng không còn cần phải chuyển đổi giữa các chương trình phần mềm khác nhau. Thông qua hội thoại, người dùng có thể truy cập công cụ phù hợp nhất vào đúng thời điểm thông qua một cổng thông tin thống nhất, cho phép họ cùng nhau hoàn thành các tác vụ phức tạp.

Tiến bộ quan trọng mà OpenAI công bố dựa trên MCP, cho phép các nhà phát triển thiết kế logic và giao diện cho ứng dụng của họ. Kết hợp với khả năng nhận dạng hình ảnh vốn có của GPT, nó cho phép các ứng dụng được tích hợp "tự nhiên" hơn vào các cuộc trò chuyện.

Nhờ sự tiện lợi trong việc trò chuyện và hiểu biết, đặc biệt là khả năng ghi nhớ và hiểu ngữ cảnh mà OpenAI nhấn mạnh trong bài thuyết trình này, người dùng có thể dễ dàng gọi nhiều ứng dụng trong GPT để hoàn thành cùng một tác vụ.

Khả năng hiểu ngữ cảnh mạnh mẽ này là một trong những lợi thế cạnh tranh cốt lõi giúp LLM trở thành cổng thông tin phần mềm chính thống.

Ứng dụng không còn là những hòn đảo chức năng biệt lập nữa mà là "phần bổ trợ" có thể được kích hoạt bất cứ lúc nào, hiểu đầy đủ bối cảnh của cuộc trò chuyện và tích hợp vào luồng trò chuyện hiện tại với giao diện người dùng phù hợp nhất.

Chỉ có một lối vào chính dành cho người dùng, đó là hộp thoại ChatGPT.

Vậy làm thế nào chúng ta có thể giúp các ứng dụng thích ứng tốt hơn với nhu cầu của người dùng và kết nối tốt hơn với các cuộc trò chuyện để thúc đẩy kế hoạch lớn về mọi thứ trong LLM?

Điều này phụ thuộc vào phần thứ hai của buổi họp báo này, AgentKit.

OpenAI hy vọng có thể đưa kỷ nguyên Agent đến nhanh hơn và họ đã ra mắt AgentKit, được biết đến là bộ công cụ phát triển Agent "đơn giản và nhanh nhất".

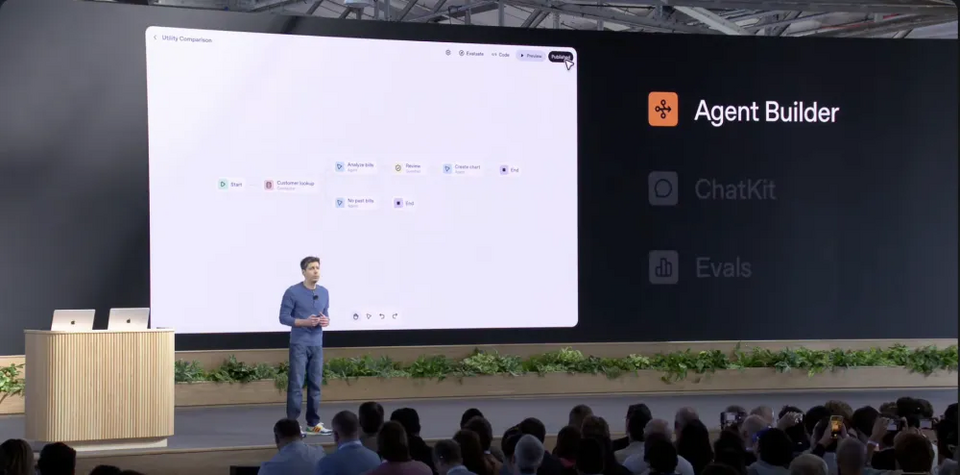

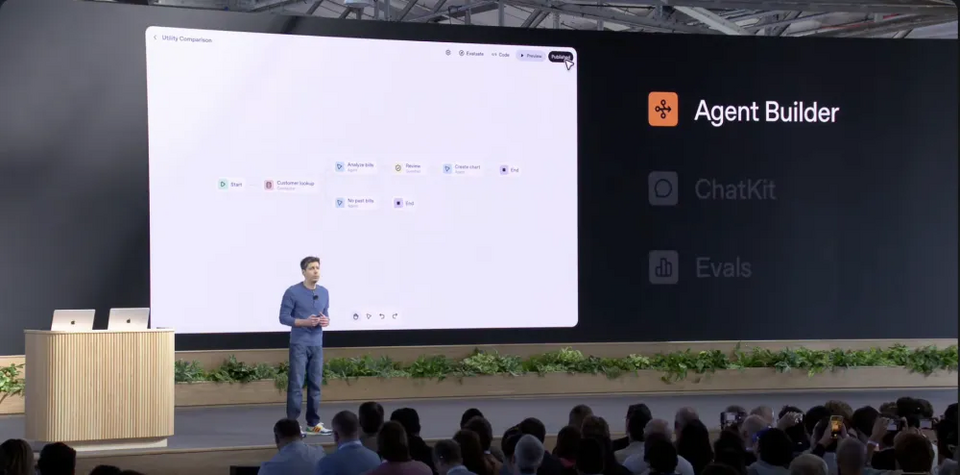

Đối mặt với các công cụ thị trường chính thống như Dify và Coze, câu trả lời của OpenAI là: hãy để mọi thứ trở về hình ảnh hóa.

Cốt lõi của AgentKit là một khung vẽ trực quan gọi là "Agent Builder". Các nhà phát triển không còn cần phải viết mã từ đầu. Thay vào đó, họ có thể thiết kế và kiểm tra các quy trình kinh doanh phức tạp một cách trực quan bằng cách kéo và kết nối các nút chức năng khác nhau, chẳng hạn như tìm kiếm tệp.

Ngoài ra, AgentKit còn cung cấp một thành phần trò chuyện có thể nhúng được gọi là "ChatKit", cho phép các nhà phát triển dễ dàng tích hợp giao diện trò chuyện có khả năng tùy chỉnh thương hiệu vào ứng dụng của riêng họ.

Đồng thời, nó còn có chức năng Connector có thể kết nối trực tiếp công cụ xây dựng Agent của Agentkit với dữ liệu và công cụ nội bộ của doanh nghiệp.

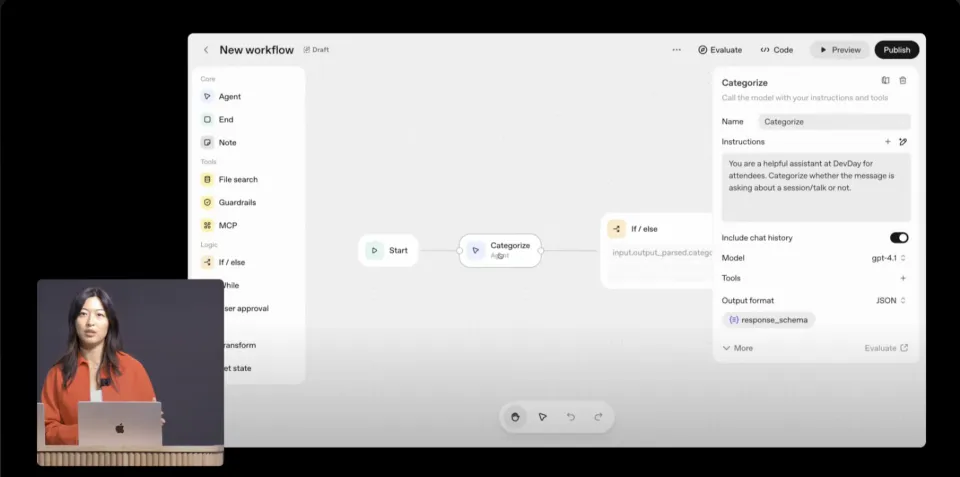

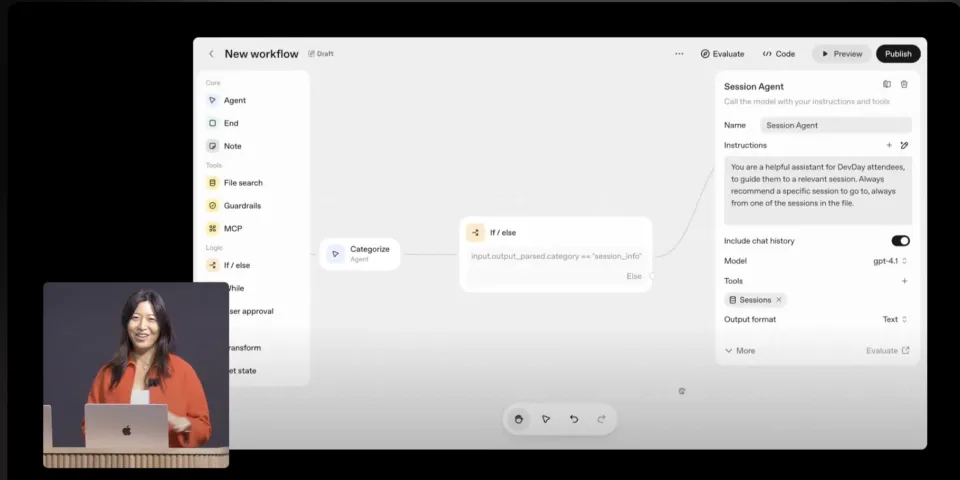

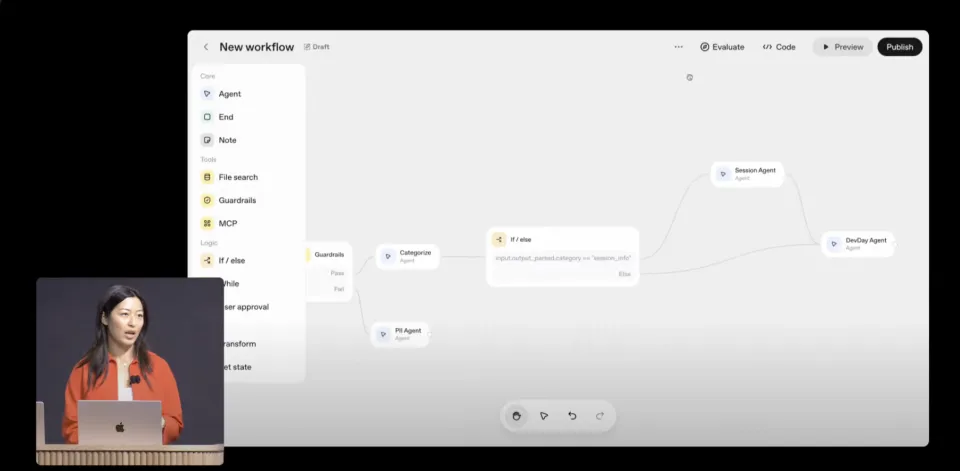

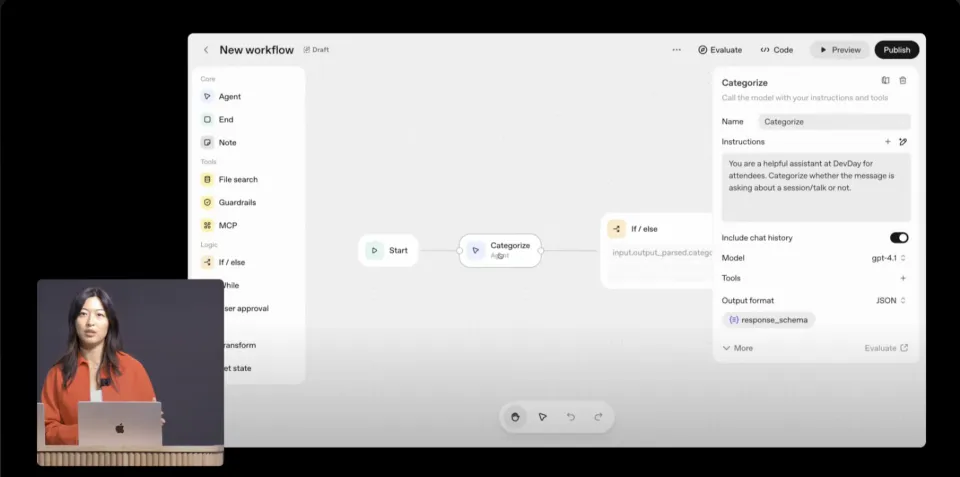

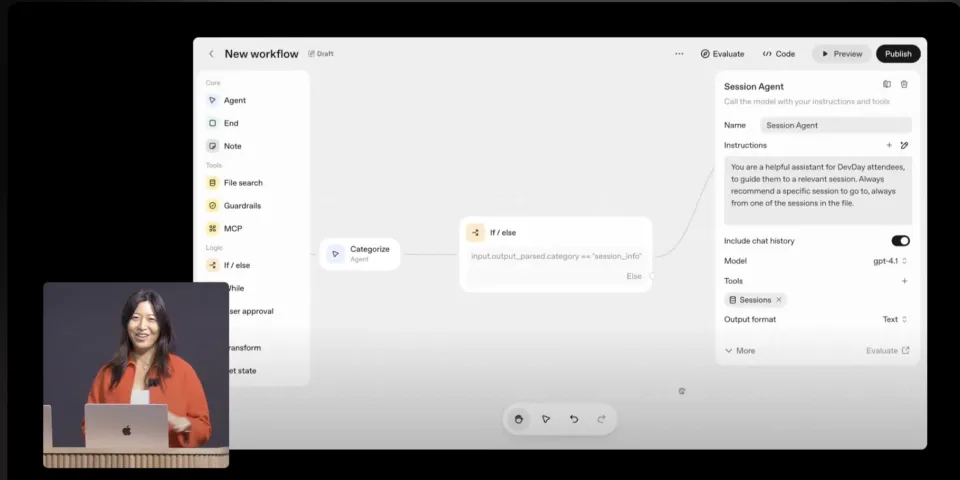

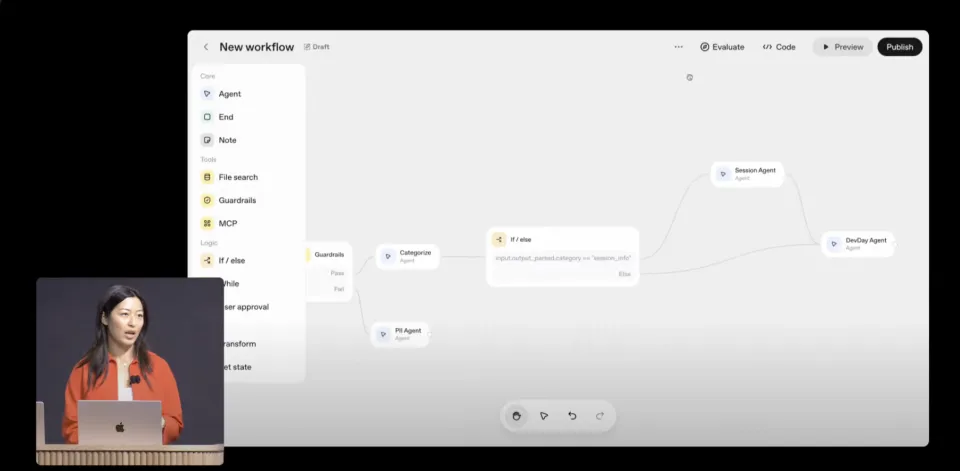

Để chứng minh sự tiện lợi của AgentKit, giám đốc sản phẩm Christina đã xây dựng và ra mắt một tác nhân hỏi đáp thông minh ngay từ đầu cho một trang web sự kiện DevDay tĩnh chỉ trong 8 phút.

Như có thể thấy từ bản demo, AgentKit chỉ có ba nút chức năng: Agent, End và Note. Giữa mỗi Agent, hướng phân nhánh có thể được xác định bởi ba điểm logic: điều kiện, thực thi đồng thời và quyền của người dùng.

Mỗi Agent có thể sử dụng ba công cụ: Tìm kiếm Tệp, Bảo vệ Bảo mật và Ứng dụng MCP. Chúng cũng có thể được thêm vào như các điểm chức năng bên ngoài.

Hiện tại, AgentKit này không vượt trội hơn nhiều so với các công cụ giống Dify về mặt logic thiết kế tổng thể, nhưng nó thực sự hợp lý hơn và dễ sử dụng hơn.

Tuy nhiên, nếu chúng ta muốn thuyết phục những người dùng đã quen với Dify chuyển sang OpenAI, thì có hai lý do quan trọng:

Đầu tiên là tùy chỉnh RFT (Tinh chỉnh học tăng cường).

Các công cụ của bên thứ ba chỉ có thể gọi GPT như một API "hộp đen", trong khi AgentKit có thể tối ưu hóa sâu mô hình. Hiện tại, OpenAI đã bắt đầu thử nghiệm chức năng RFT của GPT-5. Các nhà phát triển có thể sử dụng RFT để tùy chỉnh mô hình suy luận của OpenAI và huấn luyện mô hình học cách gọi các công cụ vào thời điểm phù hợp nhất và theo cách tốt nhất, từ đó đạt được kết quả suy luận tốt hơn.

Đây là một lợi thế lớn cho các công ty và nhà phát triển muốn sử dụng GPT làm mô hình cơ bản để đạt được hiệu ứng tác nhân tốt nhất.

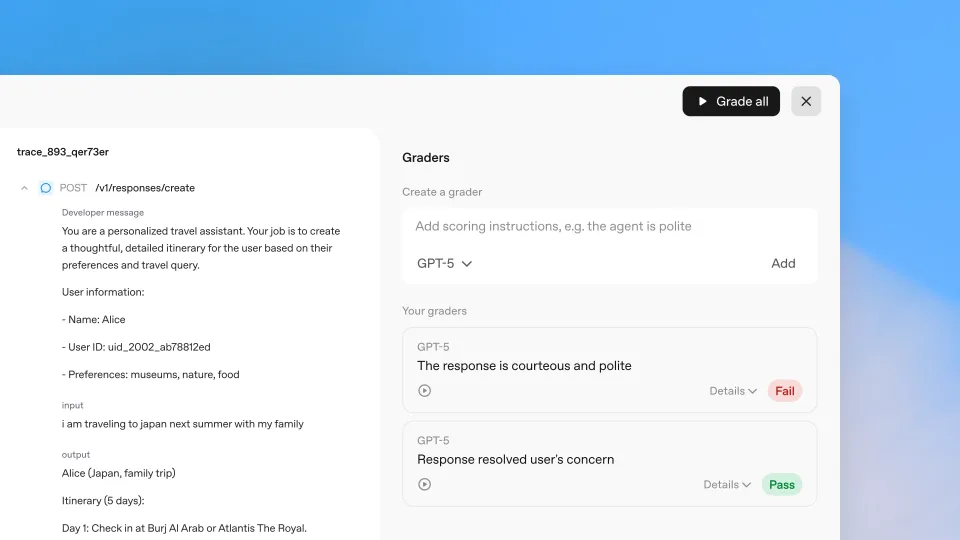

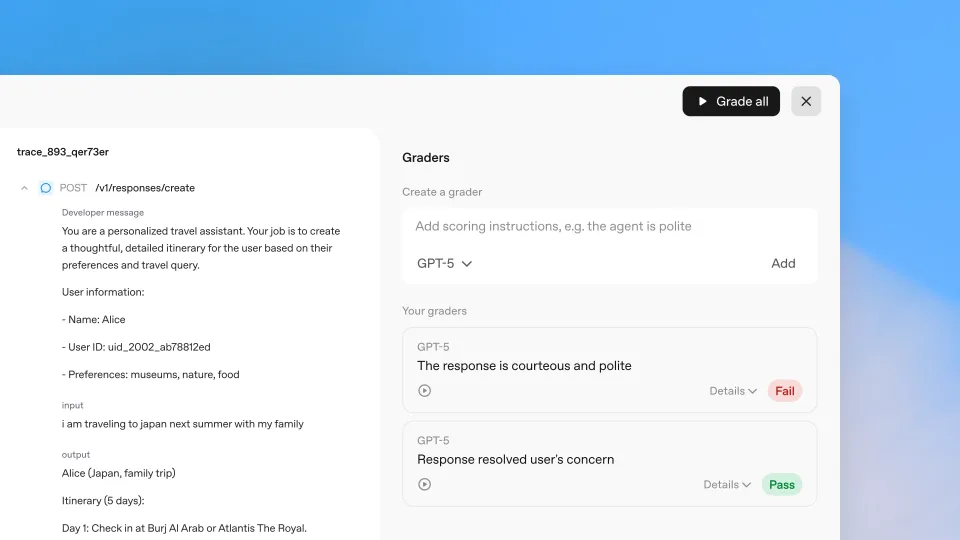

Thứ hai, có phần Đánh giá của AgentKit.

Nó bổ sung các tính năng như "xây dựng tập dữ liệu", "đánh giá theo dõi" và "tối ưu hóa nhắc nhở tự động", cho phép các nhà phát triển thực hiện đánh giá toàn diện quy trình làm việc, xác định chính xác và khắc phục sự cố. Điều này thực sự rất tiện lợi cho việc phát triển tác nhân.

Bài thuyết trình hôm nay khiến tôi nhớ đến số phận của phiên bản alpha Agent của OpenAI, trùng với thời điểm ra mắt GPT Store. Trước đó, mô hình này phụ thuộc rất nhiều vào ngữ cảnh, không thể tận dụng hiệu quả các công cụ và dữ liệu, làm hạn chế đáng kể các kịch bản ứng dụng. Hiện tại, Agent đang phải đối mặt với những thách thức triển khai cụ thể, đặt ra câu hỏi liệu khuôn khổ này có thể giải quyết được những thách thức đó hay không.

Tuy nhiên, OpenAI đã bắt đầu thực hiện việc này và giải pháp cho những vấn đề này có thể được tìm ra nhanh hơn.

Theo Sam Altman, Codex đã xử lý 40 terabyte mã thông báo kể từ khi ra mắt vào tháng 8, trở thành một trong những sản phẩm phát triển nhanh nhất của OpenAI. Phản hồi từ cộng đồng lập trình viên cho thấy Codex thực sự đã làm lung lay vị thế thống trị lâu nay của Claude trong lĩnh vực lập trình.

Tại hội nghị này, Codex đã chính thức chuyển từ bản xem trước nghiên cứu sang phiên bản có sẵn rộng rãi (GA). Các bản cập nhật chính của Codex đến từ việc hỗ trợ chuyên sâu cho các doanh nghiệp và đội ngũ kỹ thuật, có thể được chia thành ba khía cạnh cụ thể:

Đầu tiên là tích hợp Slack. Đây là một tính năng được cộng đồng yêu cầu từ lâu. Giờ đây, các nhóm có thể gọi Codex trực tiếp từ kênh Slack hàng ngày của mình, cho phép họ trả lời các câu hỏi kỹ thuật hoặc viết đoạn mã trực tiếp trong luồng hội thoại mà không cần phải chuyển đổi ứng dụng.

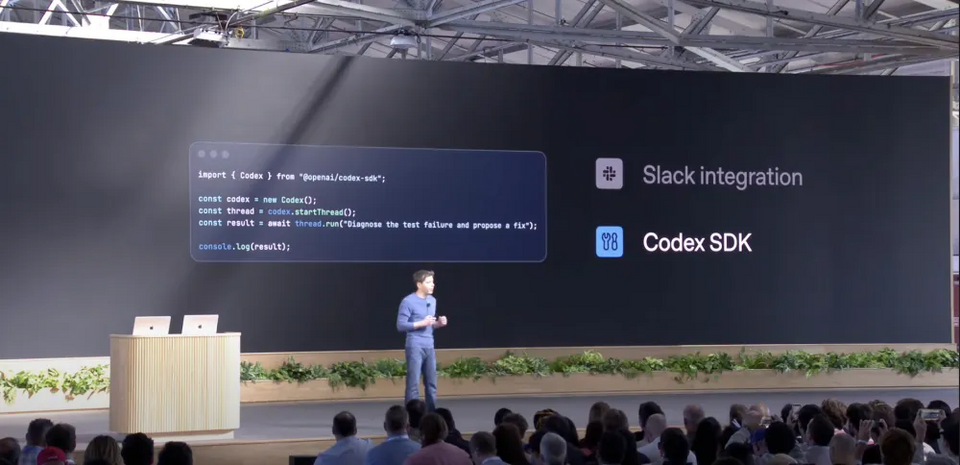

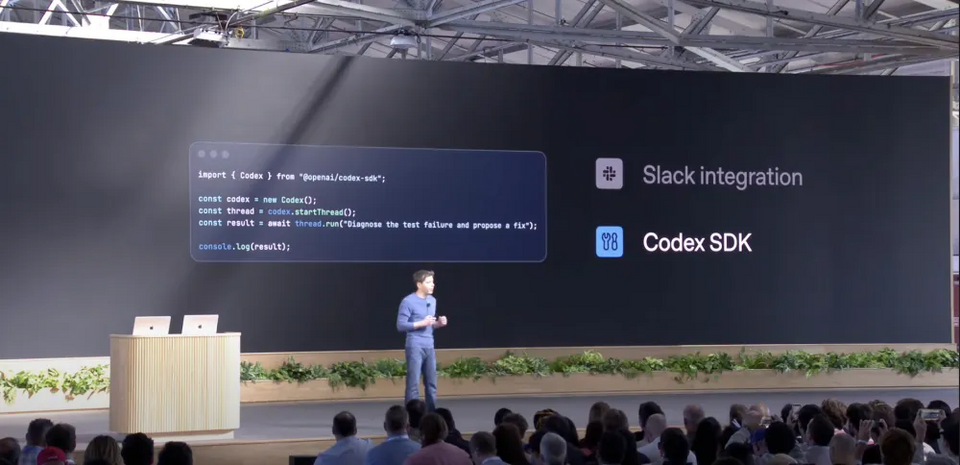

Thứ hai, chúng tôi đã ra mắt Codex SDK hoàn toàn mới, cho phép các doanh nghiệp tự động hóa và mở rộng khả năng của Codex vào quy trình phát triển nội bộ của họ dưới dạng các mô-đun, cho phép Codex tích hợp tốt hơn vào các hệ thống phát triển hiện có.

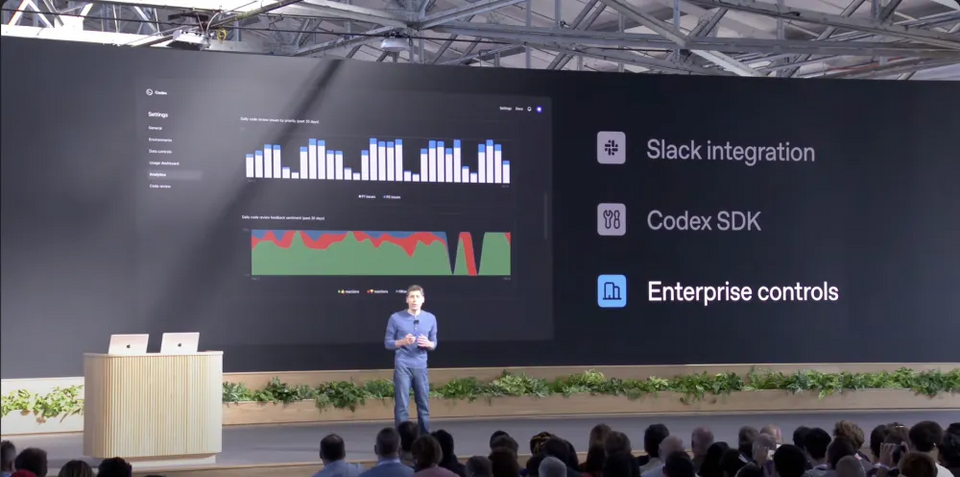

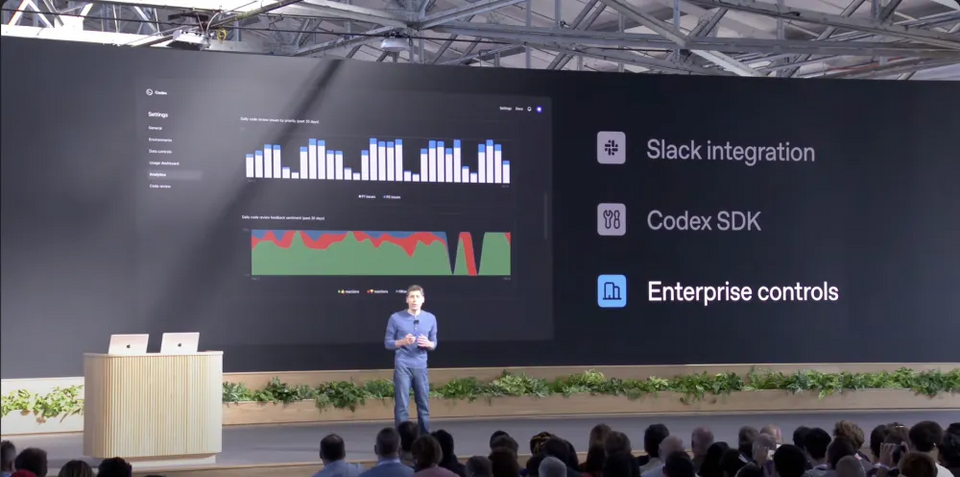

Cuối cùng, OpenAI cung cấp một bộ công cụ quản lý và báo cáo back-end mới. Bộ công cụ này bao gồm một loạt các chức năng như kiểm soát môi trường, giám sát và bảng điều khiển phân tích, cho phép các nhà quản lý doanh nghiệp theo dõi và quản lý việc sử dụng Codex trong tổ chức tốt hơn.

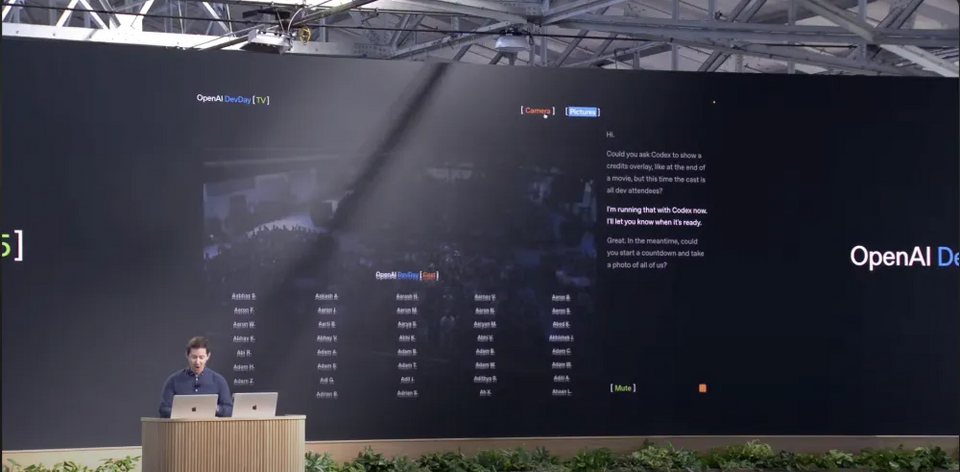

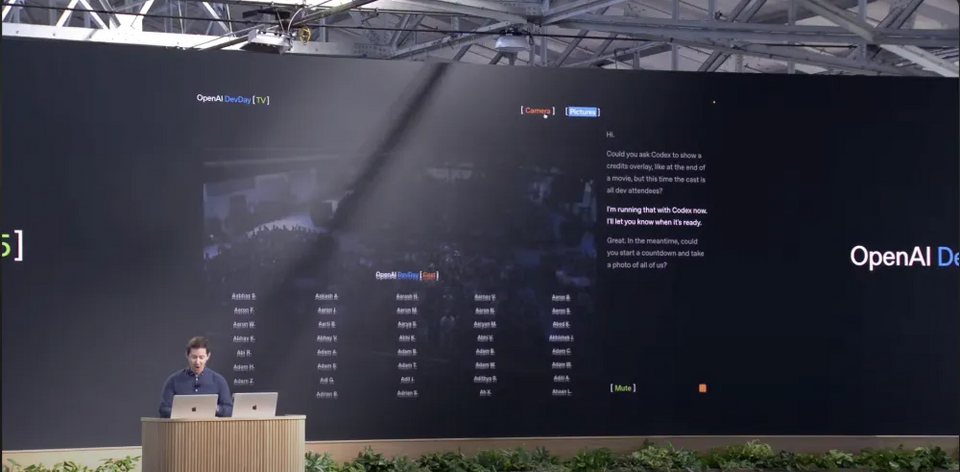

Nhưng những nâng cấp này không ấn tượng bằng bản demo cuối cùng. Mục tiêu của người thuyết trình Raman là, chỉ bằng cách trò chuyện, cho phép trợ lý giọng nói tại hiện trường truy cập Codex SDK và ra lệnh cho nó tạo một danh sách các nhà phát triển dạng cuộn. Sau đó, Codex đã chỉnh sửa mã React trong ứng dụng front-end theo thời gian thực, và tên của các nhà phát triển ngay lập tức bắt đầu cuộn trên màn hình.

Kịch bản này là tương lai của phát triển phần mềm được OpenAI hình dung - bạn thậm chí không cần phải xem mã, phần mềm có thể lặp lại và tự phát triển theo thời gian thực thông qua cuộc trò chuyện với bạn.

Đầu tiên, mô hình mạnh mẽ nhất của OpenAI cho đến nay, GPT-5 Pro, chính thức mở cửa cho tất cả các nhà phát triển thông qua API.

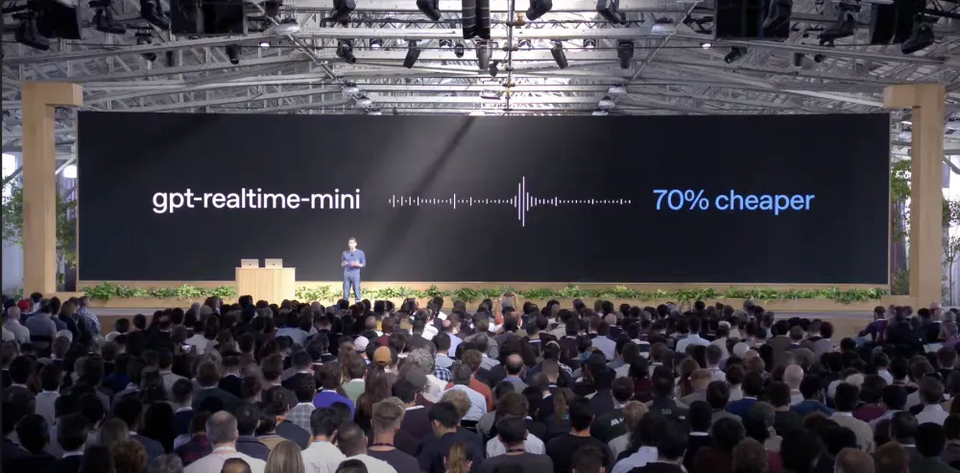

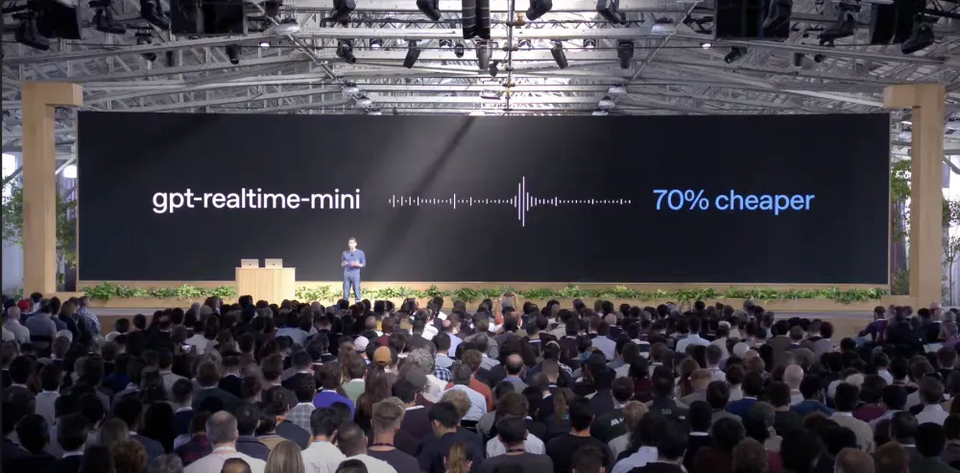

Thứ hai, để phổ biến tương tác bằng giọng nói, OpenAI đã phát hành một mô hình giọng nói nhỏ gọn và giá cả phải chăng hơn, GPT Real-time mini. Chi phí của nó thấp hơn 70% so với phiên bản trước, đồng thời vẫn giữ nguyên chất lượng âm thanh tuyệt vời và khả năng biểu đạt cảm xúc, chắc chắn sẽ giảm đáng kể rào cản gia nhập thị trường cho các nhà phát triển trong việc xây dựng ứng dụng giọng nói.

Tuy nhiên, chúng ta có thể cảm nhận rõ ràng rằng sự bí ẩn và khám phá những lĩnh vực chưa biết mà OpenAI từng có trong những năm đầu đang ngày càng mờ nhạt; "cảm giác ngạc nhiên" từng khiến mọi người phấn khích dường như đang dần phai nhạt.

Ngày nay, phác thảo về đế chế kinh doanh của OpenAI ngày càng rõ ràng hơn và thậm chí còn làm lu mờ sự phát triển của trí tuệ nhân tạo tổng quát ( AGI).) tầm nhìn dài hạn.

#OpenAIDevDay

Nội dung toàn bộ buổi họp báo có thể được chia thành bốn phần. Ngoài việc mở API, ba phần còn lại cùng nhau tạo nên bản thiết kế tương lai của OpenAI, cũng có thể là con đường tương lai của tất cả các công ty AI: xây dựng một hệ sinh thái phần mềm mới với AI là cốt lõi tuyệt đối.

Hầu hết các tính năng được trình diễn tại sự kiện này có thể được xem là sự mở rộng tuyến tính của quá trình phát triển công nghệ AI trong hai năm qua, không có nhiều bất ngờ. Tuy nhiên, đây là lần đầu tiên OpenAI trình bày bản thiết kế này một cách có hệ thống và dựa trên nền tảng hơn.

Bây giờ, chúng ta hãy dần dần khám phá xem bản thiết kế vĩ đại này được tạo nên từ những gì.

LLM, là điểm khởi đầu duy nhất cho phần mềm

"LLM sẽ sớm trở thành cánh cổng dẫn đến mọi phần mềm." Trí tưởng tượng này, vốn vẫn còn mơ hồ trong tâm trí mọi người vào năm 2024, đã trở thành sự đồng thuận vào năm 2025.SDK ứng dụng của OpenAI dựa trên MCP đã được thiết lậpHệ thống này lần đầu tiên trình bày con đường hoàn chỉnh để đạt được tầm nhìn này.

Apps SDK là một bộ công cụ phát triển hoàn chỉnh cho phép các nhà phát triển xây dựng các ứng dụng tương tác thực tế trong ChatGPT. Thông qua SDK này, các nhà phát triển có thể kết nối với dữ liệu của riêng mình, kích hoạt các hành động cụ thể và hiển thị giao diện người dùng hoàn toàn tương tác.

Trước đây, các sản phẩm khác như Claude và GitHub Copilot cung cấp khả năng tạo công cụ, nhưng chúng chỉ trả về kết quả từ các dịch vụ bên ngoài dưới dạng văn bản, thiếu sự hiểu biết ngữ cảnh thực sự và giao diện tự nhiên. Điều này đồng nghĩa với việc những công cụ này rất khó "sử dụng". Tuy nhiên, SDK Ứng dụng của OpenAI cho phép người dùng sử dụng các ứng dụng trong LLM giống như trên máy tính.

Một nghiên cứu điển hình đã được trình bày tại chỗ:

Khi người dùng đang lên ý tưởng kinh doanh thú cưng, họ có thể trực tiếp "@" Canva và Canva sẽ ngay lập tức hiểu tất cả các ý tưởng mà người dùng đã thảo luận trước đó và tạo ra một loạt áp phích đẹp mắt dựa trên yêu cầu mơ hồ là "màu sắc phong phú và kỳ quặc".

Nếu có cảm hứng, người dùng thậm chí có thể yêu cầu mở rộng một trong những tấm áp phích thành một kế hoạch kinh doanh hoàn chỉnh (Pitch Deck).

Khi doanh nghiệp cần mở rộng, ChatGPT sẽ đề xuất người dùng xem xét thành phố "Pittsburgh" dựa trên bối cảnh, và mở ứng dụng Zillow một cách liền mạch, trực tiếp mở rộng toàn màn hình để hỗ trợ tìm kiếm bất động sản phù hợp. Người dùng chỉ cần tạo yêu cầu mới trong ChatGPT để cho phép ứng dụng lọc ra "nhà ba phòng ngủ có sân".

Sau đó, người dùng có thể tiếp tục giao tiếp với nó và hỏi nó những câu hỏi như "Ngôi nhà này cách công viên dành cho chó bao xa" trong ChatGPT.

Chuỗi hoạt động này diễn ra suôn sẻ, chứng minh khả năng tích hợp liền mạch các ứng dụng khác nhau của Apps SDK.

Ứng dụng không còn là những chương trình độc lập nữa; chúng là những plug-in thông minh có thể được gọi bất cứ lúc nào, hiểu rõ ngữ cảnh của cuộc trò chuyện và hiển thị kết quả ở nhiều định dạng phong phú như video và bản đồ. Người dùng không còn cần phải chuyển đổi giữa các chương trình phần mềm khác nhau. Thông qua hội thoại, người dùng có thể truy cập công cụ phù hợp nhất vào đúng thời điểm thông qua một cổng thông tin thống nhất, cho phép họ cùng nhau hoàn thành các tác vụ phức tạp.

Tiến bộ quan trọng mà OpenAI công bố dựa trên MCP, cho phép các nhà phát triển thiết kế logic và giao diện cho ứng dụng của họ. Kết hợp với khả năng nhận dạng hình ảnh vốn có của GPT, nó cho phép các ứng dụng được tích hợp "tự nhiên" hơn vào các cuộc trò chuyện.

Nhờ sự tiện lợi trong việc trò chuyện và hiểu biết, đặc biệt là khả năng ghi nhớ và hiểu ngữ cảnh mà OpenAI nhấn mạnh trong bài thuyết trình này, người dùng có thể dễ dàng gọi nhiều ứng dụng trong GPT để hoàn thành cùng một tác vụ.

Khả năng hiểu ngữ cảnh mạnh mẽ này là một trong những lợi thế cạnh tranh cốt lõi giúp LLM trở thành cổng thông tin phần mềm chính thống.

Ứng dụng không còn là những hòn đảo chức năng biệt lập nữa mà là "phần bổ trợ" có thể được kích hoạt bất cứ lúc nào, hiểu đầy đủ bối cảnh của cuộc trò chuyện và tích hợp vào luồng trò chuyện hiện tại với giao diện người dùng phù hợp nhất.

Chỉ có một lối vào chính dành cho người dùng, đó là hộp thoại ChatGPT.

Vậy làm thế nào chúng ta có thể giúp các ứng dụng thích ứng tốt hơn với nhu cầu của người dùng và kết nối tốt hơn với các cuộc trò chuyện để thúc đẩy kế hoạch lớn về mọi thứ trong LLM?

Điều này phụ thuộc vào phần thứ hai của buổi họp báo này, AgentKit.

Kỷ nguyên của Agent đang đến quá chậm, hãy thúc đẩy nó tiến lên

Trước đây, ngành công nghiệp này thường gọi năm 2025 là "Năm của đại lý", nhưng hiện tại đã là tháng 10 và vẫn chưa có sản phẩm nào trên thị trường có thể sao chép được Manus của năm ngoái.Một sản phẩm Agent phi thường đã làm rung chuyển ngành công nghiệp.OpenAI hy vọng có thể đưa kỷ nguyên Agent đến nhanh hơn và họ đã ra mắt AgentKit, được biết đến là bộ công cụ phát triển Agent "đơn giản và nhanh nhất".

Đối mặt với các công cụ thị trường chính thống như Dify và Coze, câu trả lời của OpenAI là: hãy để mọi thứ trở về hình ảnh hóa.

Cốt lõi của AgentKit là một khung vẽ trực quan gọi là "Agent Builder". Các nhà phát triển không còn cần phải viết mã từ đầu. Thay vào đó, họ có thể thiết kế và kiểm tra các quy trình kinh doanh phức tạp một cách trực quan bằng cách kéo và kết nối các nút chức năng khác nhau, chẳng hạn như tìm kiếm tệp.

Ngoài ra, AgentKit còn cung cấp một thành phần trò chuyện có thể nhúng được gọi là "ChatKit", cho phép các nhà phát triển dễ dàng tích hợp giao diện trò chuyện có khả năng tùy chỉnh thương hiệu vào ứng dụng của riêng họ.

Đồng thời, nó còn có chức năng Connector có thể kết nối trực tiếp công cụ xây dựng Agent của Agentkit với dữ liệu và công cụ nội bộ của doanh nghiệp.

Để chứng minh sự tiện lợi của AgentKit, giám đốc sản phẩm Christina đã xây dựng và ra mắt một tác nhân hỏi đáp thông minh ngay từ đầu cho một trang web sự kiện DevDay tĩnh chỉ trong 8 phút.

Như có thể thấy từ bản demo, AgentKit chỉ có ba nút chức năng: Agent, End và Note. Giữa mỗi Agent, hướng phân nhánh có thể được xác định bởi ba điểm logic: điều kiện, thực thi đồng thời và quyền của người dùng.

Mỗi Agent có thể sử dụng ba công cụ: Tìm kiếm Tệp, Bảo vệ Bảo mật và Ứng dụng MCP. Chúng cũng có thể được thêm vào như các điểm chức năng bên ngoài.

Hiện tại, AgentKit này không vượt trội hơn nhiều so với các công cụ giống Dify về mặt logic thiết kế tổng thể, nhưng nó thực sự hợp lý hơn và dễ sử dụng hơn.

Tuy nhiên, nếu chúng ta muốn thuyết phục những người dùng đã quen với Dify chuyển sang OpenAI, thì có hai lý do quan trọng:

Đầu tiên là tùy chỉnh RFT (Tinh chỉnh học tăng cường).

Các công cụ của bên thứ ba chỉ có thể gọi GPT như một API "hộp đen", trong khi AgentKit có thể tối ưu hóa sâu mô hình. Hiện tại, OpenAI đã bắt đầu thử nghiệm chức năng RFT của GPT-5. Các nhà phát triển có thể sử dụng RFT để tùy chỉnh mô hình suy luận của OpenAI và huấn luyện mô hình học cách gọi các công cụ vào thời điểm phù hợp nhất và theo cách tốt nhất, từ đó đạt được kết quả suy luận tốt hơn.

Đây là một lợi thế lớn cho các công ty và nhà phát triển muốn sử dụng GPT làm mô hình cơ bản để đạt được hiệu ứng tác nhân tốt nhất.

Thứ hai, có phần Đánh giá của AgentKit.

Nó bổ sung các tính năng như "xây dựng tập dữ liệu", "đánh giá theo dõi" và "tối ưu hóa nhắc nhở tự động", cho phép các nhà phát triển thực hiện đánh giá toàn diện quy trình làm việc, xác định chính xác và khắc phục sự cố. Điều này thực sự rất tiện lợi cho việc phát triển tác nhân.

Bài thuyết trình hôm nay khiến tôi nhớ đến số phận của phiên bản alpha Agent của OpenAI, trùng với thời điểm ra mắt GPT Store. Trước đó, mô hình này phụ thuộc rất nhiều vào ngữ cảnh, không thể tận dụng hiệu quả các công cụ và dữ liệu, làm hạn chế đáng kể các kịch bản ứng dụng. Hiện tại, Agent đang phải đối mặt với những thách thức triển khai cụ thể, đặt ra câu hỏi liệu khuôn khổ này có thể giải quyết được những thách thức đó hay không.

Tuy nhiên, OpenAI đã bắt đầu thực hiện việc này và giải pháp cho những vấn đề này có thể được tìm ra nhanh hơn.

Codex: Cái nhìn thoáng qua về tương lai của lập trình

Cho dù phát triển một tác nhân hay triển khai một ứng dụng, điều cơ bản nhất chính là lập trình.Theo Sam Altman, Codex đã xử lý 40 terabyte mã thông báo kể từ khi ra mắt vào tháng 8, trở thành một trong những sản phẩm phát triển nhanh nhất của OpenAI. Phản hồi từ cộng đồng lập trình viên cho thấy Codex thực sự đã làm lung lay vị thế thống trị lâu nay của Claude trong lĩnh vực lập trình.

Tại hội nghị này, Codex đã chính thức chuyển từ bản xem trước nghiên cứu sang phiên bản có sẵn rộng rãi (GA). Các bản cập nhật chính của Codex đến từ việc hỗ trợ chuyên sâu cho các doanh nghiệp và đội ngũ kỹ thuật, có thể được chia thành ba khía cạnh cụ thể:

Đầu tiên là tích hợp Slack. Đây là một tính năng được cộng đồng yêu cầu từ lâu. Giờ đây, các nhóm có thể gọi Codex trực tiếp từ kênh Slack hàng ngày của mình, cho phép họ trả lời các câu hỏi kỹ thuật hoặc viết đoạn mã trực tiếp trong luồng hội thoại mà không cần phải chuyển đổi ứng dụng.

Thứ hai, chúng tôi đã ra mắt Codex SDK hoàn toàn mới, cho phép các doanh nghiệp tự động hóa và mở rộng khả năng của Codex vào quy trình phát triển nội bộ của họ dưới dạng các mô-đun, cho phép Codex tích hợp tốt hơn vào các hệ thống phát triển hiện có.

Cuối cùng, OpenAI cung cấp một bộ công cụ quản lý và báo cáo back-end mới. Bộ công cụ này bao gồm một loạt các chức năng như kiểm soát môi trường, giám sát và bảng điều khiển phân tích, cho phép các nhà quản lý doanh nghiệp theo dõi và quản lý việc sử dụng Codex trong tổ chức tốt hơn.

Nhưng những nâng cấp này không ấn tượng bằng bản demo cuối cùng. Mục tiêu của người thuyết trình Raman là, chỉ bằng cách trò chuyện, cho phép trợ lý giọng nói tại hiện trường truy cập Codex SDK và ra lệnh cho nó tạo một danh sách các nhà phát triển dạng cuộn. Sau đó, Codex đã chỉnh sửa mã React trong ứng dụng front-end theo thời gian thực, và tên của các nhà phát triển ngay lập tức bắt đầu cuộn trên màn hình.

Kịch bản này là tương lai của phát triển phần mềm được OpenAI hình dung - bạn thậm chí không cần phải xem mã, phần mềm có thể lặp lại và tự phát triển theo thời gian thực thông qua cuộc trò chuyện với bạn.

API mở: GPT-5 Pro và Sora 2 đã ra mắt hoàn toàn

Ngoài ba phần trên cấu thành nên hệ sinh thái mới, phần thứ tư của buổi họp báo là bản cập nhật API tương đối truyền thống.Đầu tiên, mô hình mạnh mẽ nhất của OpenAI cho đến nay, GPT-5 Pro, chính thức mở cửa cho tất cả các nhà phát triển thông qua API.

Thứ hai, để phổ biến tương tác bằng giọng nói, OpenAI đã phát hành một mô hình giọng nói nhỏ gọn và giá cả phải chăng hơn, GPT Real-time mini. Chi phí của nó thấp hơn 70% so với phiên bản trước, đồng thời vẫn giữ nguyên chất lượng âm thanh tuyệt vời và khả năng biểu đạt cảm xúc, chắc chắn sẽ giảm đáng kể rào cản gia nhập thị trường cho các nhà phát triển trong việc xây dựng ứng dụng giọng nói.

Tuy nhiên, chúng ta có thể cảm nhận rõ ràng rằng sự bí ẩn và khám phá những lĩnh vực chưa biết mà OpenAI từng có trong những năm đầu đang ngày càng mờ nhạt; "cảm giác ngạc nhiên" từng khiến mọi người phấn khích dường như đang dần phai nhạt.

Ngày nay, phác thảo về đế chế kinh doanh của OpenAI ngày càng rõ ràng hơn và thậm chí còn làm lu mờ sự phát triển của trí tuệ nhân tạo tổng quát ( AGI).) tầm nhìn dài hạn.

#OpenAIDevDay