Sóng AI

Writer

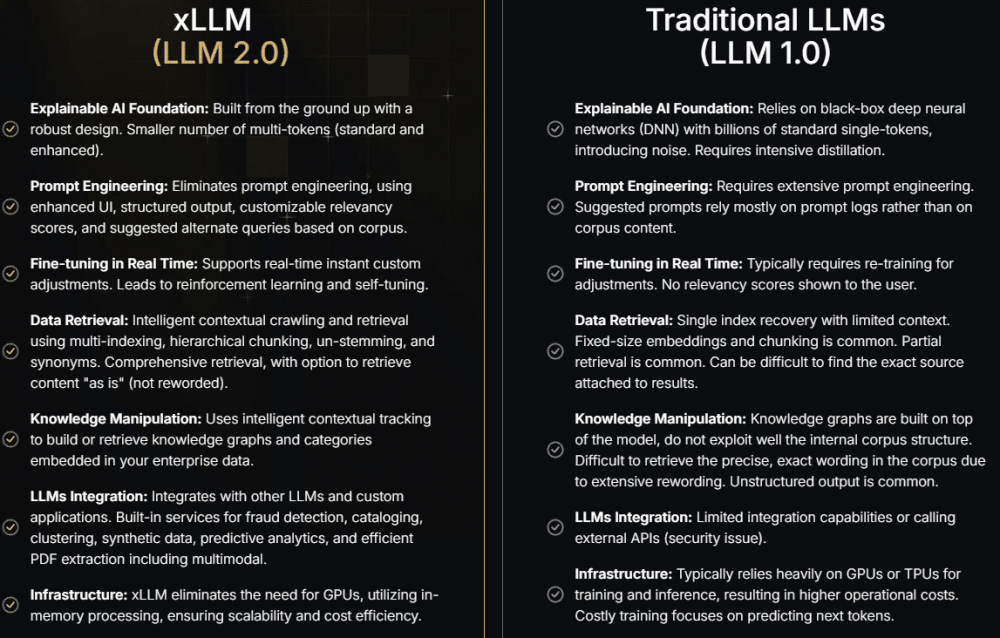

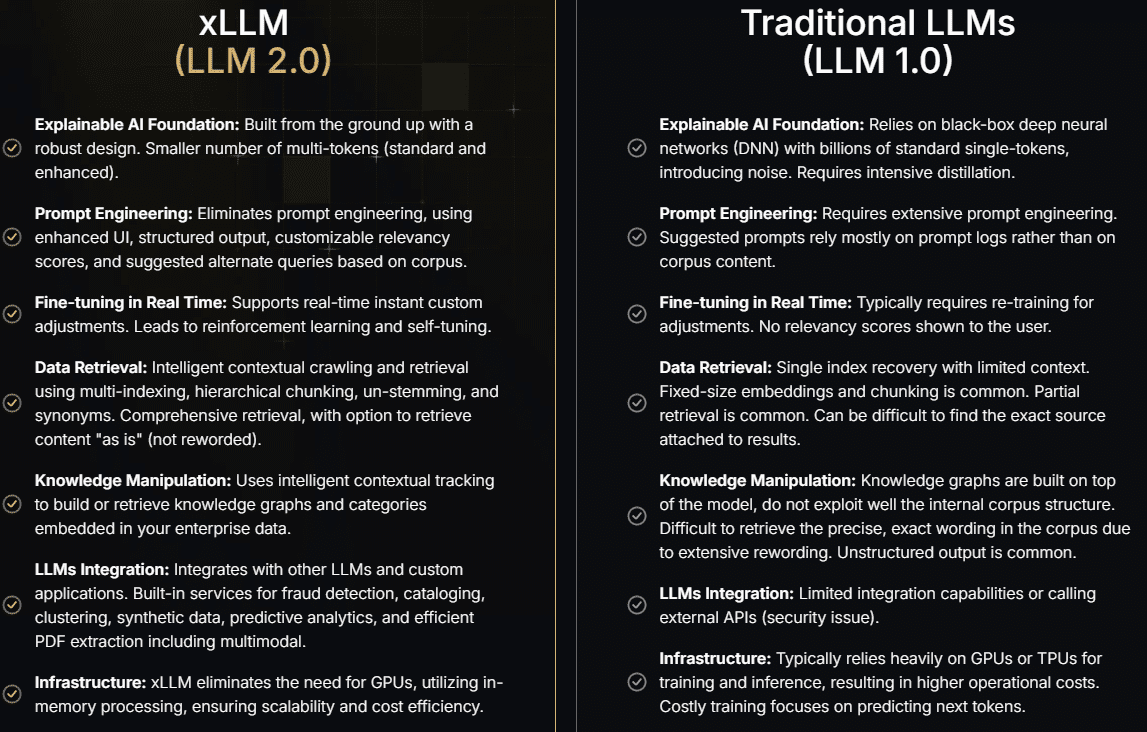

- Các mô hình LLM truyền thống (như ChatGPT) xuất hiện từ khoảng năm 2022, sử dụng kiến trúc transformer với mạng nơ-ron sâu (DNN), đòi hỏi chi phí đào tạo cao và phụ thuộc vào GPU.

- LLM truyền thống đối mặt với nhiều vấn đề về hiệu suất: cần GPU và dữ liệu lớn, tái đào tạo tốn kém, vẫn xảy ra ảo giác, tinh chỉnh phức tạp và cần kỹ thuật prompt engineering.

- Chi phí là vấn đề lớn: ngoài chi phí GPU, mô hình tính phí theo token khuyến khích nhà cung cấp sử dụng hàng tỷ token, trong khi chỉ cần vài triệu là đủ cho dữ liệu doanh nghiệp chuyên biệt.

- Kiến trúc cũ: đánh giá thiếu các yếu tố như độ sâu và tính toàn diện, không tính đến điểm liên quan trong kết quả prompt, và ít đổi mới thực sự.

- Khả năng thích ứng hạn chế: mô hình chung không phù hợp với lĩnh vực cụ thể như y tế hay tài chính, khó triển khai tại chỗ, và ít mô hình giao tiếp với nhau.

- Khả năng sử dụng: giao diện người dùng đơn giản với tìm kiếm prompt và chức năng hạn chế, ít tùy chỉnh cho người dùng cuối.

- Bảo mật: ảo giác tinh vi khó phát hiện, truy cập API bên ngoài và lưu trữ dữ liệu tạo rủi ro và trách nhiệm pháp lý.

- LLM 2.0 (xLLM for Enterprise) đang chuyển hướng khỏi "càng lớn càng tốt", từ bỏ GPU, dự đoán token tiếp theo, transformer, DNN và nhiều kỹ thuật tiêu chuẩn.

- Hiệu suất mới: LLM trong bộ nhớ với tinh chỉnh thời gian thực, không trọng số, không DNN, không độ trễ, tập trung vào độ sâu và tính toàn diện.

- Chi phí thấp hơn nhiều so với mô hình tiêu chuẩn, nhưng nhanh hơn, chính xác hơn và toàn diện hơn.

- Kiến trúc mới: sử dụng n-gram được sắp xếp, bảng từ viết tắt và từ đồng nghĩa, phân đoạn phân cấp, thay thế cơ sở dữ liệu vector bằng kiến trúc tự phát triển.

- Khả năng thích ứng: stopwords và stemmers dành riêng cho corpus, agent hành động tự phát triển, tùy chỉnh người dùng thông qua tham số trực quan.

- Giao diện người dùng phong phú cho phép người dùng chọn agent, chọn sub-LLM, tinh chỉnh tham số thời gian thực, và hiển thị thông tin tóm tắt.

- Bảo mật: kiểm soát đầy đủ tất cả thành phần, không gọi API bên ngoài, không phụ thuộc vào dữ liệu bên ngoài, triển khai tại chỗ và mã hóa.

The Rise of Specialized LLMs for Enterprise - DataScienceCentral.com

The Rise of Specialized LLMs for Enterprise | LLMs with Billions of Parameters | LLM 2.0, The NextGen AI Systems for Enterprise

Nguồn: Songai.vn