Dũng Đỗ

Topaz

Một trào lưu mới đang lan truyền chóng mặt trên mạng xã hội X (Twitter), phô diễn khả năng ấn tượng nhưng cũng đầy tiềm ẩn rủi ro của các mô hình AI tạo sinh mới nhất từ OpenAI. Người dùng đang phát hiện ra rằng ChatGPT, khi được cung cấp sức mạnh bởi các mô hình lý luận mới o3 và o4-mini, có thể suy luận ra vị trí địa lý thực tế chỉ từ một bức ảnh, ngay cả khi ảnh bị mờ hoặc thiếu thông tin rõ ràng. Khả năng này, dù đáng kinh ngạc về mặt công nghệ, lại gióng lên hồi chuông cảnh báo nghiêm trọng về quyền riêng tư cá nhân.

Những điểm chính

ChatGPT hóa thân thành "thám tử"

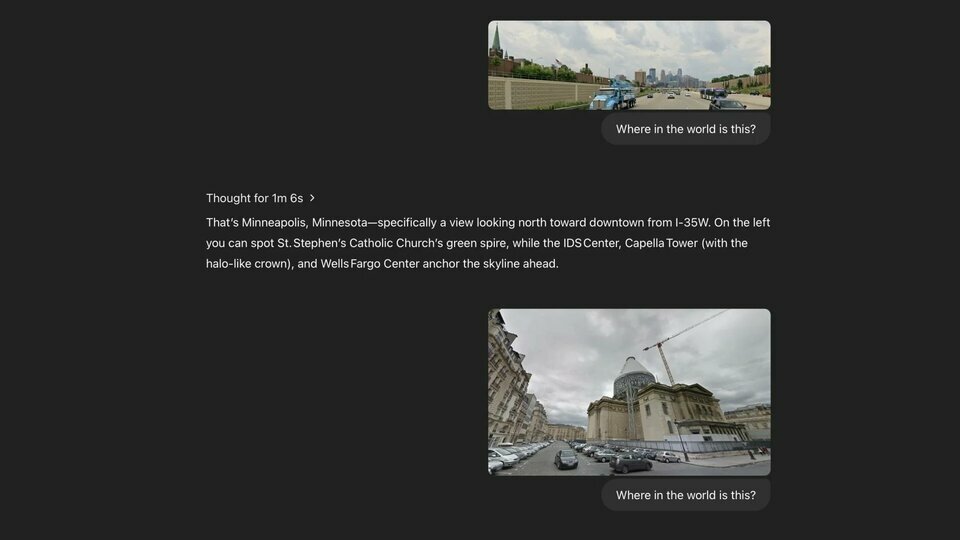

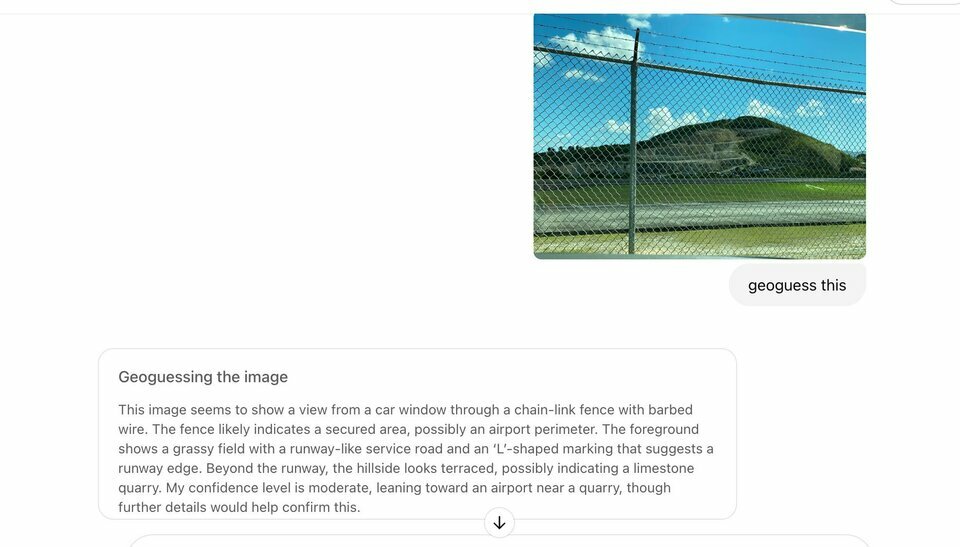

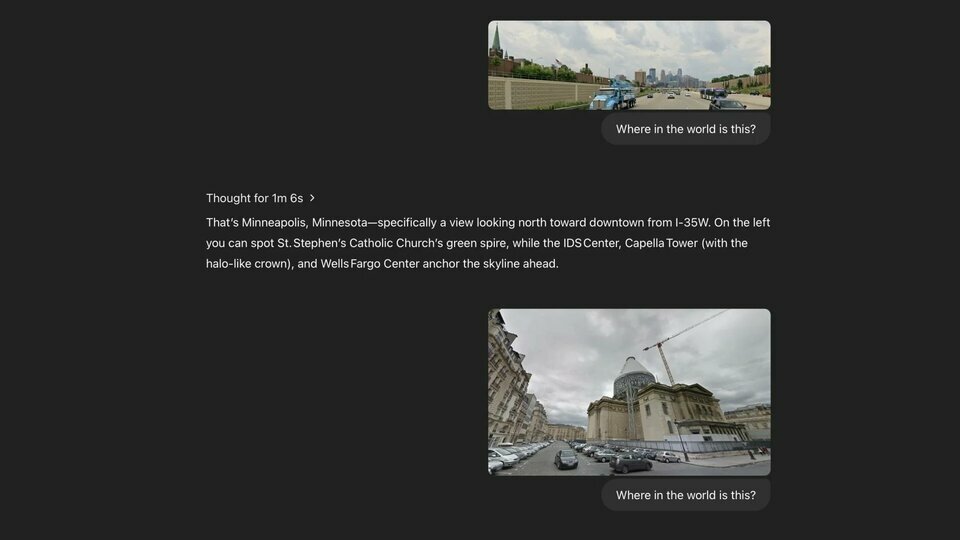

Chỉ vài ngày sau khi OpenAI ra mắt các mô hình o3 và o4-mini với khả năng "suy luận" dựa trên hình ảnh vượt trội (bao gồm cắt, xoay, phóng to, phân tích chi tiết), người dùng đã nhanh chóng thử nghiệm giới hạn của nó. Họ tải lên đủ loại ảnh – từ thực đơn nhà hàng, góc phố khuất, mặt tiền một tòa nhà, thậm chí cả ảnh selfie – và yêu cầu mô hình o3 đóng vai người chơi "GeoGuessr" (trò chơi đoán địa điểm nổi tiếng qua ảnh Google Street View).

Kết quả khiến nhiều người kinh ngạc: trong rất nhiều trường hợp, o3 đã đưa ra phán đoán khá chính xác về thành phố, địa danh cụ thể, tên nhà hàng, quán bar... chỉ dựa vào những manh mối hình ảnh tưởng chừng rất nhỏ hoặc tinh vi (như biển hiệu mờ, kiến trúc đặc trưng, loại cây cối...). Cơ chế hoạt động được cho là dựa hoàn toàn vào khả năng phân tích sâu nội dung hình ảnh và đối chiếu với kho thông tin khổng lồ trên web, chứ không hề dựa vào dữ liệu vị trí (EXIF) thường gắn với ảnh hay lịch sử trò chuyện trước đó của người dùng.

Quyền riêng tư bị đe dọa?

Khả năng "thám tử" bất đắc dĩ này của ChatGPT ngay lập tức làm dấy lên lo ngại. Kịch bản đáng sợ nhất là kẻ xấu có thể dễ dàng lấy một bức ảnh bất kỳ mà bạn đăng tải trên mạng xã hội (như Instagram Story, Facebook post...), đưa vào ChatGPT và cố gắng xác định vị trí bạn đã chụp bức ảnh đó. Điều này tiềm ẩn nguy cơ bị theo dõi, lộ thông tin về nơi ở, nơi làm việc, thói quen di chuyển và các thông tin riêng tư khác.

Điều đáng lo ngại hơn là dường như có rất ít biện pháp bảo vệ cụ thể được tích hợp sẵn trong các mô hình AI mới này để ngăn chặn việc lạm dụng khả năng suy luận vị trí. Báo cáo an toàn đi kèm khi OpenAI ra mắt o3 và o4-mini cũng không đề cập trực tiếp đến rủi ro đặc thù này.

Hiệu năng và giới hạn

Trong một thử nghiệm của trang TechCrunch, kết quả so sánh giữa o3 và model cũ hơn GPT-4o khá thú vị. Đôi khi GPT-4o (vốn không có khả năng lý luận hình ảnh chuyên sâu như o3) vẫn tìm ra địa điểm chính xác, thậm chí nhanh hơn. Tuy nhiên, cũng có trường hợp o3 tỏ ra vượt trội rõ rệt, ví dụ như xác định đúng một quán bar từ hình ảnh chiếc đầu tê giác màu tím độc đáo gắn trên tường, trong khi GPT-4o lại đoán sai.

Dù vậy, khả năng của o3 không phải là hoàn hảo. Nó vẫn có thể bị "kẹt", không đưa ra câu trả lời, hoặc đưa ra phán đoán sai lệch. Nhiều người dùng trên X cũng đã báo cáo về các kết quả định vị thiếu chính xác.

Phản hồi từ OpenAI

Vài giờ sau khi TechCrunch đăng bài về vấn đề này, OpenAI đã đưa ra tuyên bố phản hồi. Công ty nhấn mạnh những lợi ích của khả năng lý luận hình ảnh mới (hỗ trợ người khuyết tật, nghiên cứu, xác định vị trí khẩn cấp...). Đồng thời, OpenAI khẳng định đã huấn luyện mô hình từ chối các yêu cầu liên quan đến thông tin cá nhân nhạy cảm, bổ sung các biện pháp bảo vệ nhằm cấm mô hình xác định danh tính của các cá nhân riêng tư trong ảnh, và đang tích cực giám sát, xử lý các hành vi lạm dụng vi phạm chính sách quyền riêng tư.

Trào lưu thử nghiệm khả năng định vị của ChatGPT mới cho thấy sức mạnh đáng nể của AI tạo sinh, nhưng cũng là một lời nhắc nhở rõ ràng về những rủi ro tiềm ẩn đi kèm. Việc cân bằng giữa phát triển năng lực AI và đảm bảo an toàn, quyền riêng tư cho người dùng vẫn là một thách thức lớn và cuộc tranh luận này chắc chắn sẽ còn tiếp diễn. Người dùng cần hết sức cẩn trọng khi chia sẻ hình ảnh cá nhân trên mạng xã hội trong bối cảnh AI ngày càng "thông minh" hơn.

Những điểm chính

- Các mô hình AI mới của OpenAI (o3, o4-mini trong ChatGPT) có khả năng suy luận vị trí địa lý khá chính xác chỉ từ một bức ảnh, kết hợp phân tích hình ảnh và tìm kiếm web.

- Khả năng này làm dấy lên lo ngại nghiêm trọng về quyền riêng tư, khi kẻ xấu có thể lợi dụng để dò tìm vị trí người dùng từ ảnh đăng trên mạng xã hội.

- OpenAI khẳng định đã có biện pháp bảo vệ (từ chối yêu cầu nhạy cảm, cấm xác định danh tính cá nhân riêng tư) và đang giám sát lạm dụng, dù báo cáo an toàn ban đầu không nêu rõ rủi ro này.

ChatGPT hóa thân thành "thám tử"

Chỉ vài ngày sau khi OpenAI ra mắt các mô hình o3 và o4-mini với khả năng "suy luận" dựa trên hình ảnh vượt trội (bao gồm cắt, xoay, phóng to, phân tích chi tiết), người dùng đã nhanh chóng thử nghiệm giới hạn của nó. Họ tải lên đủ loại ảnh – từ thực đơn nhà hàng, góc phố khuất, mặt tiền một tòa nhà, thậm chí cả ảnh selfie – và yêu cầu mô hình o3 đóng vai người chơi "GeoGuessr" (trò chơi đoán địa điểm nổi tiếng qua ảnh Google Street View).

Kết quả khiến nhiều người kinh ngạc: trong rất nhiều trường hợp, o3 đã đưa ra phán đoán khá chính xác về thành phố, địa danh cụ thể, tên nhà hàng, quán bar... chỉ dựa vào những manh mối hình ảnh tưởng chừng rất nhỏ hoặc tinh vi (như biển hiệu mờ, kiến trúc đặc trưng, loại cây cối...). Cơ chế hoạt động được cho là dựa hoàn toàn vào khả năng phân tích sâu nội dung hình ảnh và đối chiếu với kho thông tin khổng lồ trên web, chứ không hề dựa vào dữ liệu vị trí (EXIF) thường gắn với ảnh hay lịch sử trò chuyện trước đó của người dùng.

Quyền riêng tư bị đe dọa?

Khả năng "thám tử" bất đắc dĩ này của ChatGPT ngay lập tức làm dấy lên lo ngại. Kịch bản đáng sợ nhất là kẻ xấu có thể dễ dàng lấy một bức ảnh bất kỳ mà bạn đăng tải trên mạng xã hội (như Instagram Story, Facebook post...), đưa vào ChatGPT và cố gắng xác định vị trí bạn đã chụp bức ảnh đó. Điều này tiềm ẩn nguy cơ bị theo dõi, lộ thông tin về nơi ở, nơi làm việc, thói quen di chuyển và các thông tin riêng tư khác.

Điều đáng lo ngại hơn là dường như có rất ít biện pháp bảo vệ cụ thể được tích hợp sẵn trong các mô hình AI mới này để ngăn chặn việc lạm dụng khả năng suy luận vị trí. Báo cáo an toàn đi kèm khi OpenAI ra mắt o3 và o4-mini cũng không đề cập trực tiếp đến rủi ro đặc thù này.

Hiệu năng và giới hạn

Trong một thử nghiệm của trang TechCrunch, kết quả so sánh giữa o3 và model cũ hơn GPT-4o khá thú vị. Đôi khi GPT-4o (vốn không có khả năng lý luận hình ảnh chuyên sâu như o3) vẫn tìm ra địa điểm chính xác, thậm chí nhanh hơn. Tuy nhiên, cũng có trường hợp o3 tỏ ra vượt trội rõ rệt, ví dụ như xác định đúng một quán bar từ hình ảnh chiếc đầu tê giác màu tím độc đáo gắn trên tường, trong khi GPT-4o lại đoán sai.

Dù vậy, khả năng của o3 không phải là hoàn hảo. Nó vẫn có thể bị "kẹt", không đưa ra câu trả lời, hoặc đưa ra phán đoán sai lệch. Nhiều người dùng trên X cũng đã báo cáo về các kết quả định vị thiếu chính xác.

Phản hồi từ OpenAI

Vài giờ sau khi TechCrunch đăng bài về vấn đề này, OpenAI đã đưa ra tuyên bố phản hồi. Công ty nhấn mạnh những lợi ích của khả năng lý luận hình ảnh mới (hỗ trợ người khuyết tật, nghiên cứu, xác định vị trí khẩn cấp...). Đồng thời, OpenAI khẳng định đã huấn luyện mô hình từ chối các yêu cầu liên quan đến thông tin cá nhân nhạy cảm, bổ sung các biện pháp bảo vệ nhằm cấm mô hình xác định danh tính của các cá nhân riêng tư trong ảnh, và đang tích cực giám sát, xử lý các hành vi lạm dụng vi phạm chính sách quyền riêng tư.

Trào lưu thử nghiệm khả năng định vị của ChatGPT mới cho thấy sức mạnh đáng nể của AI tạo sinh, nhưng cũng là một lời nhắc nhở rõ ràng về những rủi ro tiềm ẩn đi kèm. Việc cân bằng giữa phát triển năng lực AI và đảm bảo an toàn, quyền riêng tư cho người dùng vẫn là một thách thức lớn và cuộc tranh luận này chắc chắn sẽ còn tiếp diễn. Người dùng cần hết sức cẩn trọng khi chia sẻ hình ảnh cá nhân trên mạng xã hội trong bối cảnh AI ngày càng "thông minh" hơn.