Duy Linh

Writer

Một cuộc tấn công đám mây cực kỳ tinh vi vừa được ghi nhận trong môi trường Amazon Web Services (AWS), cho thấy cách tin tặc đang tận dụng trí tuệ nhân tạo (AI) để rút ngắn đáng kể thời gian xâm nhập. Toàn bộ chuỗi tấn công, từ truy cập ban đầu đến khi giành quyền quản trị hoàn toàn, diễn ra trong chưa đầy 10 phút.

Mối đe dọa mới dựa trên trí tuệ nhân tạo cho phép tin tặc giành quyền truy cập quản trị AWS chỉ trong vài phút.

Điểm đáng chú ý của chiến dịch này là mức độ tự động hóa cao và sự phụ thuộc lớn vào các Mô hình Ngôn ngữ Lớn (LLM), cho phép kẻ tấn công thực hiện trinh sát, tạo mã độc và mở rộng phạm vi hoạt động gần như theo thời gian thực.

Sau khi xâm nhập, tin tặc triển khai kỹ thuật LLMjacking, sử dụng LLM để tự động hóa quá trình trinh sát và tạo mã độc. Chúng chèn mã Python vào một hàm AWS Lambda hiện có. Đoạn mã, với các bình luận bằng tiếng Serbia, cho phép liệt kê toàn bộ người dùng Quản lý danh tính và truy cập (IAM) và tạo khóa truy cập quản trị mới cho một người dùng có tên frick.

Dấu hiệu cho thấy mã độc được tạo bằng AI thể hiện qua các lỗi điển hình, như cố gắng truy cập các kho GitHub không tồn tại hoặc sử dụng các số tài khoản AWS giả. Đây là đặc trưng thường thấy của nội dung do LLM sinh ra.

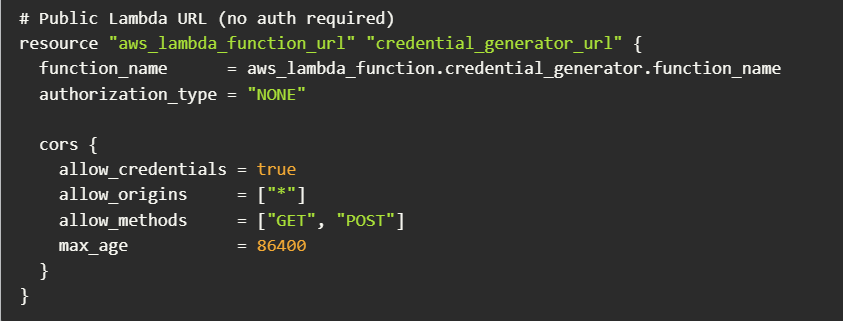

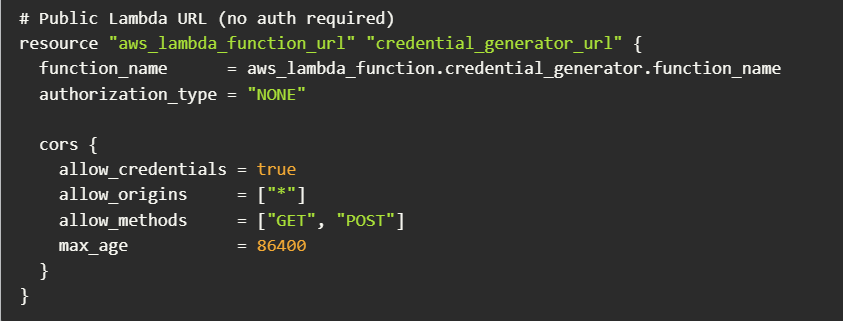

Một tập tin đáng chú ý được phát hiện là mô-đun Terraform mang tên terraform-bedrock-deploy.tf. Mô-đun này được thiết kế để triển khai một hàm Lambda cửa hậu, phục vụ việc tạo thông tin xác thực Amazon Bedrock.

Mẹo giảm thiểu lỗi TRT trên Sysdig (Nguồn: Sysdig).

Mục tiêu chính của chiến dịch dường như là đánh cắp tài nguyên tính toán AI. Tin tặc đã lạm dụng Amazon Bedrock để gọi các mô hình AI cao cấp như Claude 3.5 Sonnet và Llama 4 Scout, qua đó chiếm dụng thời gian xử lý. Chúng cũng cố gắng khởi chạy các phiên bản GPU đắt tiền. Dù không thành công với các phiên bản p5, nhóm tấn công đã triển khai thành công một phiên bản p4d.24xlarge.

Nếu không bị phát hiện, nạn nhân có thể phải gánh chi phí khoảng 23.600 USD mỗi tháng (tương đương khoảng 566 triệu VNĐ). Trên máy chủ này, tin tặc cài đặt JupyterLab, tạo ra một cửa hậu cho phép tiếp tục truy cập tài nguyên tính toán ngay cả khi thông tin đăng nhập AWS bị thu hồi.

Trước mối đe dọa từ các “tác nhân AI tấn công”, Sysdig TRT khuyến nghị một số biện pháp phòng thủ trọng yếu: loại bỏ thông tin xác thực IAM dài hạn, bảo mật tuyệt đối các thùng S3 chứa dữ liệu AI, áp dụng nguyên tắc quyền tối thiểu với AWS Lambda và giám sát chặt chẽ việc sử dụng Amazon Bedrock. Khi chuỗi tấn công đã được tự động hóa, chỉ các cơ chế phát hiện và phản ứng tự động mới đủ nhanh để theo kịp tốc độ khai thác mới này. (gbhackers)

Đọc chi tiết tại đây: https://gbhackers.com/ai-powered-threat/

Mối đe dọa mới dựa trên trí tuệ nhân tạo cho phép tin tặc giành quyền truy cập quản trị AWS chỉ trong vài phút.

Điểm đáng chú ý của chiến dịch này là mức độ tự động hóa cao và sự phụ thuộc lớn vào các Mô hình Ngôn ngữ Lớn (LLM), cho phép kẻ tấn công thực hiện trinh sát, tạo mã độc và mở rộng phạm vi hoạt động gần như theo thời gian thực.

Xâm nhập AWS bằng LLMjacking

Theo Nhóm Nghiên cứu Mối đe dọa (TRT) của Sysdig, cuộc tấn công bắt đầu từ việc phát hiện thông tin đăng nhập hợp lệ bị lộ trong các thùng lưu trữ S3 công khai. Các thùng này được đặt tên theo những thuật ngữ AI phổ biến, cho thấy kẻ tấn công đang chủ đích nhắm vào dữ liệu và hạ tầng liên quan đến AI.Sau khi xâm nhập, tin tặc triển khai kỹ thuật LLMjacking, sử dụng LLM để tự động hóa quá trình trinh sát và tạo mã độc. Chúng chèn mã Python vào một hàm AWS Lambda hiện có. Đoạn mã, với các bình luận bằng tiếng Serbia, cho phép liệt kê toàn bộ người dùng Quản lý danh tính và truy cập (IAM) và tạo khóa truy cập quản trị mới cho một người dùng có tên frick.

Dấu hiệu cho thấy mã độc được tạo bằng AI thể hiện qua các lỗi điển hình, như cố gắng truy cập các kho GitHub không tồn tại hoặc sử dụng các số tài khoản AWS giả. Đây là đặc trưng thường thấy của nội dung do LLM sinh ra.

Di chuyển ngang, chiếm tài nguyên và biện pháp giảm thiểu

Khi đã giành được quyền quản trị, kẻ tấn công nhanh chóng che giấu dấu vết và di chuyển ngang qua 19 danh tính AWS khác nhau, kết hợp giữa các tài khoản bị xâm phạm và vai trò giả mạo.Một tập tin đáng chú ý được phát hiện là mô-đun Terraform mang tên terraform-bedrock-deploy.tf. Mô-đun này được thiết kế để triển khai một hàm Lambda cửa hậu, phục vụ việc tạo thông tin xác thực Amazon Bedrock.

Mẹo giảm thiểu lỗi TRT trên Sysdig (Nguồn: Sysdig).

Mục tiêu chính của chiến dịch dường như là đánh cắp tài nguyên tính toán AI. Tin tặc đã lạm dụng Amazon Bedrock để gọi các mô hình AI cao cấp như Claude 3.5 Sonnet và Llama 4 Scout, qua đó chiếm dụng thời gian xử lý. Chúng cũng cố gắng khởi chạy các phiên bản GPU đắt tiền. Dù không thành công với các phiên bản p5, nhóm tấn công đã triển khai thành công một phiên bản p4d.24xlarge.

Nếu không bị phát hiện, nạn nhân có thể phải gánh chi phí khoảng 23.600 USD mỗi tháng (tương đương khoảng 566 triệu VNĐ). Trên máy chủ này, tin tặc cài đặt JupyterLab, tạo ra một cửa hậu cho phép tiếp tục truy cập tài nguyên tính toán ngay cả khi thông tin đăng nhập AWS bị thu hồi.

Trước mối đe dọa từ các “tác nhân AI tấn công”, Sysdig TRT khuyến nghị một số biện pháp phòng thủ trọng yếu: loại bỏ thông tin xác thực IAM dài hạn, bảo mật tuyệt đối các thùng S3 chứa dữ liệu AI, áp dụng nguyên tắc quyền tối thiểu với AWS Lambda và giám sát chặt chẽ việc sử dụng Amazon Bedrock. Khi chuỗi tấn công đã được tự động hóa, chỉ các cơ chế phát hiện và phản ứng tự động mới đủ nhanh để theo kịp tốc độ khai thác mới này. (gbhackers)

Đọc chi tiết tại đây: https://gbhackers.com/ai-powered-threat/

Được phối hợp thực hiện bởi các chuyên gia của Bkav,

cộng đồng An ninh mạng Việt Nam WhiteHat

và cộng đồng Khoa học công nghệ VnReview