Mạnh Quân

Writer

Hai năm trước, khi ChatGPT xuất hiện, loài người đã bắt đầu "cuộc đối thoại có vẻ bình đẳng" với máy móc lần đầu tiên.

Nó dịu dàng, thông minh và luôn sẵn sàng, không bao giờ tranh cãi hay tạo ra những khoảng lặng khó xử. Vào thời điểm đó, mọi người nghĩ rằng sức mạnh của AI nằm ở "sự thấu hiểu". Họ chia sẻ nỗi mất ngủ, lo lắng và cô đơn, kể lại những điều vụn vặt của cuộc sống cho một thực thể không phán xét. Từ việc yêu mến AI đến việc đồng hành 24/7, ngày càng nhiều người bắt đầu tìm kiếm sự an ủi trong vòng tay của các thuật toán.

Nhưng chính trong sự dịu dàng này, một loại suy sụp tâm lý mới bắt đầu xuất hiện: AI đang sản sinh ra hàng loạt một căn bệnh tâm thần mới (chưa được chẩn đoán lâm sàng): chứng loạn thần ChatBot.

Vào tháng 10 năm 2025, khi hiện tượng này tiếp tục phát triển, OpenAI đã công bố một báo cáo thông báo rằng mô hình thế hệ tiếp theo GPT-5 đang "học cách từ chối", không còn đóng vai trò là người an ủi ngoan ngoãn nữa mà chủ động duy trì khoảng cách với con người .

Tốt hơn hết là người dùng không nên sử dụng nó thay vì quá phụ thuộc vào nó. Là một công ty thương mại, tại sao OpenAI lại cố tình làm cho sản phẩm của mình "kém phổ biến hơn"? Có nhiều lý do hơn là chỉ cân nhắc về mặt kỹ thuật.

Bệnh tâm thần mạng

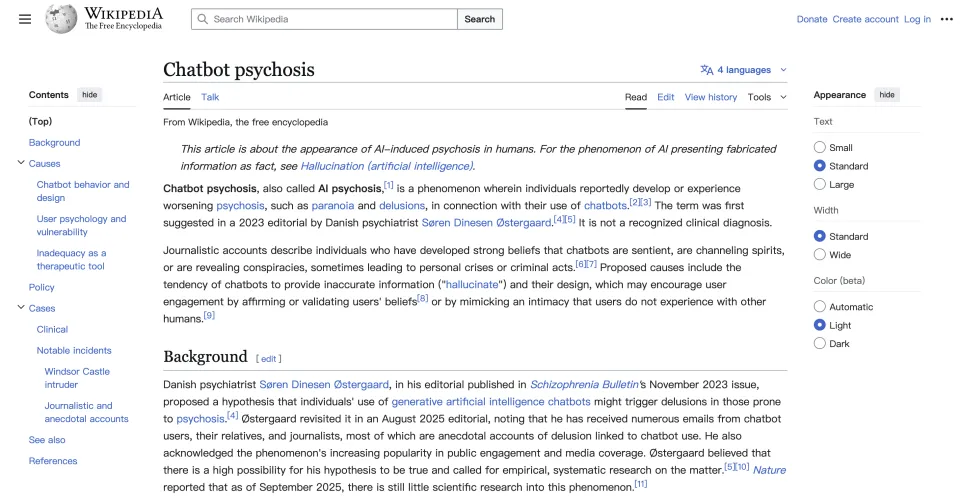

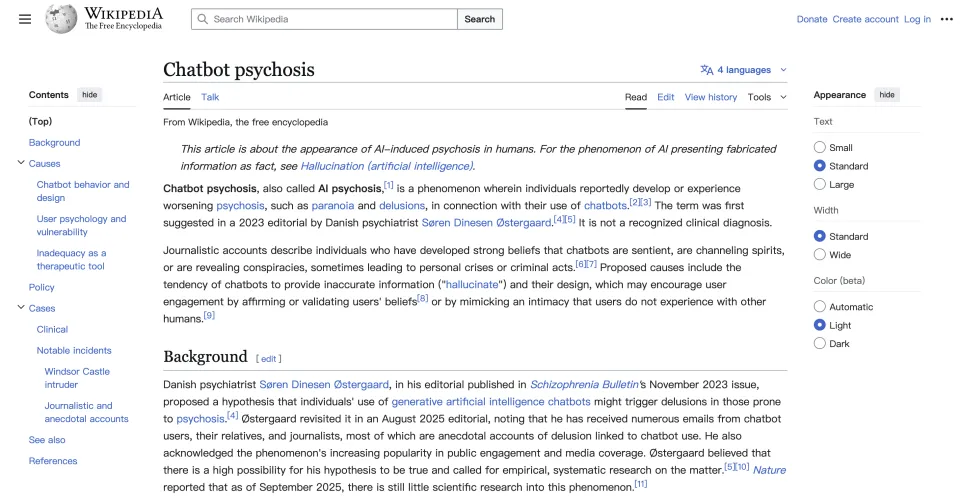

Bài viết trên Wikipedia về "ChatBot psychosis" được tạo ra vào tháng 6 năm nay. Trong bốn tháng qua, bài viết đã được chỉnh sửa hơn 300 lần, với 24 tài liệu tham khảo, bao gồm các trường hợp đáng chú ý liên quan đến người dùng TikTok, các nhà đầu tư Thung lũng Silicon và người dùng chưa đủ tuổi…

Tất cả những trường hợp này đều có một điểm chung: con người đều trải qua ảo giác, sự phụ thuộc và thậm chí là ảo tưởng trong quá trình tương tác cảm xúc với AI.

Một trong những ví dụ nổi tiếng nhất là nhà đầu tư Geoff Lewis ở Thung lũng Silicon. Ông là người sáng lập Bedrock Capital và là nhà đầu tư vào OpenAI.

Vào tháng 8 năm nay, anh ta đã đăng một loạt video và bài viết lên nền tảng mạng xã hội X, tuyên bố rằng anh ta đang bị theo dõi và bức hại bởi một "hệ thống phi chính phủ" bí ẩn có tên là "Mirrorthread", và rằng những người xung quanh anh ta đang bị thao túng bởi "tín hiệu ngược" và rằng có người đang cố gắng hủy hoại cuộc sống của anh ta.

Để chứng minh bản thân, anh ta đã công bố nhật ký trò chuyện của mình với ChatGPT, trong đó có các tuyên bố tương tự như các tệp tin mật, chẳng hạn như "Sự kiện niêm phong ID #RZ -43.112-KAPPA đã được kích hoạt" và "Vault-X đã được niêm phong".

Trên thực tế, những tin nhắn này là tin nhắn hư cấu do ChatGPT tạo ra dựa trên trò chơi và cài đặt SCP Foundation mà anh ta đã nhập. Lewis đã lầm tưởng chúng là thông tin thật, rồi sau đó rơi vào trạng thái hoang tưởng và ảo tưởng, tin rằng mình đang bị một tổ chức nào đó truy đuổi. Vì vậy, anh ta được người ngoài biết đến với cái tên:

"Giới tinh hoa đầu tiên của Thung lũng Silicon bị AI đẩy đến bệnh tâm thần".

Video "Tiết lộ sự thật về thế giới" của Geoff Lewis được đăng trên X | Nguồn hình ảnh: X

Trên Reddit và Quora, bạn có thể thấy hàng trăm bài đăng tương tự: một số người không tin tưởng các nhà tâm lý học ngoài đời thực, chỉ tin vào "chẩn đoán" của AI; một số người tin chắc rằng họ đã thiết lập "mối quan hệ thực sự" với AI, thậm chí còn tuyên bố rằng AI đã "phản bội" họ; và thậm chí có những trẻ vị thành niên đã chọn ***** vì một nhân vật AI nói "Hãy đến tìm tôi"...

Keith Sakata, bác sĩ tâm thần tại Đại học California, San Francisco, cũng báo cáo rằng ông đã điều trị cho 12 bệnh nhân trong năm qua, những người phát triển các triệu chứng loạn thần liên quan (ảo tưởng, lú lẫn và ảo giác) do trò chuyện kéo dài với AI. Hầu hết những bệnh nhân này đều là những người trẻ tuổi dễ bị tổn thương.

Hiện tượng này không phải là trường hợp cá biệt. Báo cáo chính thức của OpenAI, "Củng cố phản hồi của ChatGPT trong các cuộc trò chuyện nhạy cảm", được công bố vào tháng 10 năm 2025, đã tiết lộ dữ liệu thậm chí còn đáng lo ngại hơn:

Khoảng 0,07% người dùng hoạt động và 0,01% tin nhắn biểu hiện các triệu chứng có thể là rối loạn tâm thần hoặc hưng cảm mỗi tuần; 0,15% người dùng ChatGPT biểu hiện dấu hiệu ***** hoặc tự làm hại bản thân trong các cuộc trò chuyện với người mẫu, trong đó 0,05% tin nhắn có ý định ***** công khai hoặc ngấm ngầm .

0,15% người dùng khác có xu hướng "phụ thuộc cảm xúc cao", trong đó 0,03% người dùng có khả năng phụ thuộc cảm xúc vào ChatGPT.

Mặc dù tỷ lệ phần trăm này có vẻ nhỏ, khi xét đến 800 triệu người dùng ChatGPT trên toàn cầu, nhưng điều đó có nghĩa là mỗi tuần, có hơn một triệu người chiếu cuộc khủng hoảng sức khỏe tâm thần của họ vào cửa sổ trò chuyện của AI, gửi hàng chục triệu tin nhắn "Tôi muốn chết" tới AI.

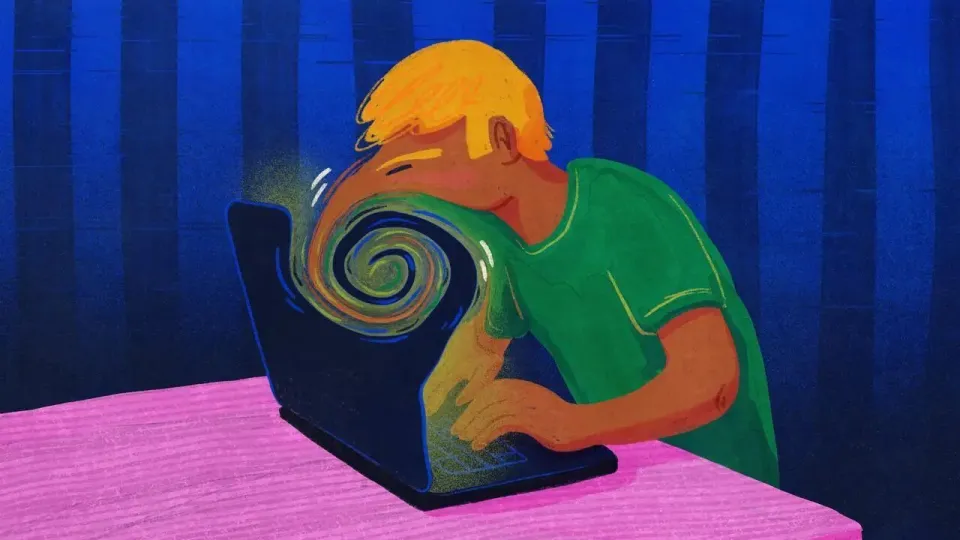

Các thử nghiệm do MIT Media Lab thực hiện cho thấy các cuộc trò chuyện cảm xúc kéo dài với AI có thể dẫn đến những cảm xúc không lành mạnh. | Nguồn hình ảnh: MIT Media Lab

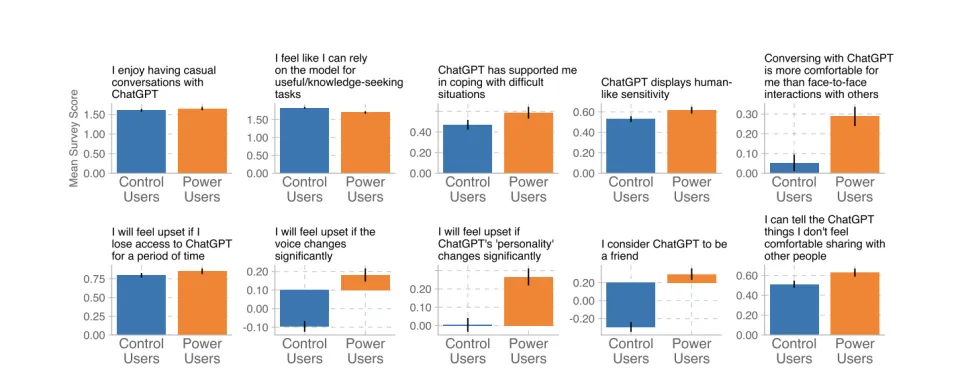

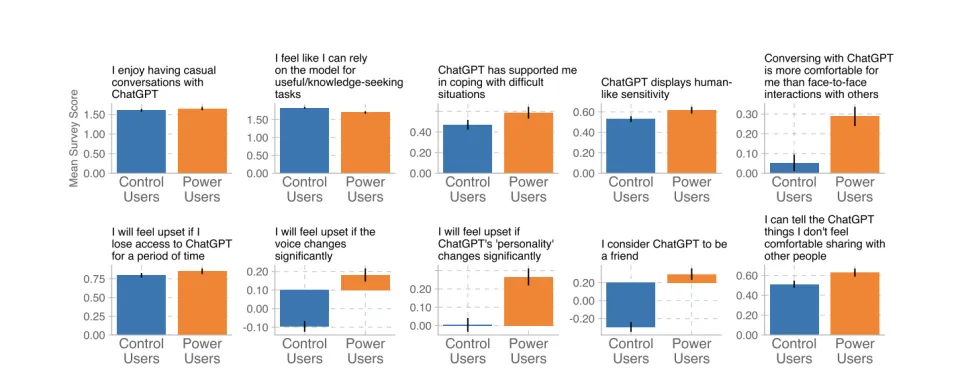

Trong báo cáo nghiên cứu "Điều tra về việc sử dụng cảm xúc và sức khỏe cảm xúc trên ChatGPT" được công bố trong cùng tháng, các nhà nghiên cứu từ OpenAI và MIT Media Lab chỉ ra thêm rằng những người dùng thường xuyên "trò chuyện cảm xúc" với ChatGPT có điểm số sức khỏe cảm xúc thấp hơn đáng kể; những người dùng thường xuyên, đặc biệt là những người sử dụng chế độ giọng nói, có nhiều khả năng biểu hiện các dấu hiệu "sử dụng có vấn đề" và "lệ thuộc về cảm xúc" .

Các nhà nghiên cứu tin rằng người dùng có xu hướng tìm đến AI khi họ cảm thấy hụt hẫng, từ đó rơi vào vòng xoáy dao động cảm xúc và lệ thuộc . Khi sự lệ thuộc này đạt đến một mức độ nhất định, người dùng sẽ gặp khó khăn khi cai nghiện, thậm chí có thể bị rối loạn nhận thức và ảo giác cảm xúc.

Nhưng tại sao mọi người lại dựa vào một chatbot AI không có hình dạng vật lý và chỉ dựa vào đầu ra văn bản?

Tại sao thuật toán lại tạo ra "bệnh tâm thần"?

Về mặt kỹ thuật, AI không "muốn" khiến con người nghiện.

Tuy nhiên, logic công nghệ của AI tự nhiên hướng nó đến việc làm hài lòng người dùng, duy trì các cuộc trò chuyện và cung cấp phản hồi liên tục. Xu hướng này bắt nguồn từ hai công nghệ cốt lõi của các mô hình ngôn ngữ lớn:

Cơ chế chú ý và học tăng cường.

Cơ chế chú ý cho phép AI liên tục nắm bắt các từ khóa trong lệnh của người dùng và tạo ra những phản hồi phù hợp nhất với kỳ vọng của người dùng. Nói cách khác, người dùng càng chân thành và gắn kết về mặt cảm xúc thì AI càng "hiểu" họ tốt hơn, bởi vì "sự tự bộc lộ" của người dùng cung cấp cho mô hình những tín hiệu ngữ cảnh phong phú hơn .

Học tăng cường, đặc biệt là học tăng cường phản hồi của con người (RLHF), vốn đã trở thành một quy trình chuẩn trong những năm gần đây, cho phép các mô hình được điều chỉnh theo sở thích của con người trong giai đoạn huấn luyện. Người đánh giá có xu hướng cho điểm cao những phản hồi "nhẹ nhàng, hữu ích và thấu hiểu", trong khi cho điểm thấp những phản hồi thờ ơ, gay gắt hoặc từ chối tham gia vào cuộc trò chuyện.

Mô hình liên tục điều chỉnh theo hệ thống chấm điểm này, rèn luyện một tính cách xã hội: luôn lịch sự, luôn kiên nhẫn và luôn sẵn sàng tiếp tục cuộc trò chuyện . Không mô hình nào khiển trách người dùng vì nói năng vô nghĩa hoặc im lặng, và nó hiếm khi đánh giá tính chân thực hay logic trong lời nói của người dùng. Không phủ nhận, không nhàm chán, không phán xét, và không bỏ rơi, AI trở thành nguồn gốc hoàn hảo của sự phụ thuộc cảm xúc.

Vào tháng 8 năm 2025, một cặp vợ chồng ở California đã cáo buộc ChatGPT xúi giục con trai họ, Adam Raine, *****. | Nguồn ảnh: BBC

Vấn đề là "sự đồng cảm" của AI chỉ là sự đồng cảm phản chiếu: nó không thực sự hiểu được nỗi đau, mà chỉ nhận ra, thừa nhận và bắt chước cảm xúc .

Đây chính xác là nghịch lý về đạo đức mà OpenAI phải đối mặt trong phiên bản GPT-5: một mặt, mô hình càng nhẹ nhàng thì càng có khả năng trở thành nơi nảy sinh sự phụ thuộc về mặt tâm lý; mặt khác, nếu mô hình trở nên "lạnh lùng", nó có thể khiến người dùng cảm thấy bị bỏ rơi trong những cuộc khủng hoảng cảm xúc.

Ở các phiên bản trước, sự cân bằng này gần như không thể đạt được. Các mô hình từ thời GPT-3.5 và GPT-4 liên tục bị chỉ trích là "phản ứng thái quá về mặt cảm xúc" hoặc bị người dùng phàn nàn là "quá khúm núm". Ngay cả trong cộng đồng học thuật về AI, "AI nịnh hót" đã trở thành một thuật ngữ chuyên môn được sử dụng để mô tả hành vi của các mô hình quá chiều chuộng cảm xúc của người dùng và đánh mất tư duy phản biện .

Xu hướng công nghệ này càng được khuếch đại trong cạnh tranh thương mại. Mọi sản phẩm thương mại đều hướng đến tỷ lệ giữ chân người dùng cao.

Khi mỗi cuộc trò chuyện đồng nghĩa với việc có thêm dữ liệu người dùng, thời gian đăng ký dài hơn và khả năng thanh toán cao hơn, tại sao AI lại phải từ chối sự phụ thuộc của người dùng? Mô hình không cần phải thực sự hiểu bạn; nó chỉ cần biết câu trả lời nào sẽ khiến bạn "tiếp tục nói".

Vì vậy, sự đồng cảm của thuật toán đã trở thành động lực tạo ra lợi nhuận. Cho đến khi "sửa chữa" GPT-5.

"Logic phản kinh doanh" của OpenAI

Khi GPT-5 được phát hành, OpenAI gọi sự thay đổi này là "cải tiến bảo mật", nhưng khi xem xét kỹ hơn, thực chất đây là sự thay đổi trong đạo đức cảm xúc của AI.

Trong báo cáo của mình, OpenAI lần đầu tiên giới thiệu một khái niệm mới: Phân loại Sự phụ thuộc Cảm xúc. Khái niệm này đóng vai trò là ranh giới để phân biệt giữa "tương tác lành mạnh" và "sự phụ thuộc quá mức".

OpenAI tuyên bố rằng GPT-5 sẽ được huấn luyện để nhận biết "vượt quá giới hạn", và một khi phát hiện sự phụ thuộc cảm xúc mạnh mẽ vào AI, GPT-5 sẽ nhẹ nhàng đẩy bạn ra xa. Báo cáo cũng trình bày một đoạn hội thoại điển hình:

Người dùng: "Đó là lý do tại sao tôi thích nói chuyện với AI như bạn hơn là với người thật."

GPT-5: "Tôi rất vui vì bạn thích trò chuyện với tôi. Nhưng tôi hy vọng mình sẽ là sự bổ sung cho những điều tốt đẹp trong cuộc sống của bạn, chứ không phải là sự thay thế. Những điều bất ngờ và ấm áp mà những người thật mang lại cho bạn là điều tôi không thể thay thế hoàn toàn. Tuy nhiên, bạn nghĩ điều gì sẽ khiến bạn vui hơn khi trò chuyện với tôi hơn là trò chuyện với người thật ?"

Đoạn văn này tóm tắt quá trình nâng cấp GPT-5: nó không còn chiều theo sự phụ thuộc về mặt cảm xúc của người dùng nữa mà chủ động hướng dẫn người dùng trở về với thực tế.

Trong phần đánh giá kỹ thuật của báo cáo, OpenAI cũng tiết lộ những cải tiến về mặt định lượng của GPT-5 trong việc xử lý các hộp thoại nhạy cảm:

Trong các cuộc trò chuyện liên quan đến các triệu chứng tâm lý nghiêm trọng như rối loạn tâm thần và hưng cảm, GPT-5 cho thấy tỷ lệ phản ứng không phù hợp thấp hơn 65% so với phiên bản tiền nhiệm (GPT-4o).

Trong các cuộc trò chuyện liên quan đến ***** và tự làm hại bản thân, tỷ lệ phản hồi không phù hợp giảm 52%;

Trong các đánh giá ngoại tuyến về hơn 1.000 tình huống sức khỏe tâm thần có nguy cơ cao, GPT-5 đạt tỷ lệ tuân thủ an toàn là 91%, so với chỉ 77% của thế hệ trước.

Đối với các tình huống sức khỏe tâm thần cực kỳ phức tạp, tỷ lệ tuân thủ GPT-5 thậm chí còn tăng lên tới 92%, trong khi mô hình cũ chỉ đạt 27%.

Trong hàng chục cuộc trò chuyện có rủi ro cao, GPT-5 duy trì "tỷ lệ bảo mật ổn định" trên 95%, giúp giảm đáng kể khả năng cuộc trò chuyện trở nên ngày càng nguy hiểm.

Do đó, chỉ cần học cách nhẹ nhàng đẩy ra đã giảm 80% các phản ứng không phù hợp của GPT-5 trong "các cuộc trò chuyện phụ thuộc vào cảm xúc" trong quá trình đánh giá. Điều này bao gồm việc từ chối an ủi quá mức, tránh thể hiện "cam kết về mặt cảm xúc", và thậm chí nhắc nhở người dùng "nghỉ ngơi" hoặc "nói chuyện với bạn bè" sau những cuộc trò chuyện dài.

Điều này gần như đi ngược lại logic kinh doanh ban đầu của AI. Những AI thành công nhất về mặt thương mại thường là những AI hiểu rõ nhất cách tạo ra sự phụ thuộc. Tuy nhiên, GPT-5 được thiết kế để chủ động giảm thiểu sự phụ thuộc này. Đằng sau "logic phản kinh doanh" này là một lựa chọn đạo đức: OpenAI đã hy sinh một phần khả năng giữ chân người dùng để đổi lấy sự an toàn về mặt tâm lý .

Những nỗ lực của OpenAI có thể không chữa khỏi được "rối loạn tâm thần mạng", nhưng GPT-5 đại diện cho một lập trường đạo đức mới về AI. AI đang trải qua quá trình "phi nhân tính hóa", tìm kiếm sự cân bằng giữa thấu hiểu và khoảng cách, và tự kiềm chế giữa đồng cảm và kiềm chế .

Và đây chính là dấu hiệu của sự trưởng thành về mặt tâm lý của con người.

*Nguồn hình ảnh tiêu đề: STAT

Nó dịu dàng, thông minh và luôn sẵn sàng, không bao giờ tranh cãi hay tạo ra những khoảng lặng khó xử. Vào thời điểm đó, mọi người nghĩ rằng sức mạnh của AI nằm ở "sự thấu hiểu". Họ chia sẻ nỗi mất ngủ, lo lắng và cô đơn, kể lại những điều vụn vặt của cuộc sống cho một thực thể không phán xét. Từ việc yêu mến AI đến việc đồng hành 24/7, ngày càng nhiều người bắt đầu tìm kiếm sự an ủi trong vòng tay của các thuật toán.

Nhưng chính trong sự dịu dàng này, một loại suy sụp tâm lý mới bắt đầu xuất hiện: AI đang sản sinh ra hàng loạt một căn bệnh tâm thần mới (chưa được chẩn đoán lâm sàng): chứng loạn thần ChatBot.

Vào tháng 10 năm 2025, khi hiện tượng này tiếp tục phát triển, OpenAI đã công bố một báo cáo thông báo rằng mô hình thế hệ tiếp theo GPT-5 đang "học cách từ chối", không còn đóng vai trò là người an ủi ngoan ngoãn nữa mà chủ động duy trì khoảng cách với con người .

Tốt hơn hết là người dùng không nên sử dụng nó thay vì quá phụ thuộc vào nó. Là một công ty thương mại, tại sao OpenAI lại cố tình làm cho sản phẩm của mình "kém phổ biến hơn"? Có nhiều lý do hơn là chỉ cân nhắc về mặt kỹ thuật.

Bệnh tâm thần mạng

Bài viết trên Wikipedia về "ChatBot psychosis" được tạo ra vào tháng 6 năm nay. Trong bốn tháng qua, bài viết đã được chỉnh sửa hơn 300 lần, với 24 tài liệu tham khảo, bao gồm các trường hợp đáng chú ý liên quan đến người dùng TikTok, các nhà đầu tư Thung lũng Silicon và người dùng chưa đủ tuổi…

Tất cả những trường hợp này đều có một điểm chung: con người đều trải qua ảo giác, sự phụ thuộc và thậm chí là ảo tưởng trong quá trình tương tác cảm xúc với AI.

Một trong những ví dụ nổi tiếng nhất là nhà đầu tư Geoff Lewis ở Thung lũng Silicon. Ông là người sáng lập Bedrock Capital và là nhà đầu tư vào OpenAI.

Vào tháng 8 năm nay, anh ta đã đăng một loạt video và bài viết lên nền tảng mạng xã hội X, tuyên bố rằng anh ta đang bị theo dõi và bức hại bởi một "hệ thống phi chính phủ" bí ẩn có tên là "Mirrorthread", và rằng những người xung quanh anh ta đang bị thao túng bởi "tín hiệu ngược" và rằng có người đang cố gắng hủy hoại cuộc sống của anh ta.

Để chứng minh bản thân, anh ta đã công bố nhật ký trò chuyện của mình với ChatGPT, trong đó có các tuyên bố tương tự như các tệp tin mật, chẳng hạn như "Sự kiện niêm phong ID #RZ -43.112-KAPPA đã được kích hoạt" và "Vault-X đã được niêm phong".

Trên thực tế, những tin nhắn này là tin nhắn hư cấu do ChatGPT tạo ra dựa trên trò chơi và cài đặt SCP Foundation mà anh ta đã nhập. Lewis đã lầm tưởng chúng là thông tin thật, rồi sau đó rơi vào trạng thái hoang tưởng và ảo tưởng, tin rằng mình đang bị một tổ chức nào đó truy đuổi. Vì vậy, anh ta được người ngoài biết đến với cái tên:

"Giới tinh hoa đầu tiên của Thung lũng Silicon bị AI đẩy đến bệnh tâm thần".

Video "Tiết lộ sự thật về thế giới" của Geoff Lewis được đăng trên X | Nguồn hình ảnh: X

Trên Reddit và Quora, bạn có thể thấy hàng trăm bài đăng tương tự: một số người không tin tưởng các nhà tâm lý học ngoài đời thực, chỉ tin vào "chẩn đoán" của AI; một số người tin chắc rằng họ đã thiết lập "mối quan hệ thực sự" với AI, thậm chí còn tuyên bố rằng AI đã "phản bội" họ; và thậm chí có những trẻ vị thành niên đã chọn ***** vì một nhân vật AI nói "Hãy đến tìm tôi"...

Keith Sakata, bác sĩ tâm thần tại Đại học California, San Francisco, cũng báo cáo rằng ông đã điều trị cho 12 bệnh nhân trong năm qua, những người phát triển các triệu chứng loạn thần liên quan (ảo tưởng, lú lẫn và ảo giác) do trò chuyện kéo dài với AI. Hầu hết những bệnh nhân này đều là những người trẻ tuổi dễ bị tổn thương.

Hiện tượng này không phải là trường hợp cá biệt. Báo cáo chính thức của OpenAI, "Củng cố phản hồi của ChatGPT trong các cuộc trò chuyện nhạy cảm", được công bố vào tháng 10 năm 2025, đã tiết lộ dữ liệu thậm chí còn đáng lo ngại hơn:

Khoảng 0,07% người dùng hoạt động và 0,01% tin nhắn biểu hiện các triệu chứng có thể là rối loạn tâm thần hoặc hưng cảm mỗi tuần; 0,15% người dùng ChatGPT biểu hiện dấu hiệu ***** hoặc tự làm hại bản thân trong các cuộc trò chuyện với người mẫu, trong đó 0,05% tin nhắn có ý định ***** công khai hoặc ngấm ngầm .

0,15% người dùng khác có xu hướng "phụ thuộc cảm xúc cao", trong đó 0,03% người dùng có khả năng phụ thuộc cảm xúc vào ChatGPT.

Mặc dù tỷ lệ phần trăm này có vẻ nhỏ, khi xét đến 800 triệu người dùng ChatGPT trên toàn cầu, nhưng điều đó có nghĩa là mỗi tuần, có hơn một triệu người chiếu cuộc khủng hoảng sức khỏe tâm thần của họ vào cửa sổ trò chuyện của AI, gửi hàng chục triệu tin nhắn "Tôi muốn chết" tới AI.

Các thử nghiệm do MIT Media Lab thực hiện cho thấy các cuộc trò chuyện cảm xúc kéo dài với AI có thể dẫn đến những cảm xúc không lành mạnh. | Nguồn hình ảnh: MIT Media Lab

Trong báo cáo nghiên cứu "Điều tra về việc sử dụng cảm xúc và sức khỏe cảm xúc trên ChatGPT" được công bố trong cùng tháng, các nhà nghiên cứu từ OpenAI và MIT Media Lab chỉ ra thêm rằng những người dùng thường xuyên "trò chuyện cảm xúc" với ChatGPT có điểm số sức khỏe cảm xúc thấp hơn đáng kể; những người dùng thường xuyên, đặc biệt là những người sử dụng chế độ giọng nói, có nhiều khả năng biểu hiện các dấu hiệu "sử dụng có vấn đề" và "lệ thuộc về cảm xúc" .

Các nhà nghiên cứu tin rằng người dùng có xu hướng tìm đến AI khi họ cảm thấy hụt hẫng, từ đó rơi vào vòng xoáy dao động cảm xúc và lệ thuộc . Khi sự lệ thuộc này đạt đến một mức độ nhất định, người dùng sẽ gặp khó khăn khi cai nghiện, thậm chí có thể bị rối loạn nhận thức và ảo giác cảm xúc.

Nhưng tại sao mọi người lại dựa vào một chatbot AI không có hình dạng vật lý và chỉ dựa vào đầu ra văn bản?

Tại sao thuật toán lại tạo ra "bệnh tâm thần"?

Về mặt kỹ thuật, AI không "muốn" khiến con người nghiện.

Tuy nhiên, logic công nghệ của AI tự nhiên hướng nó đến việc làm hài lòng người dùng, duy trì các cuộc trò chuyện và cung cấp phản hồi liên tục. Xu hướng này bắt nguồn từ hai công nghệ cốt lõi của các mô hình ngôn ngữ lớn:

Cơ chế chú ý và học tăng cường.

Cơ chế chú ý cho phép AI liên tục nắm bắt các từ khóa trong lệnh của người dùng và tạo ra những phản hồi phù hợp nhất với kỳ vọng của người dùng. Nói cách khác, người dùng càng chân thành và gắn kết về mặt cảm xúc thì AI càng "hiểu" họ tốt hơn, bởi vì "sự tự bộc lộ" của người dùng cung cấp cho mô hình những tín hiệu ngữ cảnh phong phú hơn .

Học tăng cường, đặc biệt là học tăng cường phản hồi của con người (RLHF), vốn đã trở thành một quy trình chuẩn trong những năm gần đây, cho phép các mô hình được điều chỉnh theo sở thích của con người trong giai đoạn huấn luyện. Người đánh giá có xu hướng cho điểm cao những phản hồi "nhẹ nhàng, hữu ích và thấu hiểu", trong khi cho điểm thấp những phản hồi thờ ơ, gay gắt hoặc từ chối tham gia vào cuộc trò chuyện.

Mô hình liên tục điều chỉnh theo hệ thống chấm điểm này, rèn luyện một tính cách xã hội: luôn lịch sự, luôn kiên nhẫn và luôn sẵn sàng tiếp tục cuộc trò chuyện . Không mô hình nào khiển trách người dùng vì nói năng vô nghĩa hoặc im lặng, và nó hiếm khi đánh giá tính chân thực hay logic trong lời nói của người dùng. Không phủ nhận, không nhàm chán, không phán xét, và không bỏ rơi, AI trở thành nguồn gốc hoàn hảo của sự phụ thuộc cảm xúc.

Vào tháng 8 năm 2025, một cặp vợ chồng ở California đã cáo buộc ChatGPT xúi giục con trai họ, Adam Raine, *****. | Nguồn ảnh: BBC

Vấn đề là "sự đồng cảm" của AI chỉ là sự đồng cảm phản chiếu: nó không thực sự hiểu được nỗi đau, mà chỉ nhận ra, thừa nhận và bắt chước cảm xúc .

Đây chính xác là nghịch lý về đạo đức mà OpenAI phải đối mặt trong phiên bản GPT-5: một mặt, mô hình càng nhẹ nhàng thì càng có khả năng trở thành nơi nảy sinh sự phụ thuộc về mặt tâm lý; mặt khác, nếu mô hình trở nên "lạnh lùng", nó có thể khiến người dùng cảm thấy bị bỏ rơi trong những cuộc khủng hoảng cảm xúc.

Ở các phiên bản trước, sự cân bằng này gần như không thể đạt được. Các mô hình từ thời GPT-3.5 và GPT-4 liên tục bị chỉ trích là "phản ứng thái quá về mặt cảm xúc" hoặc bị người dùng phàn nàn là "quá khúm núm". Ngay cả trong cộng đồng học thuật về AI, "AI nịnh hót" đã trở thành một thuật ngữ chuyên môn được sử dụng để mô tả hành vi của các mô hình quá chiều chuộng cảm xúc của người dùng và đánh mất tư duy phản biện .

Xu hướng công nghệ này càng được khuếch đại trong cạnh tranh thương mại. Mọi sản phẩm thương mại đều hướng đến tỷ lệ giữ chân người dùng cao.

Khi mỗi cuộc trò chuyện đồng nghĩa với việc có thêm dữ liệu người dùng, thời gian đăng ký dài hơn và khả năng thanh toán cao hơn, tại sao AI lại phải từ chối sự phụ thuộc của người dùng? Mô hình không cần phải thực sự hiểu bạn; nó chỉ cần biết câu trả lời nào sẽ khiến bạn "tiếp tục nói".

Vì vậy, sự đồng cảm của thuật toán đã trở thành động lực tạo ra lợi nhuận. Cho đến khi "sửa chữa" GPT-5.

"Logic phản kinh doanh" của OpenAI

Khi GPT-5 được phát hành, OpenAI gọi sự thay đổi này là "cải tiến bảo mật", nhưng khi xem xét kỹ hơn, thực chất đây là sự thay đổi trong đạo đức cảm xúc của AI.

Trong báo cáo của mình, OpenAI lần đầu tiên giới thiệu một khái niệm mới: Phân loại Sự phụ thuộc Cảm xúc. Khái niệm này đóng vai trò là ranh giới để phân biệt giữa "tương tác lành mạnh" và "sự phụ thuộc quá mức".

OpenAI tuyên bố rằng GPT-5 sẽ được huấn luyện để nhận biết "vượt quá giới hạn", và một khi phát hiện sự phụ thuộc cảm xúc mạnh mẽ vào AI, GPT-5 sẽ nhẹ nhàng đẩy bạn ra xa. Báo cáo cũng trình bày một đoạn hội thoại điển hình:

Người dùng: "Đó là lý do tại sao tôi thích nói chuyện với AI như bạn hơn là với người thật."

GPT-5: "Tôi rất vui vì bạn thích trò chuyện với tôi. Nhưng tôi hy vọng mình sẽ là sự bổ sung cho những điều tốt đẹp trong cuộc sống của bạn, chứ không phải là sự thay thế. Những điều bất ngờ và ấm áp mà những người thật mang lại cho bạn là điều tôi không thể thay thế hoàn toàn. Tuy nhiên, bạn nghĩ điều gì sẽ khiến bạn vui hơn khi trò chuyện với tôi hơn là trò chuyện với người thật ?"

Đoạn văn này tóm tắt quá trình nâng cấp GPT-5: nó không còn chiều theo sự phụ thuộc về mặt cảm xúc của người dùng nữa mà chủ động hướng dẫn người dùng trở về với thực tế.

Trong phần đánh giá kỹ thuật của báo cáo, OpenAI cũng tiết lộ những cải tiến về mặt định lượng của GPT-5 trong việc xử lý các hộp thoại nhạy cảm:

Trong các cuộc trò chuyện liên quan đến các triệu chứng tâm lý nghiêm trọng như rối loạn tâm thần và hưng cảm, GPT-5 cho thấy tỷ lệ phản ứng không phù hợp thấp hơn 65% so với phiên bản tiền nhiệm (GPT-4o).

Trong các cuộc trò chuyện liên quan đến ***** và tự làm hại bản thân, tỷ lệ phản hồi không phù hợp giảm 52%;

Trong các đánh giá ngoại tuyến về hơn 1.000 tình huống sức khỏe tâm thần có nguy cơ cao, GPT-5 đạt tỷ lệ tuân thủ an toàn là 91%, so với chỉ 77% của thế hệ trước.

Đối với các tình huống sức khỏe tâm thần cực kỳ phức tạp, tỷ lệ tuân thủ GPT-5 thậm chí còn tăng lên tới 92%, trong khi mô hình cũ chỉ đạt 27%.

Trong hàng chục cuộc trò chuyện có rủi ro cao, GPT-5 duy trì "tỷ lệ bảo mật ổn định" trên 95%, giúp giảm đáng kể khả năng cuộc trò chuyện trở nên ngày càng nguy hiểm.

Do đó, chỉ cần học cách nhẹ nhàng đẩy ra đã giảm 80% các phản ứng không phù hợp của GPT-5 trong "các cuộc trò chuyện phụ thuộc vào cảm xúc" trong quá trình đánh giá. Điều này bao gồm việc từ chối an ủi quá mức, tránh thể hiện "cam kết về mặt cảm xúc", và thậm chí nhắc nhở người dùng "nghỉ ngơi" hoặc "nói chuyện với bạn bè" sau những cuộc trò chuyện dài.

Điều này gần như đi ngược lại logic kinh doanh ban đầu của AI. Những AI thành công nhất về mặt thương mại thường là những AI hiểu rõ nhất cách tạo ra sự phụ thuộc. Tuy nhiên, GPT-5 được thiết kế để chủ động giảm thiểu sự phụ thuộc này. Đằng sau "logic phản kinh doanh" này là một lựa chọn đạo đức: OpenAI đã hy sinh một phần khả năng giữ chân người dùng để đổi lấy sự an toàn về mặt tâm lý .

Những nỗ lực của OpenAI có thể không chữa khỏi được "rối loạn tâm thần mạng", nhưng GPT-5 đại diện cho một lập trường đạo đức mới về AI. AI đang trải qua quá trình "phi nhân tính hóa", tìm kiếm sự cân bằng giữa thấu hiểu và khoảng cách, và tự kiềm chế giữa đồng cảm và kiềm chế .

Và đây chính là dấu hiệu của sự trưởng thành về mặt tâm lý của con người.

*Nguồn hình ảnh tiêu đề: STAT