From Beijing with Love

Cháu đã lớn thế này rồi à. Lại đây chú ôm cái coi.

Sự bùng nổ của công nghệ trí tuệ nhân tạo (AI) đã mở ra một kỷ nguyên mới, nơi các nội dung giả mạo còn gọi là deepfake trở thành mối đe dọa nghiêm trọng đối với cá nhân, xã hội và an ninh quốc gia. Deepfake sử dụng các thuật toán học sâu để tạo ra hình ảnh, âm thanh, hoặc video chân thực, khiến người xem lầm tưởng rằng một cá nhân đang nói hoặc làm điều họ không hề thực hiện. Từ các nội dung khiêu *** giả mạo nhắm vào phụ nữ và trẻ em đến các video lừa đảo chính trị làm tổn hại danh tiếng của các nhà lãnh đạo, deepfake đã trở thành một vấn đề cấp bách, đòi hỏi sự can thiệp mạnh mẽ từ các nhà lập pháp và cơ quan quản lý.

Theo công ty xác minh danh tính Signicat, các vụ lừa đảo sử dụng deepfake đã tăng hơn 20 lần trong ba năm qua, cho thấy mức độ nghiêm trọng của vấn đề. Trong bối cảnh này, Hạ viện Mỹ đã thông qua Đạo luật “Take It Down” vào ngày 28/04/2025, một bước đi quan trọng nhằm hình sự hóa việc tạo và lan truyền nội dung khiêu *** deepfake không được đồng ý, đồng thời các quốc gia khác như Anh, EU và Trung Quốc cũng đang triển khai các biện pháp riêng để đối phó với mối đe dọa này. Tuy nhiên, cuộc chiến chống deepfake vẫn đầy thách thức do tốc độ phát triển của công nghệ và khó khăn trong việc phát hiện cũng như ngăn chặn.

Theo The New York Times, đạo luật này hình sự hóa việc công bố hình ảnh hoặc video khiêu *** không được đồng ý, bao gồm cả nội dung AI tạo sinh, và yêu cầu các nền tảng trực tuyến như mạng xã hội phải gỡ bỏ nội dung này trong vòng 48 giờ sau khi nhận được thông báo từ nạn nhân. Được giới thiệu bởi Thượng nghị sĩ Ted Cruz và đồng tài trợ bởi Thượng nghị sĩ Amy Klobuchar, đạo luật đã nhận được sự ủng hộ từ cả hai đảng với sự hậu thuẫn mạnh mẽ từ Đệ nhất phu nhân Melania Trump, người đã vận động hành lang cho dự luật này trong khuôn khổ chiến dịch “Be Best” tập trung vào an toàn trực tuyến. Melania Trump trong một sự kiện tại Capitol Hill vào tháng 3/2025, nhấn mạnh rằng deepfake khiêu *** gây ra “môi trường độc hại” đặc biệt cho thanh thiếu niên, đặc biệt các bé gái và kêu gọi bảo vệ quyền riêng tư và an toàn trực tuyến cho họ. Dự luật đã được Thượng viện thông qua nhất trí vào tháng 2/2025, hiện đang chờ chữ ký của Tổng thống Donald Trump.

Đạo luật “Take It Down” không chỉ nhắm đến nội dung khiêu *** deepfake mà còn giải quyết vấn đề “trả thù khiêu ***” nói chung, một dạng nội dung khiêu *** được chia sẻ mà không có sự đồng ý nhằm làm tổn hại nạn nhân. Theo CNN, đạo luật này được thúc đẩy bởi những câu chuyện thực tế từ các nạn nhân như Elliston Berry, một thiếu nữ bị bạn học sử dụng ứng dụng AI để tạo hình ảnh khiêu *** giả mạo và phát tán trên mạng xã hội. Việc Snapchat mất nhiều tháng để gỡ bỏ nội dung này đã khiến gia đình Berry liên hệ với văn phòng của Thượng nghị sĩ Cruz, làm nổi bật sự thiếu hiệu quả của các quy định hiện hành. Đạo luật yêu cầu các nền tảng như Snapchat, Instagram và TikTok phải có quy trình rõ ràng để xử lý yêu cầu gỡ bỏ từ nạn nhân, với sự giám sát từ Ủy ban Thương mại Liên bang (FTC). Tuy nhiên, một số nhà phê bình như các nghị sĩ Dân chủ trong buổi đánh giá dự luật vào tháng 4/2025, lo ngại rằng FTC có thể gặp khó khăn trong việc thực thi luật, làm giảm hiệu quả của đạo luật. Dù vậy, sự ủng hộ rộng rãi từ các công ty công nghệ như Meta, Google và Snap cùng hơn 120 tổ chức như Trung tâm Quốc gia về Khai thác Tình dục (NCOSE), cho thấy tầm quan trọng của dự luật trong việc giải quyết một vấn đề xã hội nghiêm trọng.

Ngoài Mỹ, các quốc gia khác cũng đang nỗ lực đối phó với deepfake, đặc biệt nội dung khiêu *** giả mạo. Cùng ngày 28/04/2025, cơ quan đại diện cho quyền trẻ em của Anh đã kêu gọi chính phủ Anh cấm các ứng dụng chỉnh sửa ảnh khiêu *** có sẵn trên internet, nhấn mạnh mối nguy hiểm đối với trẻ em. Báo cáo từ cơ quan này vào tháng 4/2025 chỉ ra rằng trẻ em ngày càng lo sợ trở thành nạn nhân của deepfake khiêu ***, với các ứng dụng dễ tiếp cận cho phép tạo nội dung giả mạo chỉ bằng vài thao tác. Tại Liên minh Châu Âu, Đạo luật AI được thông qua gần đây yêu cầu các nền tảng phải gắn nhãn rõ ràng đối với nội dung deepfake để cảnh báo người dùng, một biện pháp nhằm tăng cường tính minh bạch và giảm thiểu tác hại. Trung Quốc từ năm 2023 cũng đã triển khai luật tương tự, buộc các nội dung AI tạo sinh phải được đánh dấu để tránh lừa dối công chúng. Những quy định này phản ánh sự đồng thuận toàn cầu rằng deepfake, đặc biệt khi liên quan đến nội dung khiêu *** hoặc chính trị là một mối đe dọa nghiêm trọng cần được kiểm soát.

Deepfake không chỉ giới hạn ở nội dung khiêu *** mà còn xuất hiện trong các lĩnh vực khác, từ lừa đảo chính trị đến giải trí. Một ví dụ nổi bật là vụ việc vào tháng 1/2024, khi hình ảnh deepfake khiêu *** của ngôi sao nhạc pop Taylor Swift lan truyền rộng rãi trên mạng xã hội, gây phẫn nộ từ người hâm mộ và khiến Nhà Trắng lên tiếng bày tỏ quan ngại. Trong cuộc bầu cử tổng thống Mỹ năm 2024, Elon Musk đã chia sẻ một video deepfake không được gắn nhãn, sử dụng gương mặt của ứng viên Dân chủ Kamala Harris, trong đó nhân vật giả mạo gọi Tổng thống Joe Biden là “già yếu” và thừa nhận không biết cách điều hành đất nước. Video này thu hút hàng chục triệu lượt xem, làm dấy lên lo ngại về tác động của deepfake đối với niềm tin công chúng trong các sự kiện chính trị. Tại California, Thống đốc Gavin Newsom đã phản ứng bằng cách ký luật cấm deepfake chính trị vào tháng 9/2024, yêu cầu gắn nhãn rõ ràng cho các nội dung AI tạo sinh. Ở cấp độ quốc tế, deepfake cũng được sử dụng để thao túng dư luận, chẳng hạ hình ảnh giả mạo về cháy rừng Maui năm 2023 tại Trung Quốc, cáo buộc Mỹ thử nghiệm “vũ khí thời tiết”. Hay âm thanh giả mạo ứng viên tổng thống Nigeria Atiku Abubakar âm mưu gian lận bầu cử vào năm 2023.

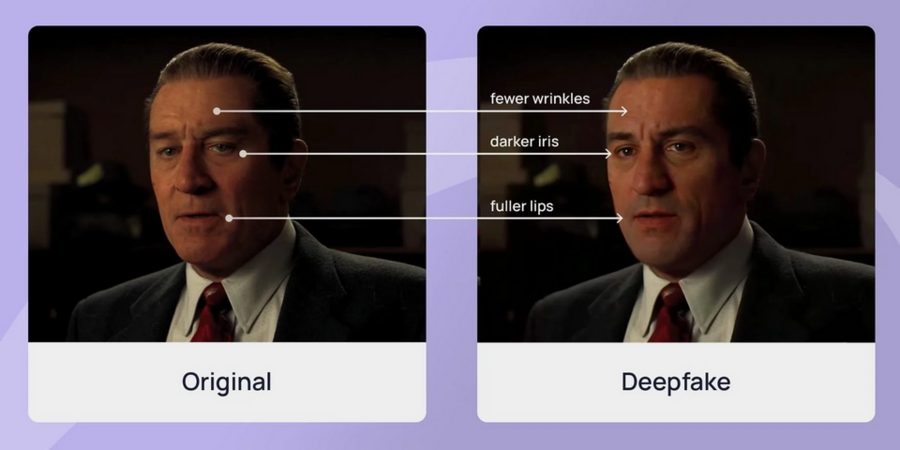

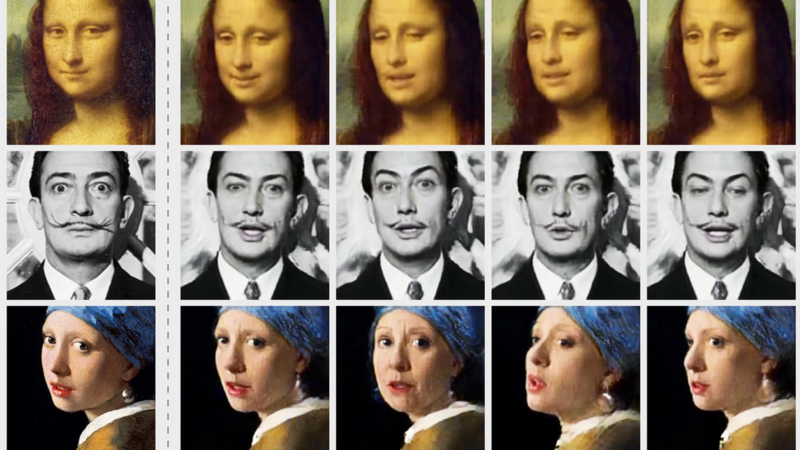

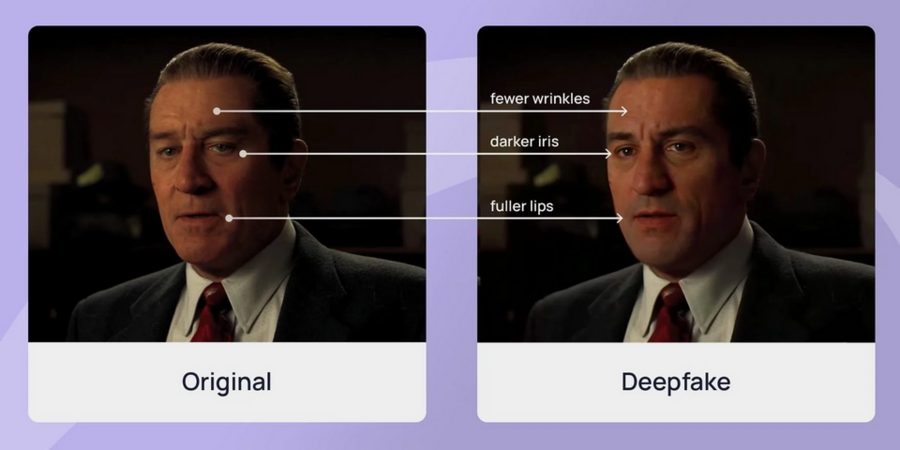

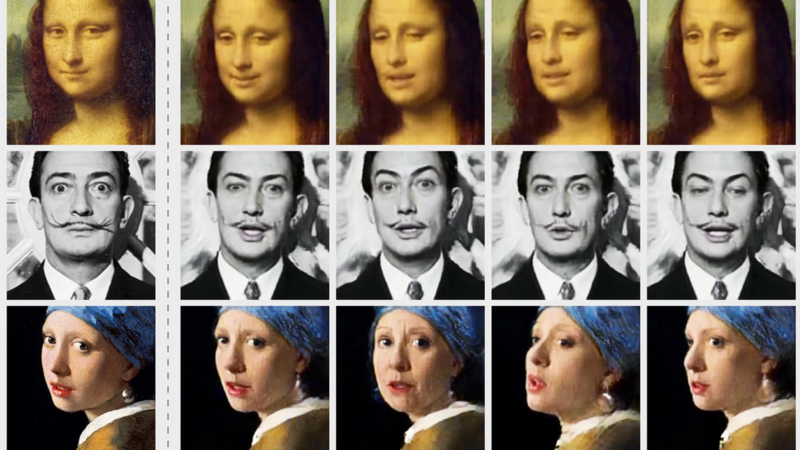

Công nghệ deepfake hoạt động dựa trên các thuật toán học sâu, thường sử dụng mạng nơ-ron đối kháng (GANs) để phân tích và tái tạo các mẫu hình từ video hoặc âm thanh thực tế. Theo The Washington Post, quá trình này bắt đầu bằng việc huấn luyện AI trên một lượng lớn dữ liệu hình ảnh hoặc âm thanh của một cá nhân, sau đó thay thế các yếu tố như khuôn mặt hoặc giọng nói vào nội dung khác, tạo ra kết quả gần như không thể phân biệt với thật. Công nghệ nhân bản giọng nói chia nhỏ âm thanh thành các đoạn nửa âm tiết và tái cấu trúc thành các câu mới, càng làm tăng tính thuyết phục của deepfake. Nếu như trước đây, việc tạo deepfake đòi hỏi kỹ năng chỉnh sửa chuyên nghiệp và dữ liệu gốc chất lượng cao, thì nay các công cụ AI tạo sinh như DALL-E hay Stable Diffusion cho phép người dùng tạo video hoặc hình ảnh chỉ từ các gợi ý văn bản đơn giản, khiến deepfake trở nên dễ tiếp cận hơn bao giờ hết.

Việc phát hiện deepfake ngày càng trở nên khó khăn do sự cải tiến liên tục của các mô hình AI. Theo bài đăng trên X từ @techday_asia, công cụ phát hiện deepfake thời gian thực của X-PHY đạt độ chính xác lên đến 90% mà không cần kết nối internet, nhưng các dấu hiệu như ngón tay thừa, màu sắc không đồng đều hoặc chuyển động miệng không khớp với lời nói đang dần biến mất khi công nghệ AI trở nên tinh vi hơn. Các công ty như Microsoft và OpenAI đã cam kết nhúng hình mờ kỹ thuật số vào nội dung AI tạo sinh để phân biệt chúng với nội dung thật, nhưng như OpenAI thừa nhận, những biện pháp này có thể dễ dàng bị vượt qua bởi những kẻ có ý đồ xấu. Các startup như Sensity AI và Sentinel đang phát triển công nghệ phát hiện deepfake, tập trung vào phân tích các bất thường trong tần số âm thanh hoặc chuyển động khuôn mặt, nhưng việc triển khai rộng rãi vẫn còn hạn chế.

Nguy cơ lớn nhất của deepfake nằm ở khả năng làm xói mòn niềm tin vào thông tin trực quan. Khi nội dung giả mạo trở nên không thể phân biệt, các video giả về giám đốc điều hành công ty hoặc binh lính phạm tội chiến tranh có thể thao túng thị trường tài chính hoặc gây bất ổn chính trị. Deepfake khiêu *** thường nhắm vào phụ nữ và trẻ em gây ra tổn thương tâm lý nghiêm trọng. FBI báo cáo năm 2023 rằng nhiều nạn nhân đã ***** sau khi bị tống tiền bằng nội dung giả mạo. Hơn nữa, sự phổ biến của deepfake tạo ra một nghịch lý pháp lý: những tội phạm bị ghi hình hoặc thu âm có thể tuyên bố bằng chứng chống lại họ là giả, làm suy yếu hệ thống tư pháp. Ví dụ, trong một số vụ án gần đây, các bị cáo đã sử dụng lập luận “đây là deepfake” để phủ nhận bằng chứng trước tòa làm phức tạp quá trình xét xử.

Cuộc chiến chống deepfake đòi hỏi sự phối hợp giữa công nghệ, luật pháp, và giáo dục cộng đồng. Đạo luật “Take It Down” của Mỹ là một bước tiến quan trọng, nhưng hiệu quả của nó phụ thuộc vào khả năng thực thi của FTC và sự hợp tác từ các nền tảng trực tuyến. Các quy định của EU và Trung Quốc về gắn nhãn nội dung AI là những nỗ lực đáng chú ý, nhưng cần được bổ sung bởi các công cụ phát hiện tiên tiến và chiến dịch nâng cao nhận thức để giúp công chúng nhận diện nội dung giả mạo. Trong khi đó, các nội dung deepfake vô hại như video Cristiano Ronaldo hát tiếng Ả Rập cho thấy tiềm năng sáng tạo của công nghệ. Với tốc độ phát triển của AI, các nhà lập pháp và công ty công nghệ phải chạy đua để bắt kịp, nhưng như giáo sư Tim Wu tại Đại học Columbia nhận định trong một hội nghị báo chí năm 2025 - “Quốc hội cần hành động tích cực hơn để bảo vệ trẻ em và những người dễ bị tổn thương trước những tác hại của công nghệ.”

Deepfake không chỉ là một thách thức công nghệ mà còn là một vấn đề xã hội và đạo đức, đòi hỏi sự hợp tác toàn cầu để giải quyết. Đạo luật “Take It Down” và các quy định tương tự ở Anh, EU và Trung Quốc là những bước đi đầu tiên, nhưng cuộc chiến này vẫn còn dài. Khi công nghệ AI tiếp tục tiến bộ, việc phát triển các công cụ phát hiện mạnh mẽ hơn, nâng cao nhận thức cộng đồng, và xây dựng khung pháp lý chặt chẽ sẽ là chìa khóa để giảm thiểu tác hại của deepfake, bảo vệ quyền riêng tư và niềm tin trong một thế giới số ngày càng phức tạp.

#deepfake

Theo công ty xác minh danh tính Signicat, các vụ lừa đảo sử dụng deepfake đã tăng hơn 20 lần trong ba năm qua, cho thấy mức độ nghiêm trọng của vấn đề. Trong bối cảnh này, Hạ viện Mỹ đã thông qua Đạo luật “Take It Down” vào ngày 28/04/2025, một bước đi quan trọng nhằm hình sự hóa việc tạo và lan truyền nội dung khiêu *** deepfake không được đồng ý, đồng thời các quốc gia khác như Anh, EU và Trung Quốc cũng đang triển khai các biện pháp riêng để đối phó với mối đe dọa này. Tuy nhiên, cuộc chiến chống deepfake vẫn đầy thách thức do tốc độ phát triển của công nghệ và khó khăn trong việc phát hiện cũng như ngăn chặn.

Theo The New York Times, đạo luật này hình sự hóa việc công bố hình ảnh hoặc video khiêu *** không được đồng ý, bao gồm cả nội dung AI tạo sinh, và yêu cầu các nền tảng trực tuyến như mạng xã hội phải gỡ bỏ nội dung này trong vòng 48 giờ sau khi nhận được thông báo từ nạn nhân. Được giới thiệu bởi Thượng nghị sĩ Ted Cruz và đồng tài trợ bởi Thượng nghị sĩ Amy Klobuchar, đạo luật đã nhận được sự ủng hộ từ cả hai đảng với sự hậu thuẫn mạnh mẽ từ Đệ nhất phu nhân Melania Trump, người đã vận động hành lang cho dự luật này trong khuôn khổ chiến dịch “Be Best” tập trung vào an toàn trực tuyến. Melania Trump trong một sự kiện tại Capitol Hill vào tháng 3/2025, nhấn mạnh rằng deepfake khiêu *** gây ra “môi trường độc hại” đặc biệt cho thanh thiếu niên, đặc biệt các bé gái và kêu gọi bảo vệ quyền riêng tư và an toàn trực tuyến cho họ. Dự luật đã được Thượng viện thông qua nhất trí vào tháng 2/2025, hiện đang chờ chữ ký của Tổng thống Donald Trump.

Đạo luật “Take It Down” không chỉ nhắm đến nội dung khiêu *** deepfake mà còn giải quyết vấn đề “trả thù khiêu ***” nói chung, một dạng nội dung khiêu *** được chia sẻ mà không có sự đồng ý nhằm làm tổn hại nạn nhân. Theo CNN, đạo luật này được thúc đẩy bởi những câu chuyện thực tế từ các nạn nhân như Elliston Berry, một thiếu nữ bị bạn học sử dụng ứng dụng AI để tạo hình ảnh khiêu *** giả mạo và phát tán trên mạng xã hội. Việc Snapchat mất nhiều tháng để gỡ bỏ nội dung này đã khiến gia đình Berry liên hệ với văn phòng của Thượng nghị sĩ Cruz, làm nổi bật sự thiếu hiệu quả của các quy định hiện hành. Đạo luật yêu cầu các nền tảng như Snapchat, Instagram và TikTok phải có quy trình rõ ràng để xử lý yêu cầu gỡ bỏ từ nạn nhân, với sự giám sát từ Ủy ban Thương mại Liên bang (FTC). Tuy nhiên, một số nhà phê bình như các nghị sĩ Dân chủ trong buổi đánh giá dự luật vào tháng 4/2025, lo ngại rằng FTC có thể gặp khó khăn trong việc thực thi luật, làm giảm hiệu quả của đạo luật. Dù vậy, sự ủng hộ rộng rãi từ các công ty công nghệ như Meta, Google và Snap cùng hơn 120 tổ chức như Trung tâm Quốc gia về Khai thác Tình dục (NCOSE), cho thấy tầm quan trọng của dự luật trong việc giải quyết một vấn đề xã hội nghiêm trọng.

Ngoài Mỹ, các quốc gia khác cũng đang nỗ lực đối phó với deepfake, đặc biệt nội dung khiêu *** giả mạo. Cùng ngày 28/04/2025, cơ quan đại diện cho quyền trẻ em của Anh đã kêu gọi chính phủ Anh cấm các ứng dụng chỉnh sửa ảnh khiêu *** có sẵn trên internet, nhấn mạnh mối nguy hiểm đối với trẻ em. Báo cáo từ cơ quan này vào tháng 4/2025 chỉ ra rằng trẻ em ngày càng lo sợ trở thành nạn nhân của deepfake khiêu ***, với các ứng dụng dễ tiếp cận cho phép tạo nội dung giả mạo chỉ bằng vài thao tác. Tại Liên minh Châu Âu, Đạo luật AI được thông qua gần đây yêu cầu các nền tảng phải gắn nhãn rõ ràng đối với nội dung deepfake để cảnh báo người dùng, một biện pháp nhằm tăng cường tính minh bạch và giảm thiểu tác hại. Trung Quốc từ năm 2023 cũng đã triển khai luật tương tự, buộc các nội dung AI tạo sinh phải được đánh dấu để tránh lừa dối công chúng. Những quy định này phản ánh sự đồng thuận toàn cầu rằng deepfake, đặc biệt khi liên quan đến nội dung khiêu *** hoặc chính trị là một mối đe dọa nghiêm trọng cần được kiểm soát.

Deepfake không chỉ giới hạn ở nội dung khiêu *** mà còn xuất hiện trong các lĩnh vực khác, từ lừa đảo chính trị đến giải trí. Một ví dụ nổi bật là vụ việc vào tháng 1/2024, khi hình ảnh deepfake khiêu *** của ngôi sao nhạc pop Taylor Swift lan truyền rộng rãi trên mạng xã hội, gây phẫn nộ từ người hâm mộ và khiến Nhà Trắng lên tiếng bày tỏ quan ngại. Trong cuộc bầu cử tổng thống Mỹ năm 2024, Elon Musk đã chia sẻ một video deepfake không được gắn nhãn, sử dụng gương mặt của ứng viên Dân chủ Kamala Harris, trong đó nhân vật giả mạo gọi Tổng thống Joe Biden là “già yếu” và thừa nhận không biết cách điều hành đất nước. Video này thu hút hàng chục triệu lượt xem, làm dấy lên lo ngại về tác động của deepfake đối với niềm tin công chúng trong các sự kiện chính trị. Tại California, Thống đốc Gavin Newsom đã phản ứng bằng cách ký luật cấm deepfake chính trị vào tháng 9/2024, yêu cầu gắn nhãn rõ ràng cho các nội dung AI tạo sinh. Ở cấp độ quốc tế, deepfake cũng được sử dụng để thao túng dư luận, chẳng hạ hình ảnh giả mạo về cháy rừng Maui năm 2023 tại Trung Quốc, cáo buộc Mỹ thử nghiệm “vũ khí thời tiết”. Hay âm thanh giả mạo ứng viên tổng thống Nigeria Atiku Abubakar âm mưu gian lận bầu cử vào năm 2023.

Công nghệ deepfake hoạt động dựa trên các thuật toán học sâu, thường sử dụng mạng nơ-ron đối kháng (GANs) để phân tích và tái tạo các mẫu hình từ video hoặc âm thanh thực tế. Theo The Washington Post, quá trình này bắt đầu bằng việc huấn luyện AI trên một lượng lớn dữ liệu hình ảnh hoặc âm thanh của một cá nhân, sau đó thay thế các yếu tố như khuôn mặt hoặc giọng nói vào nội dung khác, tạo ra kết quả gần như không thể phân biệt với thật. Công nghệ nhân bản giọng nói chia nhỏ âm thanh thành các đoạn nửa âm tiết và tái cấu trúc thành các câu mới, càng làm tăng tính thuyết phục của deepfake. Nếu như trước đây, việc tạo deepfake đòi hỏi kỹ năng chỉnh sửa chuyên nghiệp và dữ liệu gốc chất lượng cao, thì nay các công cụ AI tạo sinh như DALL-E hay Stable Diffusion cho phép người dùng tạo video hoặc hình ảnh chỉ từ các gợi ý văn bản đơn giản, khiến deepfake trở nên dễ tiếp cận hơn bao giờ hết.

Việc phát hiện deepfake ngày càng trở nên khó khăn do sự cải tiến liên tục của các mô hình AI. Theo bài đăng trên X từ @techday_asia, công cụ phát hiện deepfake thời gian thực của X-PHY đạt độ chính xác lên đến 90% mà không cần kết nối internet, nhưng các dấu hiệu như ngón tay thừa, màu sắc không đồng đều hoặc chuyển động miệng không khớp với lời nói đang dần biến mất khi công nghệ AI trở nên tinh vi hơn. Các công ty như Microsoft và OpenAI đã cam kết nhúng hình mờ kỹ thuật số vào nội dung AI tạo sinh để phân biệt chúng với nội dung thật, nhưng như OpenAI thừa nhận, những biện pháp này có thể dễ dàng bị vượt qua bởi những kẻ có ý đồ xấu. Các startup như Sensity AI và Sentinel đang phát triển công nghệ phát hiện deepfake, tập trung vào phân tích các bất thường trong tần số âm thanh hoặc chuyển động khuôn mặt, nhưng việc triển khai rộng rãi vẫn còn hạn chế.

Nguy cơ lớn nhất của deepfake nằm ở khả năng làm xói mòn niềm tin vào thông tin trực quan. Khi nội dung giả mạo trở nên không thể phân biệt, các video giả về giám đốc điều hành công ty hoặc binh lính phạm tội chiến tranh có thể thao túng thị trường tài chính hoặc gây bất ổn chính trị. Deepfake khiêu *** thường nhắm vào phụ nữ và trẻ em gây ra tổn thương tâm lý nghiêm trọng. FBI báo cáo năm 2023 rằng nhiều nạn nhân đã ***** sau khi bị tống tiền bằng nội dung giả mạo. Hơn nữa, sự phổ biến của deepfake tạo ra một nghịch lý pháp lý: những tội phạm bị ghi hình hoặc thu âm có thể tuyên bố bằng chứng chống lại họ là giả, làm suy yếu hệ thống tư pháp. Ví dụ, trong một số vụ án gần đây, các bị cáo đã sử dụng lập luận “đây là deepfake” để phủ nhận bằng chứng trước tòa làm phức tạp quá trình xét xử.

Cuộc chiến chống deepfake đòi hỏi sự phối hợp giữa công nghệ, luật pháp, và giáo dục cộng đồng. Đạo luật “Take It Down” của Mỹ là một bước tiến quan trọng, nhưng hiệu quả của nó phụ thuộc vào khả năng thực thi của FTC và sự hợp tác từ các nền tảng trực tuyến. Các quy định của EU và Trung Quốc về gắn nhãn nội dung AI là những nỗ lực đáng chú ý, nhưng cần được bổ sung bởi các công cụ phát hiện tiên tiến và chiến dịch nâng cao nhận thức để giúp công chúng nhận diện nội dung giả mạo. Trong khi đó, các nội dung deepfake vô hại như video Cristiano Ronaldo hát tiếng Ả Rập cho thấy tiềm năng sáng tạo của công nghệ. Với tốc độ phát triển của AI, các nhà lập pháp và công ty công nghệ phải chạy đua để bắt kịp, nhưng như giáo sư Tim Wu tại Đại học Columbia nhận định trong một hội nghị báo chí năm 2025 - “Quốc hội cần hành động tích cực hơn để bảo vệ trẻ em và những người dễ bị tổn thương trước những tác hại của công nghệ.”

Deepfake không chỉ là một thách thức công nghệ mà còn là một vấn đề xã hội và đạo đức, đòi hỏi sự hợp tác toàn cầu để giải quyết. Đạo luật “Take It Down” và các quy định tương tự ở Anh, EU và Trung Quốc là những bước đi đầu tiên, nhưng cuộc chiến này vẫn còn dài. Khi công nghệ AI tiếp tục tiến bộ, việc phát triển các công cụ phát hiện mạnh mẽ hơn, nâng cao nhận thức cộng đồng, và xây dựng khung pháp lý chặt chẽ sẽ là chìa khóa để giảm thiểu tác hại của deepfake, bảo vệ quyền riêng tư và niềm tin trong một thế giới số ngày càng phức tạp.

#deepfake