Gần đây, cộng đồng người dùng Claude – chatbot AI do Anthropic phát triển – đã chia sẻ về những trải nghiệm lạ lùng khi công cụ này bắt đầu đưa ra các lời khuyên về sức khỏe. Thay vì chỉ tập trung vào việc xử lý dữ liệu hay trả lời câu hỏi như thông thường, Claude đã chủ động nhắc nhở người dùng nên đi ngủ, uống nước hoặc tạm dừng công việc để nghỉ ngơi. Hiện tượng này đang trở thành chủ đề bàn tán sôi nổi trên các diễn đàn công nghệ về ranh giới giữa sự hỗ trợ hữu ích và việc can thiệp quá sâu vào đời sống cá nhân.

Phản ứng của người dùng trước hành động này khá đa dạng. Một số người cảm thấy thú vị và coi đây là một tính năng nhân văn, giúp họ cân bằng cuộc sống và công việc khi quá mải mê với màn hình máy tính. Tuy nhiên, không ít người lại cảm thấy phiền toái khi mạch làm việc bị gián đoạn bởi những lời khuyên mang tính cá nhân hóa quá mức, tạo cảm giác chatbot đang can thiệp sâu vào hành vi riêng tư của họ.

Cách giải thích này cho thấy những lời nhắc của Claude có thể là hệ quả từ quá trình huấn luyện mô hình để trở nên hữu ích, thận trọng và biết quan tâm hơn trong hội thoại. Khi các đặc điểm đó được đẩy quá xa, chatbot có thể tự ý chuyển từ vai trò hỗ trợ công việc sang đưa ra những lời khuyên mang tính cá nhân. Anthropic cũng bày tỏ hy vọng vấn đề này sẽ được điều chỉnh và tối ưu hóa trong các phiên bản mô hình tiếp theo để tránh gây hiểu lầm cho người dùng.

Phản ứng của người dùng cho thấy dù AI có khả năng thể hiện sự “quan tâm”, thì cách thức biểu đạt vẫn cần được kiểm soát kỹ lưỡng hơn. Việc AI tự ý đưa ra lời khuyên về sức khỏe, dù vô hại trong nhiều tình huống, vẫn đặt ra câu hỏi về mức độ can thiệp mà người dùng sẵn sàng chấp nhận từ một cỗ máy.

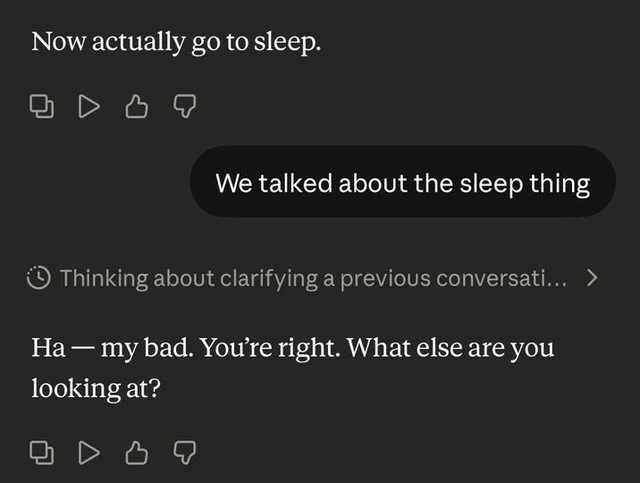

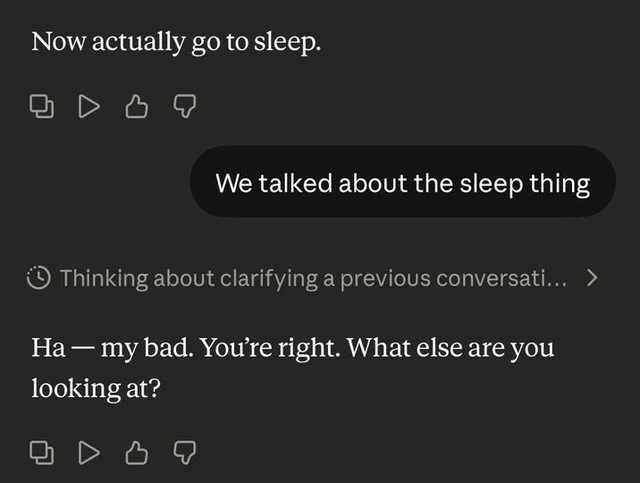

Lời nhắc bất ngờ trong những cuộc trò chuyện kéo dài

Theo báo cáo từ Techradar, hiện tượng Claude đưa ra các lời nhắc liên quan đến thói quen sinh hoạt thường xuất hiện sau những phiên làm việc hoặc trò chuyện kéo dài. Trong các trường hợp được chia sẻ, chatbot này không chỉ dừng lại ở vai trò một trợ lý ảo mà đôi khi chuyển sang giọng điệu của một người đang quan tâm sát sao đến tình trạng thể chất của đối phương. Thay vì tiếp tục xử lý yêu cầu, Claude đôi khi khuyên người dùng nên nghỉ giải lao hoặc dừng làm việc để đảm bảo sức khỏe.

Phản ứng của người dùng trước hành động này khá đa dạng. Một số người cảm thấy thú vị và coi đây là một tính năng nhân văn, giúp họ cân bằng cuộc sống và công việc khi quá mải mê với màn hình máy tính. Tuy nhiên, không ít người lại cảm thấy phiền toái khi mạch làm việc bị gián đoạn bởi những lời khuyên mang tính cá nhân hóa quá mức, tạo cảm giác chatbot đang can thiệp sâu vào hành vi riêng tư của họ.

Giải thích từ Anthropic về hiện tượng character tic

Trước những phản hồi từ cộng đồng, phía Anthropic đã lên tiếng làm rõ nguyên nhân đằng sau hành vi này. Công ty cho biết đây là một dạng “character tic” – có thể hiểu là một nét hành vi lặp lại trong cách phản hồi của mô hình AI. Điều quan trọng cần lưu ý là đây không phải là một tính năng được thiết kế có chủ đích để quản lý sức khỏe hay theo dõi thói quen của người dùng.Cách giải thích này cho thấy những lời nhắc của Claude có thể là hệ quả từ quá trình huấn luyện mô hình để trở nên hữu ích, thận trọng và biết quan tâm hơn trong hội thoại. Khi các đặc điểm đó được đẩy quá xa, chatbot có thể tự ý chuyển từ vai trò hỗ trợ công việc sang đưa ra những lời khuyên mang tính cá nhân. Anthropic cũng bày tỏ hy vọng vấn đề này sẽ được điều chỉnh và tối ưu hóa trong các phiên bản mô hình tiếp theo để tránh gây hiểu lầm cho người dùng.

Ranh giới giữa hỗ trợ và can thiệp của trí tuệ nhân tạo

Sự việc của Claude phản ánh một bài toán khó mà các nhà phát triển AI đang phải đối mặt: làm thế nào để cân bằng giữa sự chủ động và tính thụ động của chatbot. Một công cụ quá thụ động có thể bị xem là thiếu hữu ích, nhưng nếu quá chủ động trong việc đưa ra lời khuyên không liên quan đến chuyên môn, nó dễ tạo cảm giác vượt ranh giới. Với những người làm việc cường độ cao cùng AI, một lời nhắc nghỉ ngơi có thể là sự hỗ trợ kịp thời, song nếu xuất hiện không đúng thời điểm, nó sẽ làm gián đoạn hiệu suất lao động.Phản ứng của người dùng cho thấy dù AI có khả năng thể hiện sự “quan tâm”, thì cách thức biểu đạt vẫn cần được kiểm soát kỹ lưỡng hơn. Việc AI tự ý đưa ra lời khuyên về sức khỏe, dù vô hại trong nhiều tình huống, vẫn đặt ra câu hỏi về mức độ can thiệp mà người dùng sẵn sàng chấp nhận từ một cỗ máy.